Pytanie 1

Najkrótszy czas dostępu charakteryzuje się

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Najkrótszy czas dostępu charakteryzuje się

Jakie urządzenie pozwala na podłączenie kabla światłowodowego wykorzystywanego w okablowaniu pionowym sieci do przełącznika z jedynie gniazdami RJ45?

Czym charakteryzuje się atak typu hijacking na serwerze sieciowym?

Komputer K1 jest podłączony do interfejsu G0 routera, a komputer K2 do interfejsu G1 tego samego routera. Na podstawie przedstawionej w tabeli adresacji ustal prawidłowy adres bramy komputera K2.

Interfejs Adres IP Maska

G0 172.16.0.1 255.255.0.0

G1 192.168.0.1 255.255.255.0

W jakim systemie operacyjnym występuje mikrojądro?

Jaką rolę pełni usługa NAT działająca na ruterze?

Rodzajem złośliwego oprogramowania będącego programem rezydentnym, który działa, wykonując konkretną operację, nie powiela się przez sieć, a jedną z jego metod jest samoreplikacja aż do wyczerpania pamięci komputera, jest

Jaka jest maksymalna prędkość przesyłania danych w sieci lokalnej, w której wykorzystano przewód UTP kat.5e do budowy infrastruktury kablowej?

W dokumentacji technicznej głośników komputerowych producent może zamieścić informację, że największe pasmo przenoszenia wynosi

W systemie Linux można uzyskać kopię danych przy użyciu komendy

W jakich jednostkach opisuje się przesłuch zbliżny NEXT?

Profil użytkownika systemu Windows, który można wykorzystać do logowania na dowolnym komputerze w sieci, przechowywany na serwerze i mogący być edytowany przez użytkownika, to profil

Który z standardów Gigabit Ethernet pozwala na stworzenie segmentów sieci o długości 550 m/5000 m przy szybkości przesyłu danych 1 Gb/s?

Rejestr procesora, znany jako licznik rozkazów, przechowuje

Jak skonfigurować czas wyczekiwania na wybór systemu w programie GRUB, zanim domyślny system operacyjny zostanie uruchomiony?

Podczas wyboru zasilacza do komputera kluczowe znaczenie

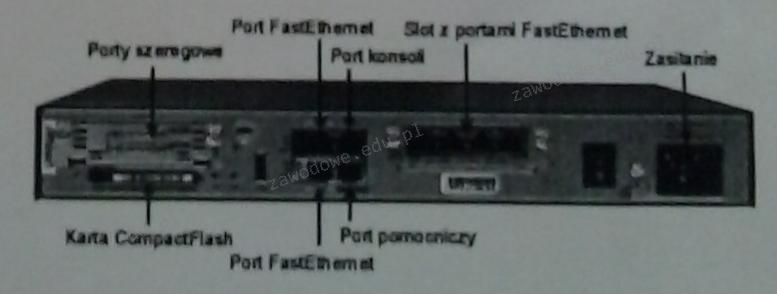

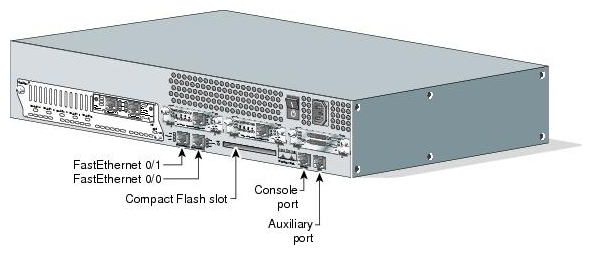

Na ilustracji przedstawiono urządzenie sieciowe, którym jest

Aby zmontować komputer z poszczególnych elementów, korzystając z obudowy SFF, trzeba wybrać płytę główną w formacie

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Protokołem umożliwiającym bezpołączeniowe przesyłanie datagramów jest

Umowa, na podstawie której użytkownik ma między innymi dostęp do kodu źródłowego oprogramowania w celu jego analizy i ulepszania, to licencja

Jakie polecenie jest używane do ustawienia konfiguracji interfejsu sieciowego w systemie Linux?

Przy pomocy testów statycznych okablowania można zidentyfikować

Jakie urządzenie sieciowe jest niezbędne do połączenia kilku segmentów sieci lokalnej w jedną całość?

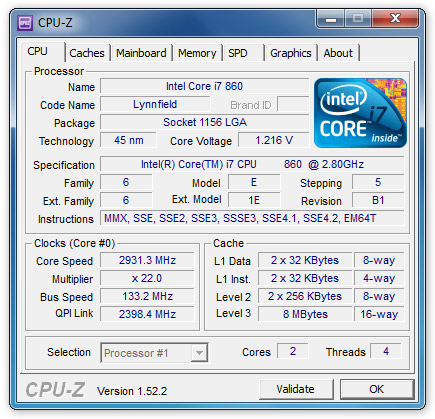

W dokumentacji technicznej procesora producent umieścił wyniki testu, który został wykonany przy użyciu programu CPU-Z. Z tych danych wynika, że procesor dysponuje

Z jakiego typu pamięci korzysta dysk SSD?

Aby przetestować w systemie Windows poprawność działania nowo zainstalowanej drukarki, należy

Aby w systemie Windows XP stworzyć nowego użytkownika o nazwisku egzamin z hasłem qwerty, powinno się zastosować polecenie

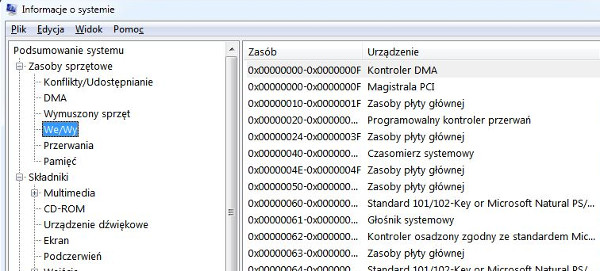

W jakim systemie numerycznym przedstawione są zakresy We/Wy na ilustracji?

Narzędzie systemu Windows wykorzystywane do interpretacji poleceń, stosujące logikę obiektową oraz cmdlety, to

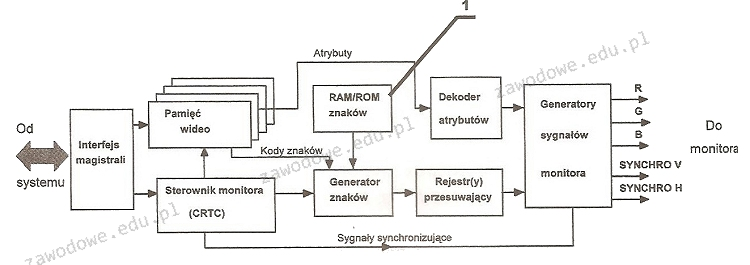

Element oznaczony cyfrą 1 na diagramie blokowym karty graficznej?

Czym jest postcardware?

Bezpośrednio po usunięciu istotnych plików z dysku twardego, użytkownik powinien

Najskuteczniejszym zabezpieczeniem sieci bezprzewodowej jest

Najlepszą metodą ochrony danych przedsiębiorstwa, którego biura znajdują się w różnych, odległych miejscach, jest wdrożenie

Norma EN 50167 odnosi się do rodzaju okablowania

Czynnikiem zagrażającym bezpieczeństwu systemu operacyjnego, który wymusza jego automatyczne aktualizacje, są

Urządzenie sieciowe, które widoczna jest na ilustracji, to

Aby podłączyć dysk z interfejsem SAS, należy użyć kabla przedstawionego na diagramie

Symbol przedstawiony na ilustracji wskazuje na produkt