Pytanie 1

Programem służącym do archiwizacji danych w systemie Linux jest

Wynik: 15/40 punktów (37,5%)

Wymagane minimum: 20 punktów (50%)

Programem służącym do archiwizacji danych w systemie Linux jest

W kontekście adresacji IPv6, użycie podwójnego dwukropka służy do

Z wykorzystaniem polecenia dxdiag uruchomionego z linii komend systemu Windows można

Wartość wyrażana w decybelach, będąca różnicą pomiędzy mocą sygnału przekazywanego w parze zakłócającej a mocą sygnału generowanego w parze zakłócanej to

Jakiego typu wkrętak należy użyć do wypięcia dysku twardego mocowanego w laptopie za pomocą podanych śrub?

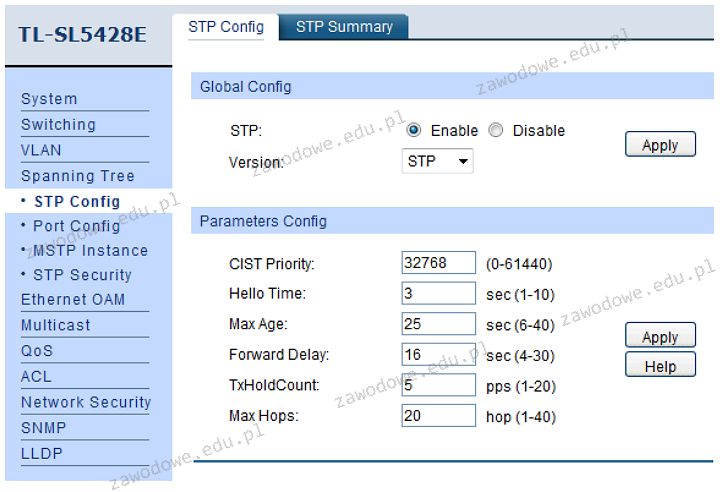

Analizując zrzut ekranu prezentujący ustawienia przełącznika, można zauważyć, że

W systemie Linux narzędzie, które umożliwia śledzenie trasy pakietów od źródła do celu, pokazując procentowe straty oraz opóźnienia, to

Z analizy oznaczenia pamięci DDR3 PC3-16000 można wywnioskować, że ta pamięć:

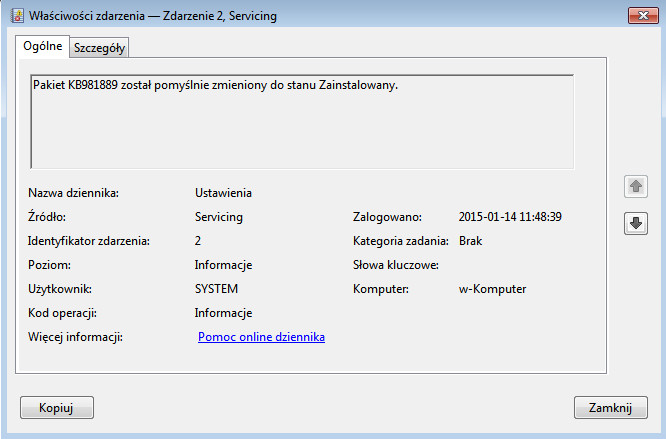

Wpis w dzienniku zdarzeń przedstawiony na ilustracji należy zakwalifikować do zdarzeń typu

Jakie polecenie pozwala na uzyskanie informacji o bieżących połączeniach TCP oraz o portach źródłowych i docelowych?

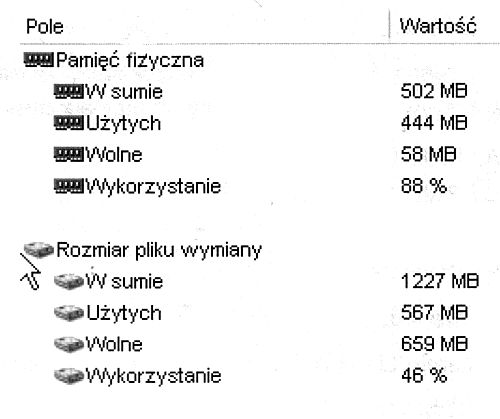

Zgodnie z zamieszczonym fragmentem testu w systemie komputerowym zainstalowane są

Co należy zrobić, gdy podczas uruchamiania komputera procedura POST zgłosi błąd odczytu lub zapisu w pamięci CMOS?

Przedstawione narzędzie podczas naprawy zestawu komputerowego przeznaczone jest do

FDDI (ang. Fiber Distributed Data Interface) jest standardem przesyłania danych opartym na technologii światłowodowej. Jaką topologię wykorzystuje się w sieciach zbudowanych według tej technologii?

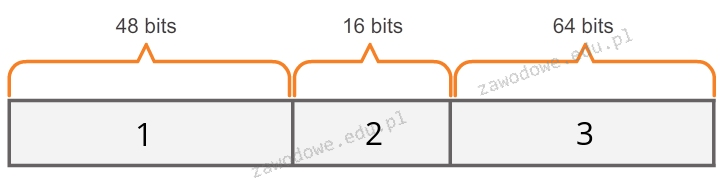

Jaką sekwencję mają elementy adresu globalnego IPv6 typu unicast ukazanym na diagramie?

Jaki typ grupy jest automatycznie przypisany dla nowo tworzonej grupy w kontrolerze domeny systemu Windows Server?

Jakie polecenie w systemie Windows powinno być użyte do obserwacji listy bieżących połączeń karty sieciowej w komputerze?

Trudności w systemie operacyjnym Windows wynikające z konfliktów dotyczących zasobów sprzętowych, takich jak przydział pamięci, przerwań IRQ oraz kanałów DMA, najłatwiej zidentyfikować za pomocą narzędzia

W oznaczeniu procesora INTEL CORE i7-4790 liczba 4 wskazuje na

Zamiana taśmy barwiącej jest związana z eksploatacją drukarki

Na stabilność obrazu w monitorach CRT istotny wpływ ma

Co oznacza zapis 192.168.1/24 w kontekście maski podsieci?

Aby połączyć projektor multimedialny z komputerem, złącze, którego NIEDOZWOLONO użyć to

Gdzie w dokumencie tekstowym Word umieszczony jest nagłówek oraz stopka?

Jakie narzędzie służy do usuwania izolacji z włókna światłowodowego?

Symbole i oznaczenia znajdujące się na zamieszczonej tabliczce znamionowej podzespołu informują między innymi o tym, że produkt jest

EN IEC 60276:2019 to przykład oznaczenia normy

Aby zapewnić możliwość odzyskania ważnych danych, należy regularnie

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Aby przywrócić dane z sformatowanego dysku twardego, konieczne jest zastosowanie programu

Usługi na serwerze są konfigurowane za pomocą

Narzędziem do monitorowania wydajności i niezawodności w systemach Windows 7, Windows Server 2008 R2 oraz Windows Vista jest

Korzystając z podanego urządzenia, możliwe jest przeprowadzenie analizy działania

Dane dotyczące kont użytkowników w systemie Linux są przechowywane w pliku

Po wykonaniu eksportu klucza HKCU zostanie zapisana kopia rejestru zawierająca informacje, dotyczące konfiguracji

Zjawisko przenikania, które ma miejsce w sieciach komputerowych, polega na

Jakie napięcie zasilające mają pamięci DDR2?

W systemie Linux komenda tty pozwala na

Serwer WWW o otwartym kodzie źródłowym, który działa na różnych systemach operacyjnych, to

Możliwość bezprzewodowego połączenia komputera z siecią Internet za pomocą tzw. hotspotu będzie dostępna po zainstalowaniu w nim karty sieciowej posiadającej