Pytanie 1

Najwyższą prędkość transmisji danych w sieci bezprzewodowej zapewnia standard

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Najwyższą prędkość transmisji danych w sieci bezprzewodowej zapewnia standard

Który z protokołów pełni rolę protokołu połączeniowego?

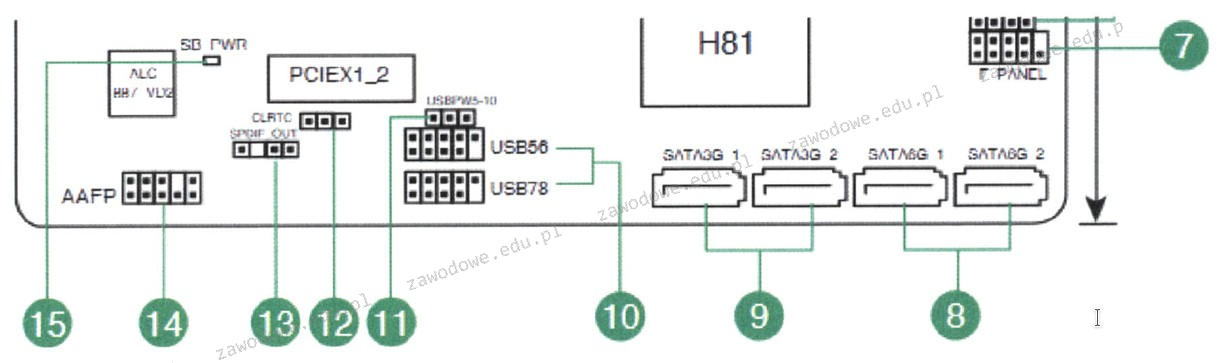

Na diagramie płyty głównej, który znajduje się w dokumentacji laptopa, złącza oznaczone numerami 8 i 9 to

Która norma odnosi się do okablowania strukturalnego?

Po włączeniu komputera wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Może to być spowodowane

Jaki protokół aplikacyjny w modelu TCP/IP pozwala klientowi na nawiązanie bezpiecznego połączenia z firmowym serwerem przez Internet, aby zyskać dostęp do zasobów przedsiębiorstwa?

Aby zapewnić bezpieczną komunikację terminalową z serwerem, powinno się skorzystać z połączenia z użyciem protokołu

Partycja w systemie Linux, która tymczasowo przechowuje dane w przypadku niedoboru pamięci RAM, to

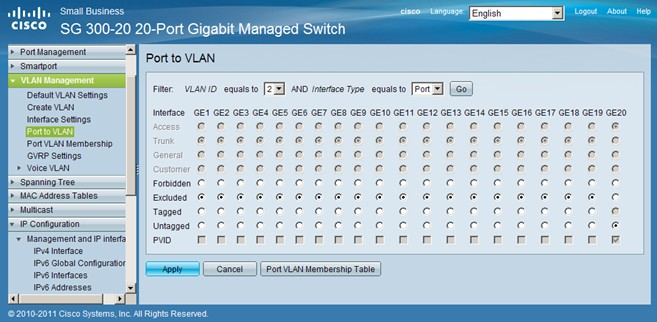

Na ilustracji zaprezentowano układ

Dodatkowe właściwości wyniku operacji przeprowadzanej przez jednostkę arytmetyczno-logiczna ALU zawiera

Które urządzenie poprawi zasięg sieci bezprzewodowej?

Bęben działający na zasadzie reakcji fotochemicznych jest wykorzystywany w drukarkach

Który z poniższych zapisów stanowi właściwy adres w wersji IPv6?

Aby w systemie Windows ustawić właściwości wszystkich zainstalowanych urządzeń lub wyświetlić ich listę, należy użyć narzędzia

Kabel pokazany na ilustracji może być zastosowany do realizacji okablowania sieci o standardzie

Producent wyświetlacza LCD stwierdził, że spełnia on wymagania klasy II według normy ISO 13406-2. Na podstawie danych przedstawionych w tabeli określ, ile pikseli z defektem typu 3 musi wystąpić na wyświetlaczu o naturalnej rozdzielczości 1280x800 pikseli, aby uznać go za uszkodzony?

| Klasa | Maksymalna liczba dopuszczalnych błędów na 1 milion pikseli | ||

|---|---|---|---|

| Typ 1 | Typ 2 | Typ 3 | |

| I | 0 | 0 | 0 |

| II | 2 | 2 | 5 |

| III | 5 | 15 | 50 |

| IV | 50 | 150 | 500 |

Symbol przedstawiony na ilustracji oznacza rodzaj złącza

Które bity w 48-bitowym adresie MAC identyfikują producenta?

Adres IP jest zapisany jako cztery grupy liczb, które są oddzielone kropkami

Komenda msconfig uruchamia w systemie Windows:

Do usunięcia elementu Wszystkie programy z prostego Menu Start systemu Windows należy wykorzystać przystawkę

Jakie polecenie trzeba wydać w systemie Windows, aby zweryfikować tabelę mapowania adresów IP na adresy MAC wykorzystywane przez protokół ARP?

Który przyrząd należy wykorzystać do uzyskania wyników testu POST dla modułów płyty głównej?

Jakie urządzenie umożliwia połączenie sieci lokalnej z siecią rozległą?

Karta sieciowa w standardzie Fast Ethernet umożliwia przesył danych z maksymalną prędkością

Wskaż cechę platformy wirtualizacji Hyper-V.

NIEWŁAŚCIWE podłączenie taśmy sygnałowej do napędu dyskietek skutkuje

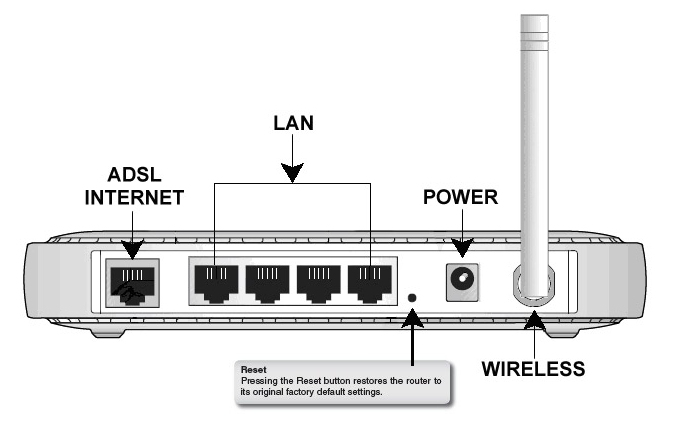

Przycisk znajdujący się na obudowie rutera, którego charakterystyka została podana w ramce, służy do

Numer przerwania przypisany do karty sieciowej został zapisany w systemie binarnym jako 10101. Ile to wynosi w systemie dziesiętnym?

Do obserwacji stanu urządzeń w sieci wykorzystywane jest oprogramowanie operujące na podstawie protokołu

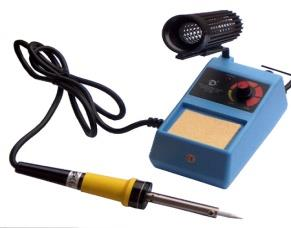

Na ilustracji widoczne jest urządzenie służące do

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Zamieszczony poniżej diagram ilustruje zasadę działania skanera

Obniżenie ilości jedynek w masce pozwala na zaadresowanie

Do konwersji kodu źródłowego na program wykonywalny używany jest

Aby zainstalować serwer FTP w systemach z rodziny Windows Server, konieczne jest dodanie roli serwera

Jakie medium transmisyjne powinno być użyte do połączenia dwóch punktów dystrybucyjnych oddalonych o 600m?

Wtyczka zaprezentowana na fotografii stanowi element obwodu elektrycznego zasilającego

W systemie Linux komendą, która jednocześnie podnosi uprawnienia dla procesu uruchamianego z terminala, jest

Jak wygląda sekwencja w złączu RJ-45 według normy TIA/EIA-568 dla zakończenia typu T568B?