Pytanie 1

Jak określić długość prefiksu adresu sieci w adresie IPv4?

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Jak określić długość prefiksu adresu sieci w adresie IPv4?

Jakie narzędzie w systemie Windows służy do przeglądania informacji dotyczących problemów z systemem?

Rodzaj przesyłania danych do jednego lub wielu komputerów jednocześnie, w którym odbiorcy są postrzegani przez nadawcę jako jedyny zbiorczy odbiorca, to

Minimalna odległość toru nieekranowanego kabla sieciowego od instalacji elektrycznej oświetlenia powinna wynosić

Na przedstawionym rysunku widoczna jest karta rozszerzeń z systemem chłodzenia

Wskaż komponent, który nie jest zgodny z płytą główną o parametrach przedstawionych w tabeli

| Podzespół | Parametry |

|---|---|

| Płyta główna GIGABYTE | 4x DDR4, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8 x USB 2.0, S-AM3+ |

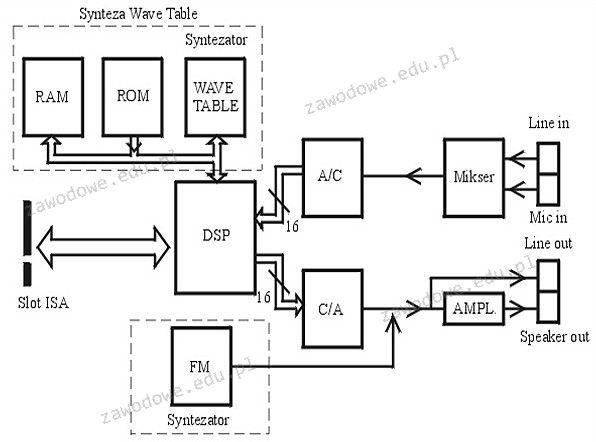

Na ilustracji zaprezentowano schemat działania

Jaki protokół jest używany do ściągania wiadomości e-mail z serwera pocztowego na komputer użytkownika?

Według modelu TCP/IP protokoły DNS, FTP i SMTP są przypisane do warstwy

Adres IP (ang. Internet Protocol Address) to

Jakim interfejsem można osiągnąć przesył danych o maksymalnej przepustowości 6Gb/s?

Aby zrealizować wymianę informacji między dwoma odmiennymi sieciami, konieczne jest użycie

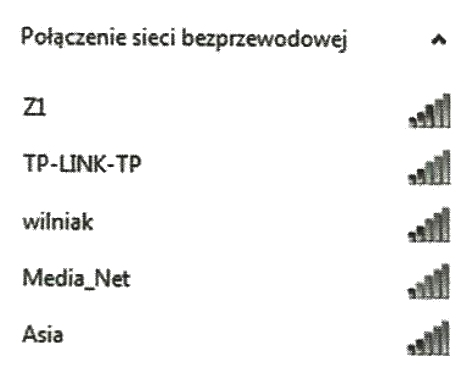

Użytkownik laptopa z systemem Windows 7 widzi dostępne sieci Wi-Fi, jak przedstawiono na ilustracji. Przy konfiguracji połączenia z siecią Z1 musi wprowadzić

Jeden długi oraz dwa krótkie sygnały dźwiękowe BIOS POST od firm AMI i AWARD wskazują na wystąpienie błędu

W jakiej fizycznej topologii sieci komputerowej każdy węzeł ma łączność fizyczną z każdym innym węzłem w sieci?

Do monitorowania aktywnych połączeń sieciowych w systemie Windows służy polecenie

Gdy w przeglądarce internetowej wpiszemy adres HTTP, pojawia się błąd "403 Forbidden", co oznacza, że

Sprzęt używany w sieciach komputerowych, posiadający dedykowane oprogramowanie do blokowania nieautoryzowanego dostępu do sieci, to

Do weryfikacji integralności systemu plików w środowisku Linux trzeba zastosować polecenie

Wykonanie polecenia tar –xf dane.tar w systemie Linux spowoduje

Po wykonaniu podanego skryptu

| echo off |

| echo ola.txt >> ala.txt |

| pause |

Który adres stacji roboczej należy do klasy C?

Jakie urządzenia wyznaczają granice domeny rozgłoszeniowej?

Pamięć oznaczona jako PC3200 nie jest kompatybilna z magistralą

Którą kartę rozszerzeń w komputerze przedstawia to zdjęcie?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Rodzajem macierzy RAID, która nie jest odporna na awarię dowolnego z dysków wchodzących w jej skład, jest

Jak nazywa się magistrala, która w komputerze łączy procesor z kontrolerem pamięci i składa się z szyny adresowej, szyny danych oraz linii sterujących?

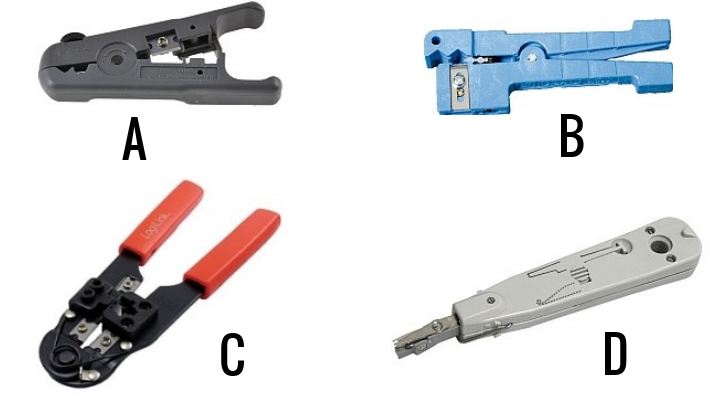

Jakie narzędzie wykorzystuje się do przytwierdzania kabla w module Keystone?

W którym typie macierzy, wszystkie fizyczne dyski są postrzegane jako jeden dysk logiczny?

Topologia fizyczna sieci, w której wykorzystywane są fale radiowe jako medium transmisyjne, nosi nazwę topologii

Jakie właściwości charakteryzują pojedyncze konto użytkownika w systemie Windows Serwer?

Komputer stracił łączność z siecią. Jakie działanie powinno być podjęte w pierwszej kolejności, aby naprawić problem?

Zidentyfikowanie głównego rekordu rozruchowego, który uruchamia system z aktywnej partycji, jest możliwe dzięki

Który z poniższych protokołów jest wykorzystywany do uzyskiwania dynamicznych adresów IP?

Podaj adres rozgłoszeniowy sieci, do której przynależy host o adresie 88.89.90.91/6?

Którym poleceniem można skonfigurować uprawnienia do zasobów sieciowych w systemie Windows?

Jakie urządzenie powinno być użyte, aby poprawić zasięg sieci bezprzewodowej w obiekcie?

Aktywacja opcji OCR w procesie ustawiania skanera umożliwia

Prezentowany komunikat pochodzi z wykonania polecenia