Pytanie 1

Wykonanie polecenia net localgroup w systemie Windows spowoduje

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Wykonanie polecenia net localgroup w systemie Windows spowoduje

W systemie Linux do obserwacji działania sieci, urządzeń sieciowych oraz serwerów można zastosować aplikację

Jakie urządzenie powinno zostać wykorzystane do podłączenia komputerów, aby mogły funkcjonować w odrębnych domenach rozgłoszeniowych?

Nie wykorzystuje się do zdalnego kierowania stacjami roboczymi

Uszkodzenie mechaniczne dysku twardego w komputerze stacjonarnym może być spowodowane

Który z interfejsów stanowi port równoległy?

W architekturze sieci lokalnych opartej na modelu klient - serwer

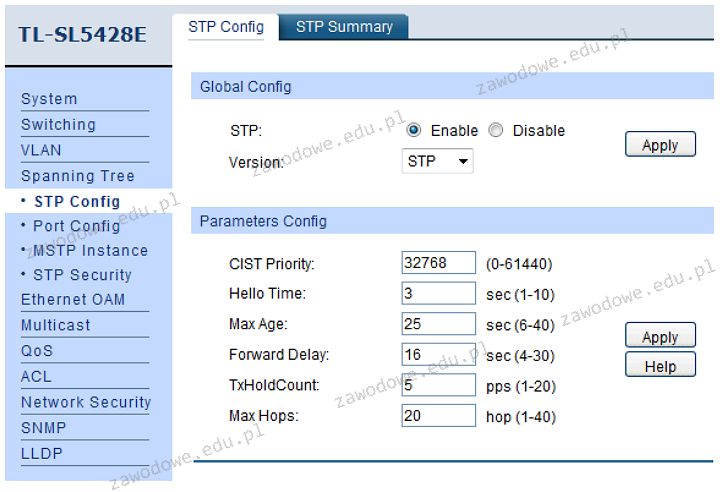

Analizując zrzut ekranu prezentujący ustawienia przełącznika, można zauważyć, że

Przedstawiona na diagramie strategia zapisu kopii zapasowych na nośnikach nosi nazwę

| Day | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | 11 | 12 | 13 | 14 | 15 | 16 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Media Set | A | A | A | A | A | A | A | A | ||||||||

| B | B | B | B | |||||||||||||

| C | C | C | ||||||||||||||

| E |

Wskaż podzespół niekompatybilny z płytą główną o przedstawionych w tabeli parametrach.

| Podzespół | Parametry |

|---|---|

| Płyta główna GIGABYTE | 4x DDR4, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8x USB 2.0, S-AM3+ |

Jaką komendę należy wpisać w miejsce kropek, aby w systemie Linux wydłużyć standardowy odstęp czasowy między kolejnymi wysyłanymi pakietami przy użyciu polecenia ping?

Dane dotyczące błędów w funkcjonowaniu systemu operacyjnego Linux można uzyskać przy użyciu narzędzia

Co oznacza oznaczenie kabla skrętkowego S/FTP?

Po podłączeniu działającej klawiatury do któregokolwiek z portów USB nie ma możliwości wyboru awaryjnego trybu uruchamiania systemu Windows. Jednakże, klawiatura funkcjonuje prawidłowo po uruchomieniu systemu w standardowym trybie. Co to sugeruje?

Który z poniższych protokołów nie jest wykorzystywany do konfiguracji wirtualnej sieci prywatnej?

Udostępniono w sieci lokalnej jako udział specjalny folder o nazwie egzamin znajdujący się na komputerze o nazwie SERWER_2 w katalogu głównym dysku C:. Jak powinna wyglądać ścieżka dostępu do katalogu egzamin, w którym przechowywany jest folder macierzysty dla konta użytkownika o określonym loginie?

Jaką maskę domyślną mają adresy IP klasy B?

Wskaź, które z poniższych stwierdzeń dotyczących zapory sieciowej jest nieprawdziwe?

Aby utworzyć programową macierz RAID-1, potrzebne jest minimum

W wyniku wykonania przedstawionych poleceń systemu Linux interfejs sieciowy eth0 otrzyma:

ifconfig eth0 10.0.0.100 netmask 255.255.255.0 broadcast 10.0.0.255 up route add default gw 10.0.0.10

Jakiej klasy adresów IPv4 dotyczą adresy, które mają dwa najbardziej znaczące bity ustawione na 10?

Aby utworzyć ukryty, udostępniony folder w systemie Windows Serwer, należy dodać na końcu jego nazwy odpowiedni znak

Jak nazywa się metoda dostępu do medium transmisyjnego z detekcją kolizji w sieciach LAN?

Członkostwo komputera w danej sieci wirtualnej nie może być ustalane na podstawie

Aby w systemie Windows nadać użytkownikowi możliwość zmiany czasu systemowego, potrzebna jest przystawka

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Dostosowanie ustawień parametrów TCP/IP urządzenia na podstawie adresu MAC karty sieciowej jest funkcją protokołu

Instalacja systemów Linux oraz Windows 7 przebiegła bez żadnych problemów. Systemy zainstalowały się poprawnie z domyślnymi ustawieniami. Na tym samym komputerze, przy tej samej konfiguracji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

Dysk twardy podczas pracy stuka i można zaobserwować bardzo powolne uruchamianie systemu oraz odczytywanie danych. Aby naprawić tę usterkę, po zabezpieczeniu danych na nośniku zewnętrznym należy

W systemie Linux do monitorowania użycia procesora, pamięci, procesów i obciążenia systemu służy polecenie

Zestaw narzędzi niezbędnych do instalacji okablowania miedzianego typu "skrętka" w lokalnej sieci powinien obejmować

Jakie urządzenie pracuje w warstwie łącza danych i umożliwia integrację segmentów sieci o różnych architekturach?

Która operacja może skutkować nieodwracalną utratą danych w przypadku awarii systemu plików?

Najefektywniejszym zabezpieczeniem danych firmy, której siedziby znajdują się w różnych, odległych od siebie lokalizacjach, jest zastosowanie

W dokumentacji płyty głównej podano informację "wsparcie dla S/PDIF Out". Co to oznacza w kontekście tej płyty głównej?

W adresacji IPv6 standardowy podział długości dla adresu sieci oraz identyfikatora hosta wynosi odpowiednio

W sieci lokalnej, aby chronić urządzenia sieciowe przed przepięciami oraz różnicami napięć, które mogą wystąpić w trakcie burzy lub innych wyładowań atmosferycznych, należy zastosować

Prezentowana usterka ekranu laptopa może być spowodowana

Na załączonym zdjęciu znajduje się

Jakość skanowania można poprawić poprzez zmianę