Pytanie 1

Która z licencji ma charakter grupowy i pozwala instytucjom komercyjnym oraz organizacjom edukacyjnym, państwowym i charytatywnym na zakup większej ilości oprogramowania firmy Microsoft na korzystnych zasadach?

Wynik: 37/40 punktów (92,5%)

Wymagane minimum: 20 punktów (50%)

Która z licencji ma charakter grupowy i pozwala instytucjom komercyjnym oraz organizacjom edukacyjnym, państwowym i charytatywnym na zakup większej ilości oprogramowania firmy Microsoft na korzystnych zasadach?

Wykonanie polecenia tar –xf dane.tar w systemie Linux spowoduje

Jaką klasę adresów IP reprezentuje publiczny adres 130.140.0.0?

Urządzenie komputerowe, które powinno być koniecznie podłączone do zasilania za pomocą UPS, to

Jakie urządzenia wykorzystuje się do porównywania liczb w systemie binarnym?

Użytkownik uszkodził płytę główną z gniazdem dla procesora AM2. Płytę z uszkodzeniami można wymienić na model z gniazdem, nie zmieniając procesora oraz pamięci

Na zdjęciu ukazano złącze zasilające

Wartość wyrażana w decybelach, będąca różnicą pomiędzy mocą sygnału przekazywanego w parze zakłócającej a mocą sygnału generowanego w parze zakłócanej to

Jaki protokół umożliwia nawiązywanie szyfrowanych połączeń terminalowych z zdalnym komputerem?

Podczas wymiany uszkodzonej karty graficznej, która współpracowała z monitorem posiadającym jedynie wejście analogowe, jaką kartę należy wybrać?

Jaki protokół sygnalizacyjny jest wykorzystywany w technologii VoIP?

Urządzenie przedstawione na rysunku

Switch jako kluczowy komponent występuje w sieci o strukturze

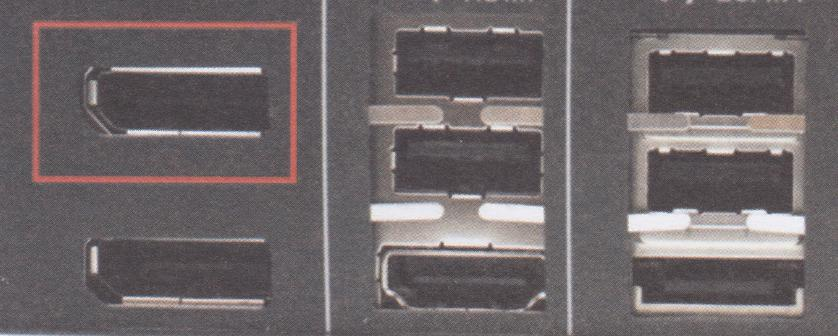

Na ilustracji, złącze monitora zaznaczone czerwoną ramką, będzie kompatybilne z płytą główną, która ma interfejs

Który protokół z warstwy aplikacji reguluje przesyłanie wiadomości e-mail?

Menedżer urządzeń w systemie Windows umożliwia identyfikację

Który z wymienionych formatów płyt głównych charakteryzuje się najmniejszymi wymiarami?

Zgodnie z przedstawionymi zaleceniami dla drukarki atramentowej, kolorowe dokumenty powinny być drukowane przynajmniej

„Czyszczenie głowicy drukarki …. ….. W tym przypadku najskuteczniejszym rozwiązaniem jest wyczyszczenie głowicy drukarki z zaschniętego tuszu. Z reguły wystarcza przetarcie głównego źródła problemu wilgotnym ręcznikiem. Jeżeli to nie pomoże należy zassać tusz do dysz, co pozwoli usunąć z nich powietrze. ….. Kiedy również i to nie pomoże należy przejść do ręcznego czyszczenia głowicy. Drukarka….. powinna być wyłączana na noc, ponieważ po każdym włączeniu przeprowadzane są mini cykle czyszczenia. Warto również pamiętać o wydrukowaniu przynajmniej raz w tygodniu kolorowego dokumentu, dzięki czemu zminimalizujemy prawdopodobieństwo zaschnięcia tuszu." Fragment instrukcji czyszczenia drukarki |

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Nie jest możliwe wykonywanie okresowych kopii zapasowych dysków serwera na nośnikach wymiennych typu

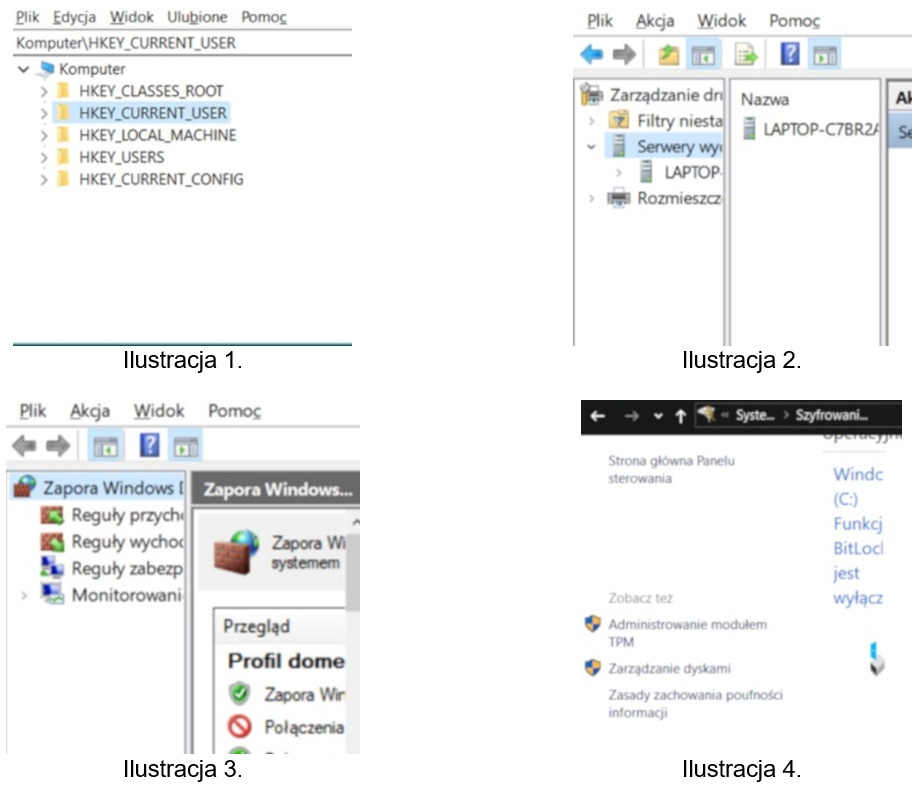

Na której ilustracji przedstawiono Edytor rejestru w systemie Windows?

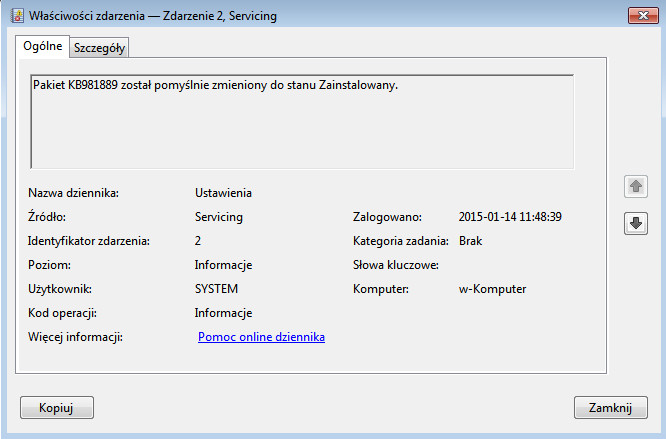

Wpis w dzienniku zdarzeń przedstawiony na ilustracji należy zakwalifikować do zdarzeń typu

Litera S w protokole FTPS odnosi się do zabezpieczania danych przesyłanych poprzez

W jakiej logicznej topologii funkcjonuje sieć Ethernet?

Na załączonym zdjęciu znajduje się

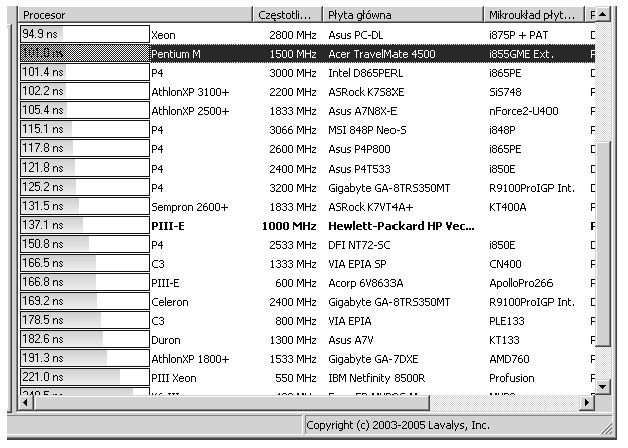

Na ilustracji zaprezentowano zrzut ekranu z wykonanej analizy

Ile urządzeń będzie można zaadresować w każdej podsieci, jeśli sieć 172.16.6.0 zostanie podzielona przy pomocy maski /27 na jak największą liczbę podsieci?

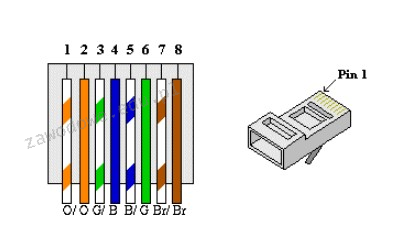

Na rysunku przedstawiono schemat ethernetowego połączenia niekrosowanych, ośmiopinowych złączy 8P8C. Jaką nazwę nosi ten schemat?

Włączenie systemu Windows w trybie debugowania umożliwia

Minimalna zalecana ilość pamięci RAM dla systemu operacyjnego Windows Server 2008 wynosi przynajmniej

W systemie Linux narzędzie do śledzenia zużycia CPU, pamięci, procesów oraz obciążenia systemu z poziomu terminala to

W topologii elementem centralnym jest switch

Gdy system operacyjny laptopa działa normalnie, na ekranie wyświetla się komunikat o konieczności sformatowania wewnętrznego dysku twardego. Może to sugerować

Nośniki informacji, takie jak dysk twardy, gromadzą dane w jednostkach określanych jako sektory, których rozmiar wynosi

W formacie plików NTFS, do zmiany nazwy pliku potrzebne jest uprawnienie

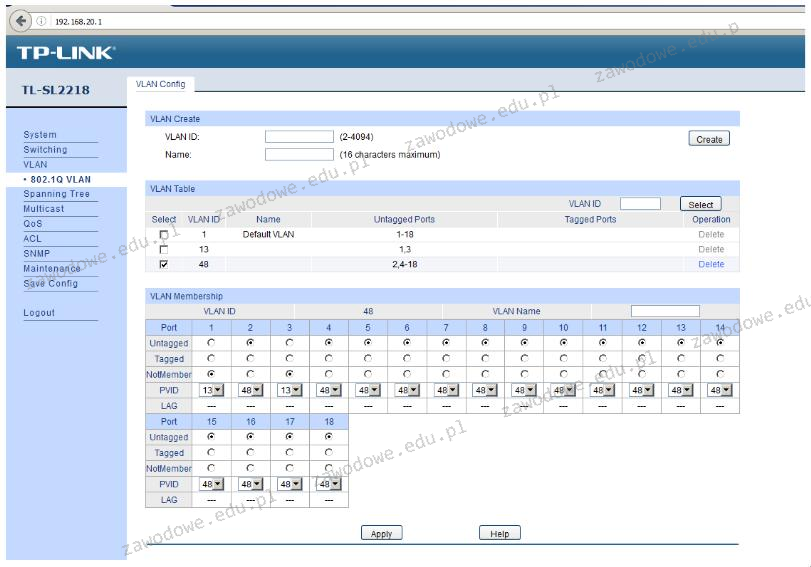

Na ilustracji zaprezentowano konfigurację urządzenia, co sugeruje, że

Aby zabezpieczyć komputery w lokalnej sieci przed nieautoryzowanym dostępem oraz atakami typu DoS, konieczne jest zainstalowanie i skonfigurowanie

Który z poniższych programów służy do tworzenia kopii zapasowych systemu w systemie Windows?

Autorskie prawo osobiste twórcy do programu komputerowego

Jaki rodzaj kabla powinien być użyty do połączenia komputera w obszarze podlegającym wpływom zakłóceń elektromagnetycznych?