Pytanie 1

Narzędziem do zarządzania usługami katalogowymi w systemach Windows Server, które umożliwia przeniesienie komputerów do jednostki organizacyjnej wskazanej przez administratora, jest polecenie

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Narzędziem do zarządzania usługami katalogowymi w systemach Windows Server, które umożliwia przeniesienie komputerów do jednostki organizacyjnej wskazanej przez administratora, jest polecenie

Gdzie w systemie Linux umieszczane są pliki specjalne urządzeń, które są tworzone podczas instalacji sterowników?

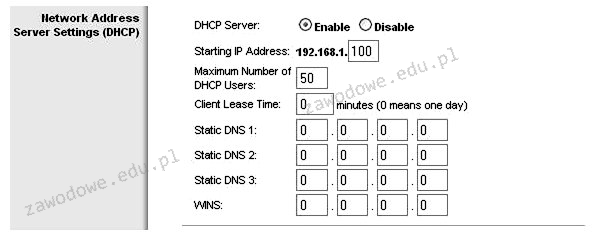

Ilustracja pokazuje panel ustawień bezprzewodowego urządzenia dostępowego, który umożliwia

Program Mozilla Firefox jest udostępniany na zasadach licencji

Zgodnie z normą PN-EN 50174, okablowanie poziome w systemie okablowania strukturalnego to segment okablowania pomiędzy

Ataki na systemy komputerowe, które odbywają się poprzez podstępne pozyskiwanie od użytkowników ich danych osobowych, często wykorzystywane są w postaci fałszywych komunikatów z różnych instytucji lub od dostawców usług e-płatności i innych znanych organizacji, to

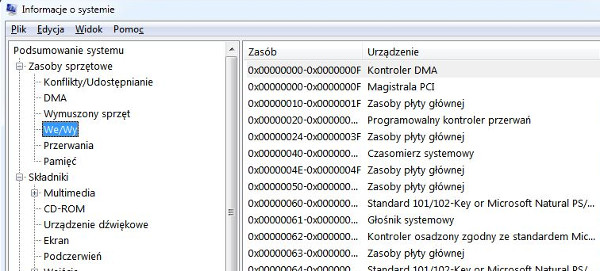

W jakim systemie numerycznym przedstawione są zakresy We/Wy na ilustracji?

Na ilustracji pokazano tylną część panelu

Wskaż usługę, którą należy skonfigurować na serwerze aby blokować ruch sieciowy?

Aby skaner działał prawidłowo, co należy zrobić?

Kiedy adres IP komputera ma formę 176.16.50.10/26, to jakie będą adres rozgłoszeniowy oraz maksymalna liczba hostów w danej sieci?

Przedstawiony na ilustracji symbol oznacza

Które z wymienionych mediów nie jest odpowiednie do przesyłania danych teleinformatycznych?

Thunderbolt to interfejs:

Jakie urządzenie należy wykorzystać w sieci Ethernet, aby zredukować liczbę kolizji pakietów?

Jakie złącze, które pozwala na podłączenie monitora, znajduje się na karcie graficznej pokazanej na ilustracji?

W systemie Windows, po dezaktywacji domyślnego konta administratora i ponownym uruchomieniu komputera

Aby zmienić istniejące konto użytkownika przy użyciu polecenia net user oraz wymusić reset hasła po kolejnej sesji logowania użytkownika, jaki parametr należy dodać do tego polecenia?

Ile adresów urządzeń w sieci jest dostępnych dzięki zastosowaniu klasy adresowej C w systemach opartych na protokołach TCP/IP?

Jaką konfigurację sieciową może posiadać komputer, który należy do tej samej sieci LAN co komputer z adresem 192.168.1.10/24?

Ile punktów abonenckich (2 x RJ45) powinno być zainstalowanych w biurze o powierzchni 49 m2, zgodnie z normą PN-EN 50167?

Do czego służy program firewall?

Jakie protokoły przesyłają cykliczne kopie tablic routingu do sąsiadującego rutera i NIE ZAWIERAJĄ pełnych informacji o dalekich ruterach?

Cechą oprogramowania służącego do monitorowania zdarzeń metodą Out-Of-Band w urządzeniach sieciowych jest

Aby skutecznie zabezpieczyć system operacyjny przed atakami złośliwego oprogramowania, po zainstalowaniu programu antywirusowego konieczne jest

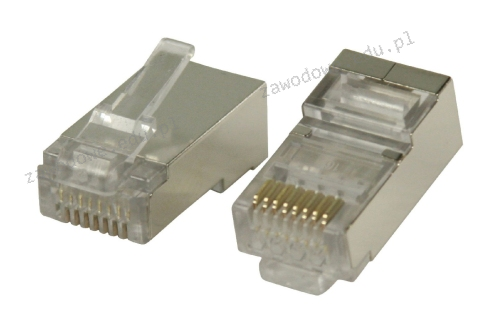

Wtyczka (modularne złącze męskie) przedstawiona na rysunku stanowi zakończenie przewodu

W jednostce ALU w akumulatorze zapisano liczbę dziesiętną 500. Jaką ona ma binarną postać?

Czym jest OTDR?

AES (ang. Advanced Encryption Standard) to?

Jakie jest oprogramowanie serwerowe dla systemu Linux, które pozwala na współdziałanie z grupami roboczymi oraz domenami Windows?

Impulsator pozwala na diagnozowanie uszkodzonych układów logicznych komputera między innymi poprzez

Po zainstalowaniu systemu Linux, użytkownik pragnie skonfigurować kartę sieciową poprzez wprowadzenie ustawień dotyczących sieci. Jakie działanie należy podjąć, aby to osiągnąć?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Do sprawdzenia, czy w okablowaniu występują odwrócone pary przewodów, stosowany jest test

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się działania usuwania starych plików oraz dodawania nowych plików, doświadcza

Diagnozowanie uszkodzonych komponentów komputera przez sprawdzenie stanu wyjściowego układu cyfrowego umożliwia

W przedsiębiorstwie trzeba było zreperować 5 komputerów i serwer. Czas potrzebny na naprawę każdego z komputerów wyniósł 1,5 godziny, a serwera 2,5 godziny. Stawka za usługę to 100,00 zł za roboczogodzinę, a do tego doliczany jest podatek VAT w wysokości 23%. Jaka kwota brutto będzie należna za tę usługę?

W usłudze, jaką funkcję pełni protokół RDP?

Jak przywrócić stan rejestru systemowego w edytorze Regedit, wykorzystując wcześniej utworzoną kopię zapasową?

Jaki akronim oznacza program do tworzenia graficznych wykresów ruchu, który odbywa się na interfejsach urządzeń sieciowych?