Pytanie 1

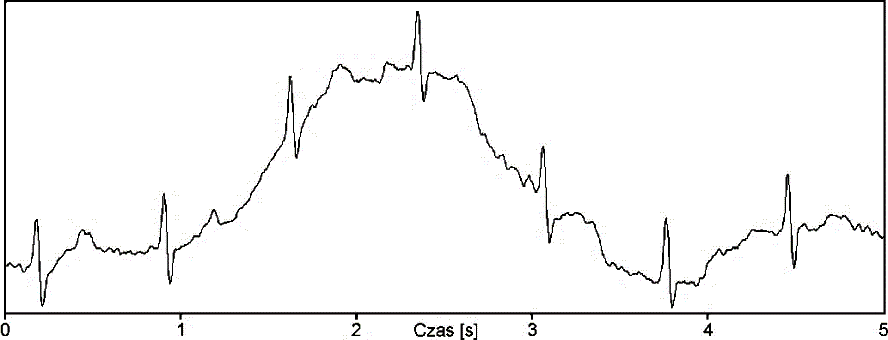

Na rysunku przedstawiono badanie za pomocą

Wynik: 40/40 punktów (100,0%)

Wymagane minimum: 20 punktów (50%)

Na rysunku przedstawiono badanie za pomocą

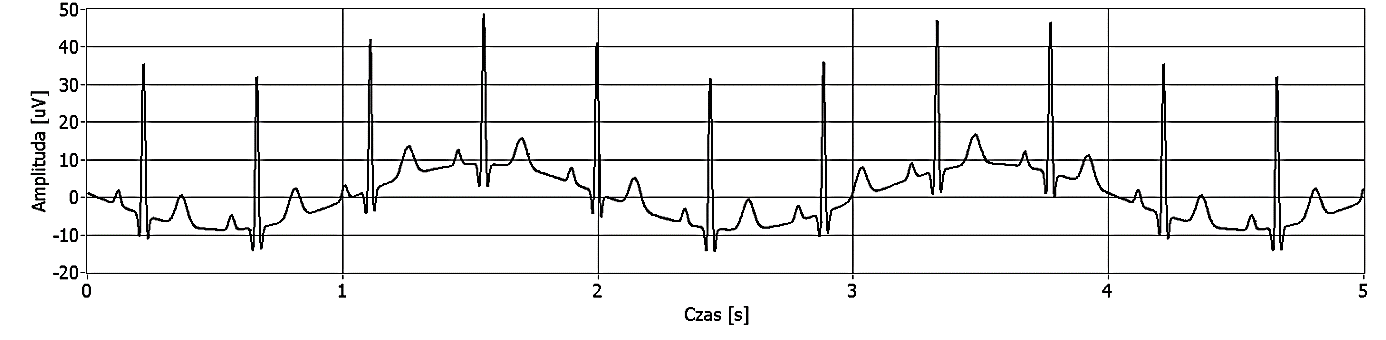

Pod wpływem bodźca świetlnego, dźwiękowego lub czuciowego mózg generuje elektryczne potencjały wywołane rejestrowane przez

W programowaniu obiektowym zmienne widoczne w ramach klasy oraz poza nią nazywane są

Zaćma fotochemiczna jest wywołana promieniowaniem

W dokumentacji sieci centralnego monitoringu zapisano, że sieć jest wykonana w standardzie 802.11 Do montażu takiej sieci są wymagane urządzenia wykorzystujące

Za pomocą oscyloskopu nie można zmierzyć bezpośrednio

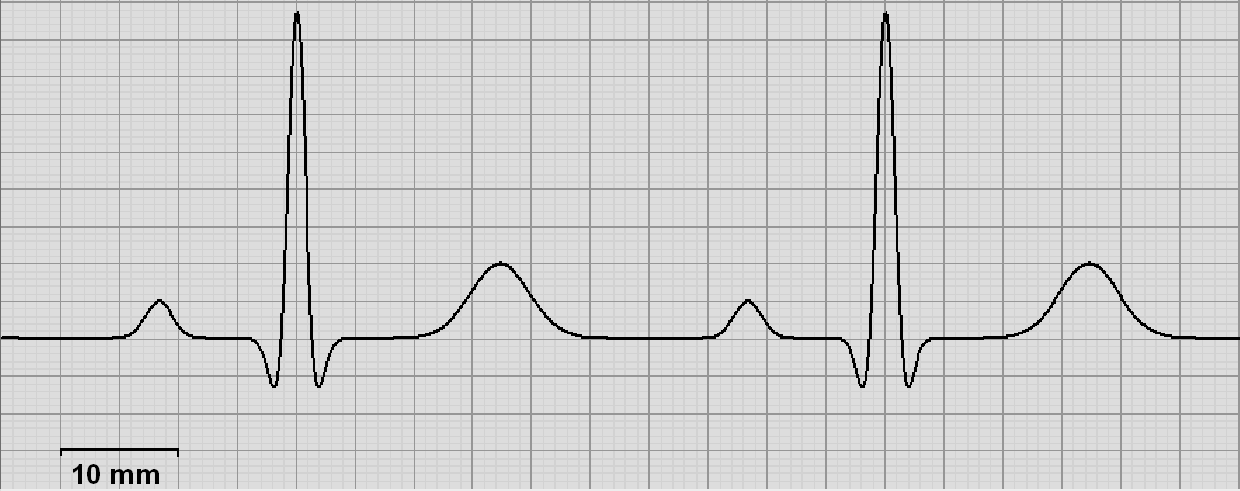

Z elektrokardiogramu wynika, że rytm serca rejestrowany i wskazywany przez elektrokardiograf wynosi

Jeżeli węzeł zatokowo–przedsionkowy będzie pobudzał serce generując bodźce elektryczne z częstotliwością 1 Hz, to wartość rytmu serca będzie wynosiła

Narzędzie przedstawione na rysunku służy do

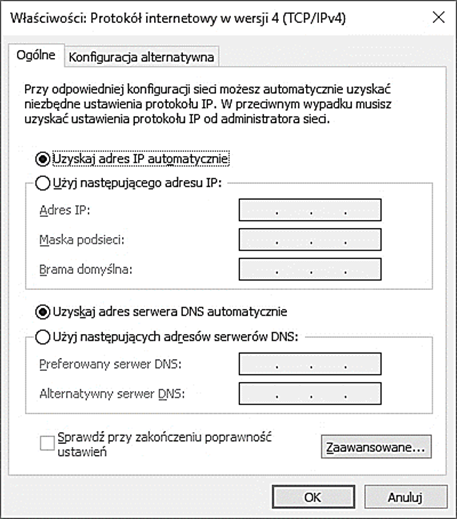

Aby karta sieciowa automatycznie uzyskiwała adres IP, ruter musi mieć włączony serwer

Przepływ przez organizm człowieka prądów o wysokiej częstotliwości, mających zastosowanie w elektrochirurgii, może powodować

Który z przedstawionych przyrządów służy do testowania połączeń w sieci LAN?

Programowanie obiektowe wykorzystuje dziedziczenie, które polega na

Wymieniając bezpiecznik w medycznym module zasilającym, wymagającym zastosowania wkładki topikowej zwłocznej, należy użyć elementu oznaczonego symbolem literowym

Jaki wpływ na organizm ludzki ma krioterapia?

Jaka jest prędkość przesuwu prezentowanego elektrokardiogramu, jeżeli zmierzona częstotliwość rytmu serca wynosi 60 uderzeń na minutę?

Który interfejs nie umożliwia podłączenia urządzeń peryferyjnych w standardzie „plug and play”?

Na rysunku przedstawiono kartę rozszerzeń umożliwiającą

Metoda diagnostyczna, w której rejestruje się rozpad radioizotopu wprowadzonego do organizmu, to

Do badań ultrasonograficznych struktur płytko położonych (np. tarczycy) stosuje się głowicę

Podczas testowania elektrokardiografu otrzymano przedstawiony przebieg. Na jego podstawie stwierdzono, że nieprawidłowo działa filtr zakłóceń

Elementem sieci komputerowej w topologii gwiazdy, pozwalającym przyłączyć wiele urządzeń sieciowych, jest

Rysunek przedstawia wynik działania polecenia ipconfig urządzenia w sieci LAN. Który adres rutera umożliwia dostęp tego urządzenia do sieci WAN?

Wybierz narzędzie służące do zamocowania przedstawionej na rysunku końcówki kompresyjnej F na kablu koncentrycznym.

Procesor GPU jest odpowiedzialny za wykonywanie operacji obliczeniowych w karcie

Zapis w dokumentacji układu holterowskiego „metoda pomiaru – oscylometryczna” świadczy o możliwości monitorowania

Który zabieg wymusza naprzemienną pracę mięśni zginaczy i prostowników poprzez stymulację mięśni impulsem prądowym?

Przedstawiony na rysunku kolimator stanowi część

Zmienne definiowane w programie głównym na zewnątrz wszystkich funkcji i procedur lub innych bloków programu określamy jako zmienne

Znak ~ na początku ciągu znaków w systemach uniksowych oznacza

Struktura anatomiczna człowieka, która jest nazywana krytyczną ze względu na szczególną wrażliwość na zewnętrzne promieniowanie jonizujące, to

W systemie bazodanowym wymagane jest dodatkowe sprzętowe zabezpieczenie danych przed ich utratą. Która macierz dyskowa pozwala uodpornić się na utratę danych w przypadku awarii wszystkich dysków poza jednym?

Aby dodać nowe konto „rejestracja” w systemie Windows, należy wykorzystać polecenie

Który system plików zapewnia największe bezpieczeństwo danych w systemie Windows?

Podczas uruchamiania komputera procedura POST testuje poprawność działania

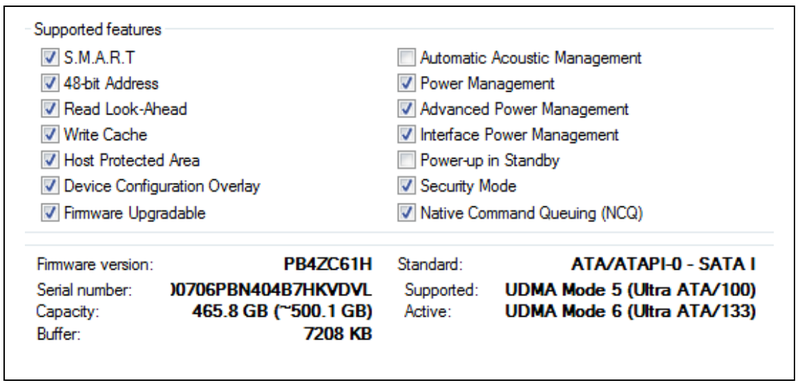

Przedstawiony zrzut ekranu prezentuje parametry

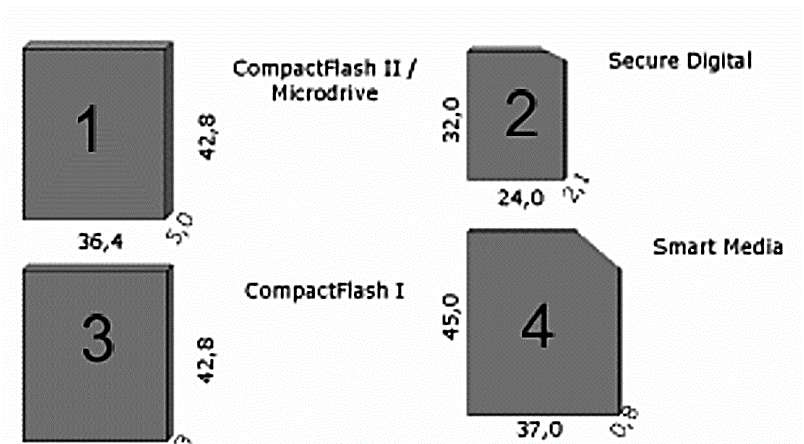

W aparacie holterowskim sygnał jest archiwizowany na karcie SD. Który rysunek przedstawia wymieniony nośnik pamięci?

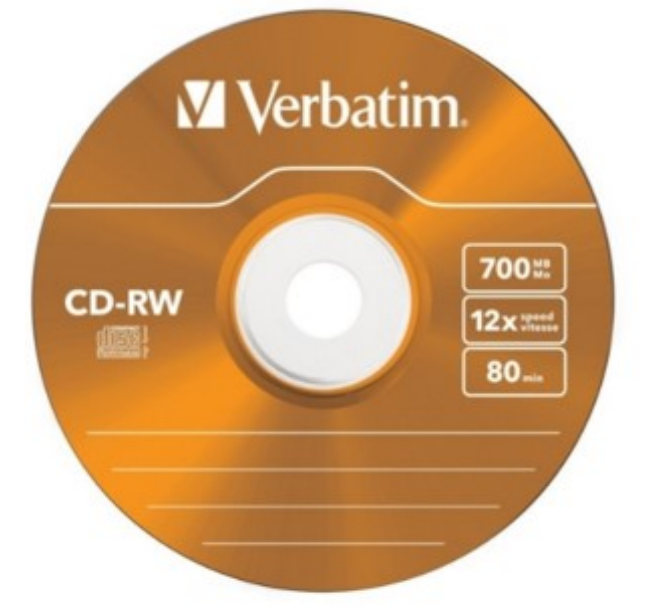

Który z nośników danych umożliwia wielokrotny zapis i ma największą pojemność?

Aby usunąć katalog w systemie Windows należy wykonać polecenie

Które urządzenie medyczne wspomaga lub zastępuje mięśnie pacjenta w oddychaniu?