Pytanie 1

Która z wymienionych właściwości kabla koncentrycznego RG-58 sprawia, że nie jest on obecnie używany do tworzenia lokalnych sieci komputerowych?

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Która z wymienionych właściwości kabla koncentrycznego RG-58 sprawia, że nie jest on obecnie używany do tworzenia lokalnych sieci komputerowych?

Protokół kontrolny z rodziny TCP/IP, który odpowiada między innymi za identyfikację usterek w urządzeniach sieciowych, to

Jakiego rodzaju interfejsem jest UDMA?

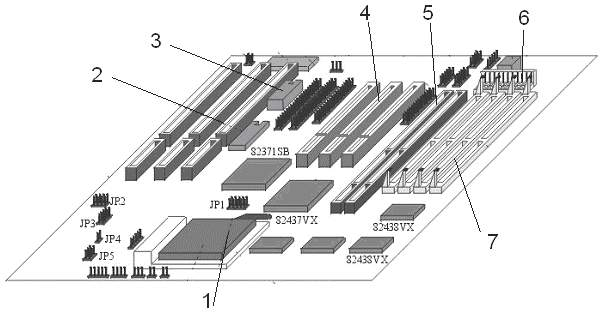

Na schemacie płyty głównej port PCI oznaczony jest numerem

Podaj domyślny port używany do przesyłania poleceń w serwerze FTP

Protokół trasowania wewnętrznego, który wykorzystuje metrykę wektora odległości, to

Które z urządzeń sieciowych jest przedstawione na grafice?

Jaki system plików powinien być wybrany przy instalacji systemu Linux?

W systemach Windows XP Pro/ Windows Vista Bizness/Windows 7 Pro/Windows 8 Pro, rozwiązaniem zapewniającym poufność danych dla użytkowników korzystających z jednego komputera, których informacje mogą być wykorzystywane wyłącznie przez nich, jest

W systemie Linux narzędzie, które umożliwia śledzenie trasy pakietów od źródła do celu, pokazując procentowe straty oraz opóźnienia, to

Dwie stacje robocze w tej samej sieci nie są w stanie się skomunikować. Która z poniższych okoliczności może być przyczyną opisanego problemu?

Administrator dostrzegł, że w sieci LAN występuje znaczna ilość kolizji. Jakie urządzenie powinien zainstalować, aby podzielić sieć lokalną na mniejsze domeny kolizji?

Która z poniższych informacji odnosi się do profilu tymczasowego użytkownika?

Trudności w systemie operacyjnym Windows wynikające z konfliktów dotyczących zasobów sprzętowych, takich jak przydział pamięci, przerwań IRQ oraz kanałów DMA, najłatwiej zidentyfikować za pomocą narzędzia

Metoda transmisji żetonu (ang. token) znajduje zastosowanie w topologii

Na ilustracji przedstawiono

Zintegrowana karta sieciowa na płycie głównej uległa awarii. Komputer nie może załadować systemu operacyjnego, ponieważ brakuje zarówno dysku twardego, jak i napędów optycznych, a system operacyjny jest uruchamiany z lokalnej sieci. W celu przywrócenia utraconej funkcjonalności, należy zainstalować w komputerze

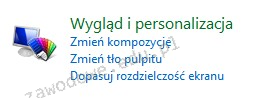

Na ilustracji ukazano narzędzie systemu Windows 7 służące do

Pierwszym krokiem, który należy podjąć, aby chronić ruter przed nieautoryzowanym dostępem do jego panelu administracyjnego, jest

Po wykonaniu instalacji z domyślnymi parametrami system Windows XP NIE OBSŁUGUJE formatu systemu plików

Aby przekształcić zeskanowany obraz na tekst, należy użyć oprogramowania, które stosuje techniki

Podczas normalnego działania systemu operacyjnego w laptopie pojawił się komunikat o konieczności formatowania wewnętrznego dysku twardego. Wskazuje on na

Który algorytm służy do weryfikacji, czy ramka Ethernet jest wolna od błędów?

Urządzenie trwale zainstalowane u abonenta, które zawiera zakończenie poziomego okablowania strukturalnego, to

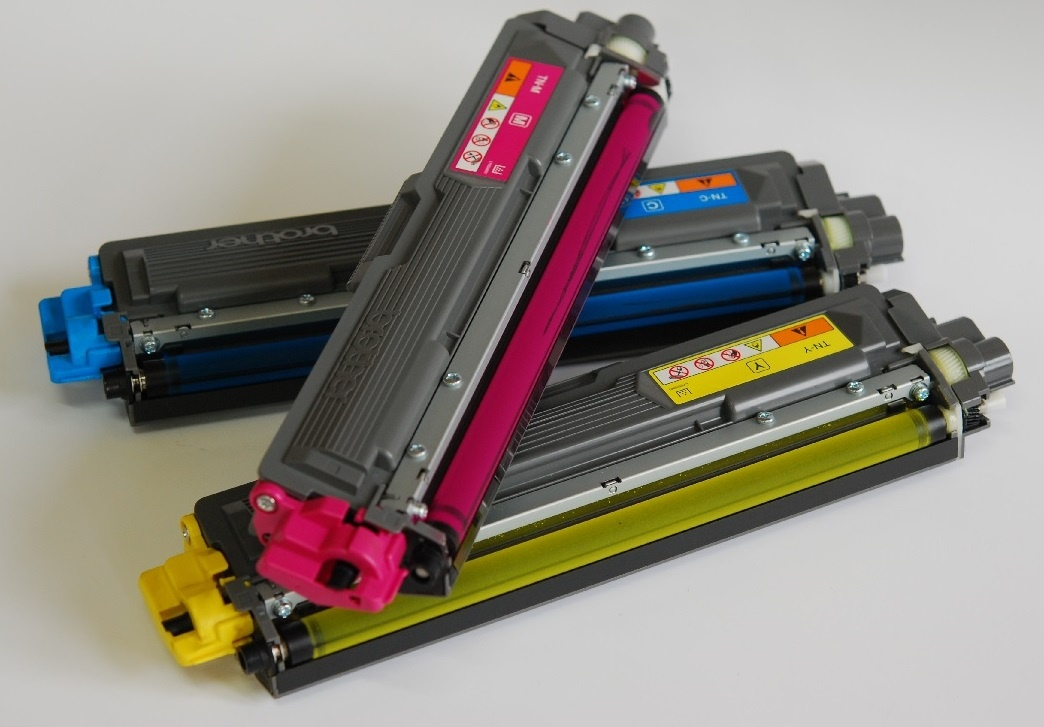

Jakim materiałem eksploatacyjnym posługuje się kolorowa drukarka laserowa?

Program firewall nie zapewnia ochrony przed

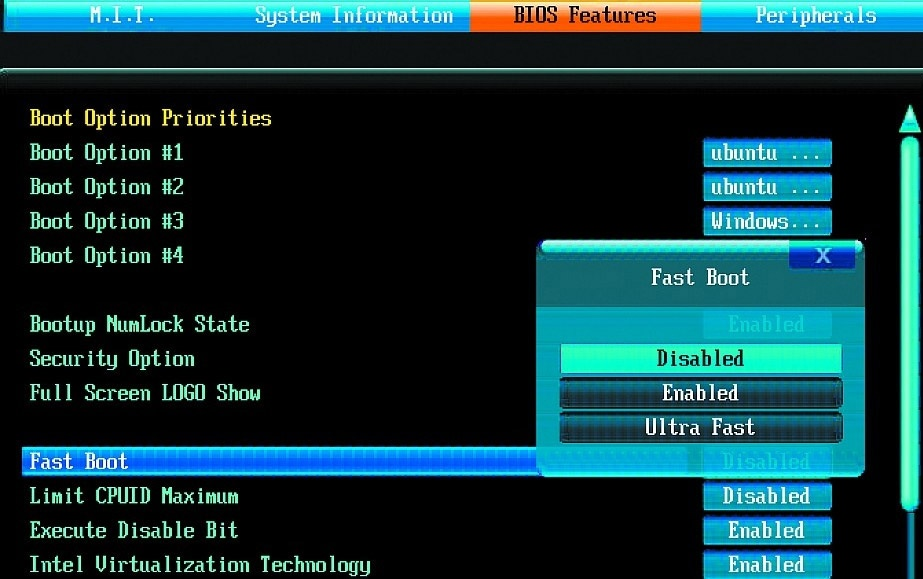

Co spowoduje zmiana opcji Fast Boot na wartość Enabledw konfiguracji BIOS przedstawionej na ilustracji?

Co oznacza skrót "DNS" w kontekście sieci komputerowych?

Symbol przedstawiony na ilustracji oznacza produkt

Na stabilność obrazu w monitorach CRT istotny wpływ ma

Który z wymienionych komponentów jest częścią mechanizmu drukarki igłowej?

Do konfiguracji i personalizacji środowiska graficznego GNOME w różnych systemach Linux należy wykorzystać program

Aby zwiększyć lub zmniejszyć rozmiar ikony na pulpicie, należy obracać kółkiem myszy, trzymając jednocześnie wciśnięty klawisz

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Magistrala PCI-Express do przesyłania danych stosuje metodę komunikacyjną

Rodzaj ataku komputerowego, który polega na pozyskiwaniu wrażliwych informacji osobistych poprzez podszywanie się pod zaufaną osobę lub instytucję, to

Jakie są przyczyny wyświetlenia na ekranie komputera komunikatu o wykryciu konfliktu adresów IP?

W celu doboru właściwej aktualizacji oprogramowania dla punktu dostępowego można skorzystać z identyfikacji

Jakie urządzenie wskazujące działa w reakcji na zmiany pojemności elektrycznej?

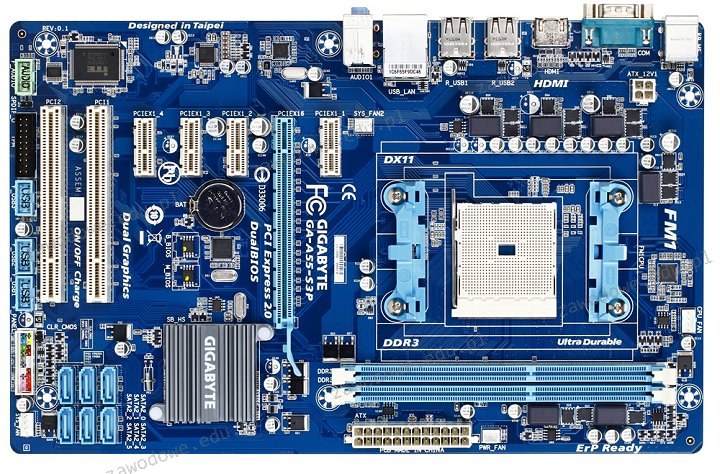

Jakim interfejsem można przesyłać dane między płyta główną, przedstawioną na ilustracji, a urządzeniem zewnętrznym, nie zasilając jednocześnie tego urządzenia przez ten interfejs?