Pytanie 1

W systemie Linux uruchomiono skrypt z czterema argumentami. Jak można uzyskać dostęp do listy wszystkich wartości w skrypcie?

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

W systemie Linux uruchomiono skrypt z czterema argumentami. Jak można uzyskać dostęp do listy wszystkich wartości w skrypcie?

Na ilustracji ukazano narzędzie systemu Windows 7 służące do

Urządzenie sieciowe funkcjonujące w trzeciej warstwie modelu ISO/OSI, posługujące się adresami IP, to

Wymianę uszkodzonych kondensatorów karty graficznej umożliwi

W systemie Linux można uzyskać kopię danych przy użyciu komendy

Aby zainstalować openSUSE oraz dostosować jego ustawienia, można skorzystać z narzędzia

Który z podanych programów pozwoli na stworzenie technicznego rysunku ilustrującego plan instalacji logicznej sieci lokalnej w budynku?

Do realizacji alternatywy logicznej z negacją należy użyć funktora

Który protokół należy do bezpołączeniowych protokołów warstwy transportowej?

Jakie jest standardowe połączenie między skanerem a aplikacją graficzną?

W systemie Windows, aby uruchomić usługę związaną z wydajnością komputera, należy użyć polecenia

Jaki skrót odpowiada poniższej masce podsieci: 255.255.248.0?

Jaki protokół umożliwia nawiązywanie szyfrowanych połączeń terminalowych z zdalnym komputerem?

Jak nazywa się protokół odpowiedzialny za wysyłkę wiadomości e-mail?

Elementem, który jest odpowiedzialny za utrwalanie tonera na kartce podczas drukowania z drukarki laserowej, jest

Jaką maksymalną prędkość przesyłania danych osiągają urządzenia zgodne ze standardem 802.11g?

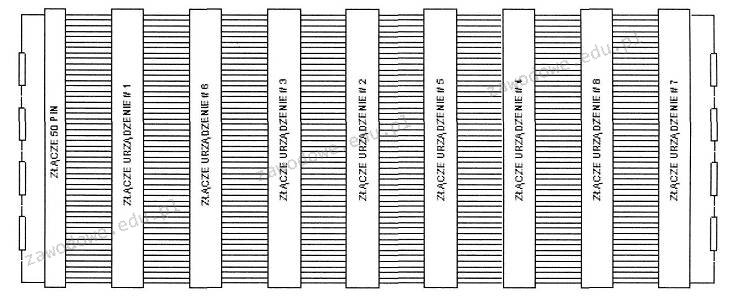

Za pomocą taśmy 60-pinowej pokazanej na ilustracji łączy się z płytą główną komputera

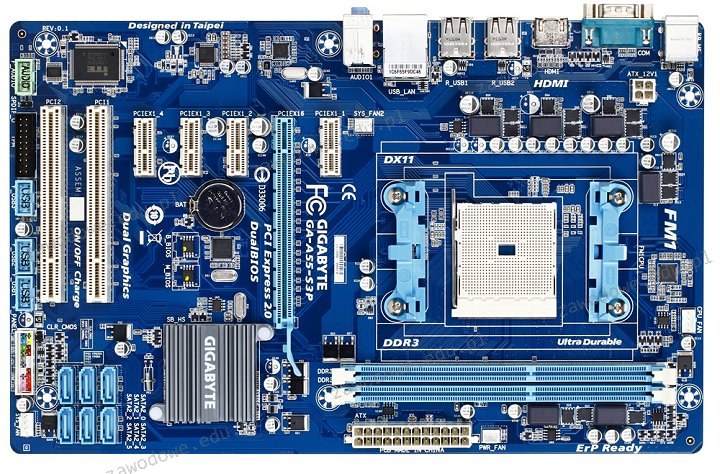

Jakie urządzenie ilustruje ten rysunek?

Na płycie głównej uszkodzona została zintegrowana karta sieciowa. Komputer nie ma zainstalowanego dysku twardego ani żadnych innych napędów, takich jak stacja dysków czy CD-ROM. Klient informuje, że w firmowej sieci komputery nie mają napędów, a wszystko "czyta" się z serwera. W celu przywrócenia utraconej funkcji należy zainstalować

Umowa, na mocy której użytkownik ma między innymi wgląd do kodu źródłowego oprogramowania w celu jego analizy oraz udoskonalania, to licencja

Jakie protokoły są klasyfikowane jako protokoły transportowe w modelu ISO/OSI?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W wierszu poleceń systemu Windows polecenie md jest używane do

Termin określający wyrównanie tekstu do prawego i lewego marginesu to

Grupa protokołów, która charakteryzuje się wspólną metodą szyfrowania, to

W systemie binarnym liczba 3FC7 będzie zapisana w formie:

Przy realizacji projektu dotyczącego sieci LAN wykorzystano medium transmisyjne standardu Ethernet 1000Base-T. Które z poniższych stwierdzeń jest prawdziwe?

Jakim interfejsem można przesyłać dane między płyta główną, przedstawioną na ilustracji, a urządzeniem zewnętrznym, nie zasilając jednocześnie tego urządzenia przez ten interfejs?

Który protokół umożliwia rozproszoną wymianę i ściąganie plików?

Na ilustracji pokazano część efektu działania programu przeznaczonego do testowania sieci. Sugeruje to użycie polecenia diagnostycznego w sieci

TCP 192.168.0.13:51614 bud02s23-in-f8:https ESTABLISHED TCP 192.168.0.13:51615 edge-star-mini-shv-01-ams3:https ESTABLISHED TCP 192.168.0.13:51617 93.184.220.29:http ESTABLISHED TCP 192.168.0.13:51619 93.184.220.29:http ESTABLISHED TCP 192.168.0.13:51620 93.184.220.29:http TIME_WAIT TCP 192.168.0.13:51621 bud02s23-in-f206:https TIME_WAIT TCP 192.168.0.13:51622 xx-fbcdn-shv-01-ams3:https ESTABLISHED TCP 192.168.0.13:51623 108.161.188.192:https ESTABLISHED TCP 192.168.0.13:51626 23.111.9.32:https TIME_WAIT TCP 192.168.0.13:51628 lg-in-f155:https ESTABLISHED TCP 192.168.0.13:51629 waw02s06-in-f68:https ESTABLISHED

Aby w systemie Windows XP stworzyć nowego użytkownika o nazwisku egzamin z hasłem qwerty, powinno się zastosować polecenie

Router w sieci LAN posiada przypisany adres IP 192.168.50.1. Został skonfigurowany w taki sposób, że przydziela komputerom wszystkie dostępne adresy IP w sieci 192.168.50.0 z maską 255.255.255.0. Jaka jest maksymalna liczba komputerów, które mogą działać w tej sieci?

Atak na system komputerowy przeprowadzany jednocześnie z wielu maszyn w sieci, który polega na zablokowaniu działania tego systemu przez zajęcie wszystkich dostępnych zasobów, określany jest mianem

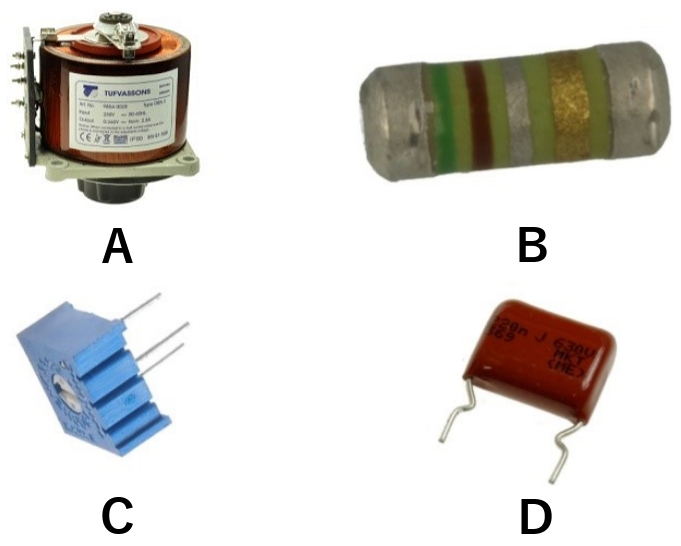

Wskaż ilustrację przedstawiającą kondensator stały?

Jakie cechy posiadają procesory CISC?

Serwis serwerowy, który pozwala na udostępnianie usług drukowania w systemie Linux oraz plików dla stacji roboczych Windows, to

Częścią eksploatacyjną drukarki laserowej nie jest

Która z poniższych informacji odnosi się do profilu tymczasowego użytkownika?

Aby zabezpieczyć system przed oprogramowaniem mającym możliwość reprodukcji, konieczne jest zainstalowanie

Komunikat "BIOS checksum error" pojawiający się podczas uruchamiania komputera zazwyczaj wskazuje na