Pytanie 1

Struktura anatomiczna człowieka, która jest nazywana krytyczną ze względu na szczególną wrażliwość na zewnętrzne promieniowanie jonizujące, to

Wynik: 36/40 punktów (90,0%)

Wymagane minimum: 20 punktów (50%)

Struktura anatomiczna człowieka, która jest nazywana krytyczną ze względu na szczególną wrażliwość na zewnętrzne promieniowanie jonizujące, to

W dokumentacji elektrokardiografu znajduje się informacja o wyposażeniu aparatu w filtry cyfrowe 50 Hz, 35 Hz i filtr antydriftowy. Które zakłócenia eliminuje z sygnału EKG filtr 50 Hz?

W celu rejestracji promieniowania radioizotopu nagromadzonego w narządach stosowana jest

Pojedynczy zapis w medycznej bazie danych, zawierający informację na temat jednego pacjenta, nazywa się

| id | imię | nazwisko | adres |

|---|---|---|---|

| 2354 | Konrad | Marek | ul. Kwiatowa15 Krzywodrogi |

| 2355 | Jakub | Warek | ul. Leśna 23 Krzywodrogi |

| 2356 | Krzysztof | Jurek | ul. Polna 14 Krzywodrogi |

Podstawowym elementem sztucznej nerki jest pompa do przetłaczania krwi, zwana

Przedstawiony fragment dokumentacji dotyczy

Częstotliwość: 2.0-10.0MHz; Tryb obrazowania: B, B/B, B/M, M, 4B; Dynamiczne 4-stopniowe ogniskowanie; |

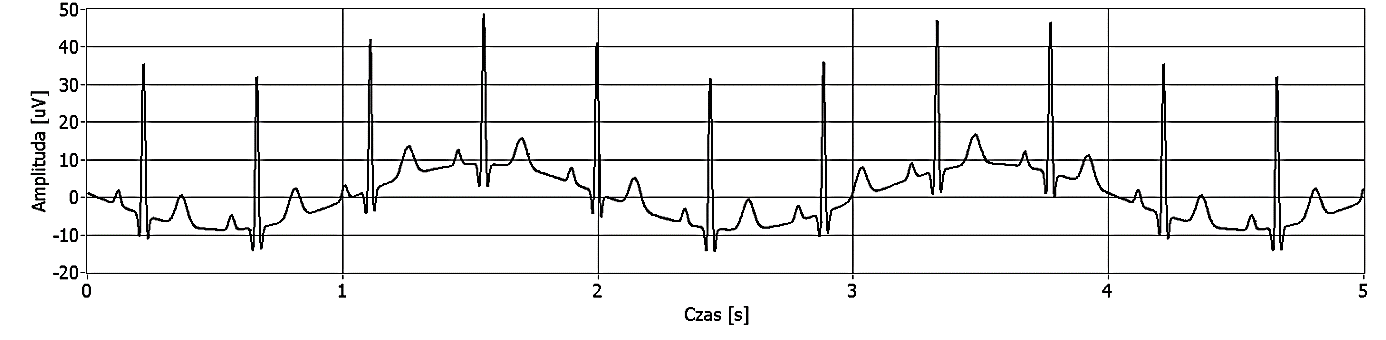

Podczas testowania elektrokardiografu otrzymano przedstawiony przebieg. Na jego podstawie stwierdzono, że nieprawidłowo działa filtr zakłóceń

Nie uzyskamy pomocy na temat polecenia „net” w wierszu poleceń systemu Windows wpisując

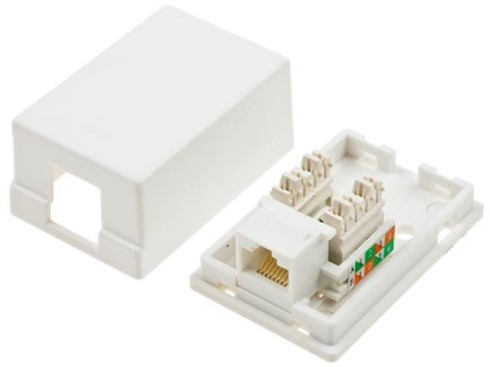

Montaż przewodów w sieciowym gniazdku natynkowym, przedstawionym na rysunku, wykonuje się

Który sterownik odpowiada za bezpośredni dostęp do pamięci?

Urządzenie, które w specyfikacji technicznej posiada zapis: „Urządzenie współpracuje z komputerem klasy PC poprzez złącze USB”, należy podłączyć do złącza oznaczonego piktogramem

Zabieg diametrii krótkofalowej powoduje

Wymieniając bezpiecznik w medycznym module zasilającym, wymagającym zastosowania wkładki topikowej zwłocznej, należy użyć elementu oznaczonego symbolem literowym

Która część narządu wzroku rejestruje światło widzialne?

Zapis w dokumentacji kardiotokografu „prezentacja sygnału FHR” dotyczy

Wybierz narzędzie służące do zamocowania przedstawionej na rysunku końcówki kompresyjnej F na kablu koncentrycznym.

Technologia OLED znajduje zastosowanie w

W programowaniu, aby przerwać wykonywanie pętli i wyjść z niej, należy użyć polecenia

Aby zainstalować brakujące oprogramowanie w systemie z rodziny Linux należy wykorzystać polecenie

Który z przedstawionych przyrządów służy do testowania połączeń w sieci LAN?

Który zabieg wymusza naprzemienną pracę mięśni zginaczy i prostowników poprzez stymulację mięśni impulsem prądowym?

Która magistrala służy do szeregowej transmisji danych?

Zestaw przedstawiony na rysunku przeznaczony jest do przeprowadzania testu aparatu

Urządzenie przedstawione na rysunku jest przeznaczone do

W dokumentacji testera aparatury medycznej podano następujące informacje:

|

Ile elektrod wykorzystuje się podczas wykonywania standardowego badania EKG przy pomocy 12 odprowadzeń?

Które polecenie w systemie Windows tworzy folder Dane?

W programowaniu obiektowym zmienne widoczne w ramach klasy oraz poza nią nazywane są

Jak nazywa się terapia stosowana w przypadku niewydolności nerek, polegająca na oczyszczaniu krwi ze zbędnych składników przemiany materii?

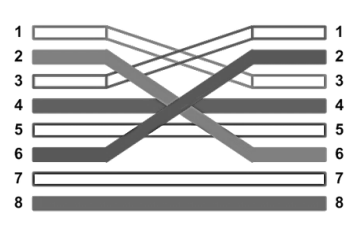

Kabel krosowany jest wykorzystany do połączenia

Aby zapobiec utracie danych w programie obsługi przychodni, należy codziennie wykonywać

Konserwacja oprogramowania nie obejmuje

Wymianą informacji pomiędzy układami znajdującymi się na płycie głównej komputera steruje

Które polecenie SQL pozwoli na utworzenie tabeli pacjentów w bazie przychodnia?

Programowanie obiektowe wykorzystuje dziedziczenie, które polega na

Operacja warunkowa w większości języków programowania wysokiego poziomu zaczyna się słowem

Który system plików pozwala na szyfrowanie danych w systemie Windows?

Parametr CL (czas opóźnienia, jaki upływa między wysłaniem przez kontroler RAM żądania dostępu do kolumny pamięci a otrzymaniem danych z tej kolumny) jest wyrażany w

Narzędzie przedstawione na rysunku służy do

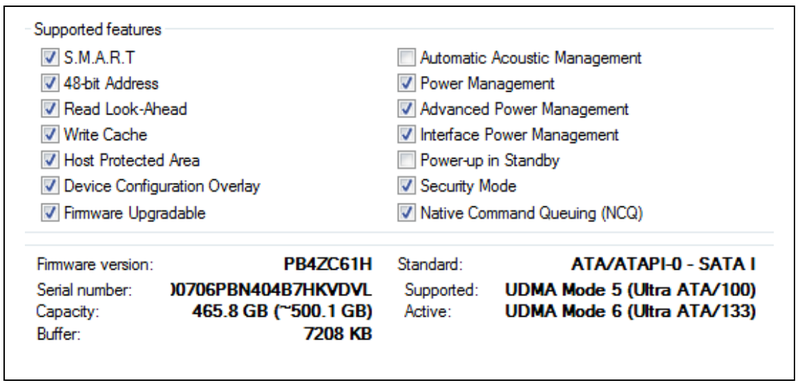

Przedstawiony zrzut ekranu prezentuje parametry