Pytanie 1

Jakie liczby należy wprowadzić na klawiaturze telefonu podłączonego do bramki VoIP po wcześniejszym wpisaniu *** w celu ustawienia adresu bramy domyślnej sieci?

Wynik: 12/40 punktów (30,0%)

Wymagane minimum: 20 punktów (50%)

Jakie liczby należy wprowadzić na klawiaturze telefonu podłączonego do bramki VoIP po wcześniejszym wpisaniu *** w celu ustawienia adresu bramy domyślnej sieci?

Aby chronić sieć Wi-Fi przed nieupoważnionym dostępem, należy m.in.

W systemie Linux polecenie chmod 321 start spowoduje przyznanie poniższych uprawnień plikowi start:

Na ilustracji zaprezentowano końcówkę kabla

Jaką funkcjonalność oferuje program tar?

Który standard IEEE 802.3 powinien być użyty w sytuacji z zakłóceniami elektromagnetycznymi, jeżeli odległość między punktem dystrybucyjnym a punktem abonenckim wynosi 200 m?

Czym jest parametr, który określa, o ile moc sygnału w danej parze przewodów zmniejszy się po przejściu przez cały tor kablowy?

Jaki instrument jest wykorzystywany do sprawdzania zasilaczy komputerowych?

Urządzenie sieciowe działające w trzeciej warstwie modelu ISO/OSI, obsługujące adresy IP, to

W sytuacji, gdy brakuje odpowiedniej ilości pamięci RAM do przeprowadzenia operacji, takiej jak uruchomienie aplikacji, system Windows pozwala na przeniesienie nieużywanych danych z pamięci RAM do pliku

Bęben światłoczuły stanowi istotny komponent w funkcjonowaniu drukarki

Podstawowym zadaniem mechanizmu Plug and Play jest

Czym jest prefetching?

Instalacja systemów Linux oraz Windows 7 przebiegła bez żadnych problemów. Systemy zainstalowały się poprawnie z domyślnymi ustawieniami. Na tym samym komputerze, przy tej samej konfiguracji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

Symbol graficzny przedstawiony na ilustracji oznacza jaką bramkę logiczną?

Wartość wyrażana w decybelach, będąca różnicą pomiędzy mocą sygnału przekazywanego w parze zakłócającej a mocą sygnału generowanego w parze zakłócanej to

Ustawa z dnia 14 grudnia 2012 roku dotycząca odpadów zobowiązuje

Która para: protokół – warstwa, w której funkcjonuje protokół, jest prawidłowo zestawiona według modelu TCP/IP?

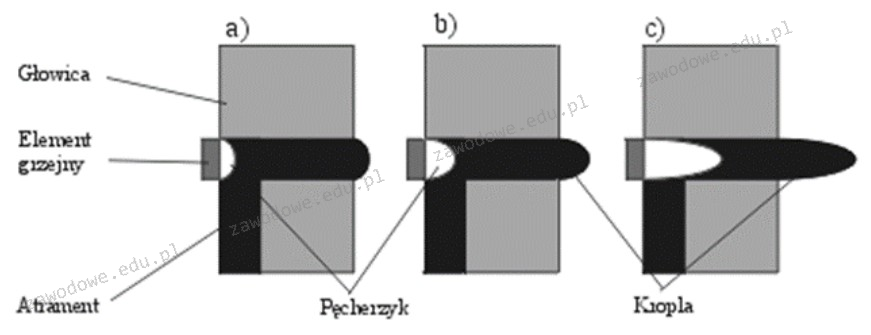

Zgodnie z przedstawionymi zaleceniami dla drukarki atramentowej, kolorowe dokumenty powinny być drukowane przynajmniej

„Czyszczenie głowicy drukarki …. ….. W tym przypadku najskuteczniejszym rozwiązaniem jest wyczyszczenie głowicy drukarki z zaschniętego tuszu. Z reguły wystarcza przetarcie głównego źródła problemu wilgotnym ręcznikiem. Jeżeli to nie pomoże należy zassać tusz do dysz, co pozwoli usunąć z nich powietrze. ….. Kiedy również i to nie pomoże należy przejść do ręcznego czyszczenia głowicy. Drukarka….. powinna być wyłączana na noc, ponieważ po każdym włączeniu przeprowadzane są mini cykle czyszczenia. Warto również pamiętać o wydrukowaniu przynajmniej raz w tygodniu kolorowego dokumentu, dzięki czemu zminimalizujemy prawdopodobieństwo zaschnięcia tuszu." Fragment instrukcji czyszczenia drukarki |

Które środowisko graficzne przeznaczone dla systemu Linux charakteryzuje się najmniejszymi wymaganiami parametrów pamięci RAM?

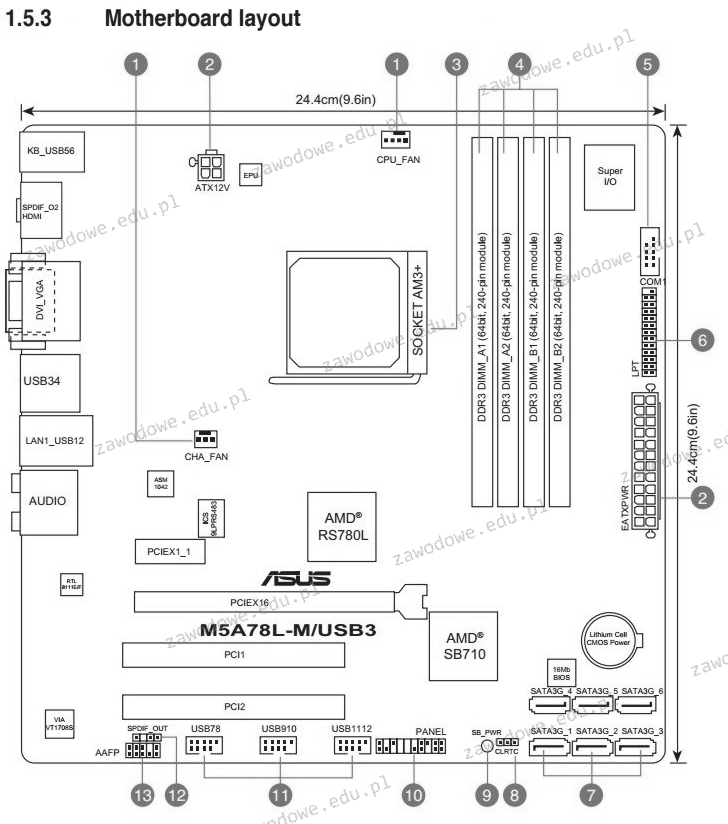

Ile portów USB może być dostępnych w komputerze wyposażonym w tę płytę główną, jeśli nie używa się huba USB ani dodatkowych kart?

Przedstawione narzędzie podczas naprawy zestawu komputerowego przeznaczone jest do

Najwyższy stopień zabezpieczenia sieci bezprzewodowej zapewnia szyfrowanie

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Który z parametrów twardego dysku NIE ma wpływu na jego wydajność?

Funkcja systemu operacyjnego, która umożliwia jednoczesne uruchamianie wielu aplikacji w trybie podziału czasu, z tym że realizacja tego podziału odbywa się przez same aplikacje, nosi nazwę

Jakie polecenie w systemie operacyjnym Linux umożliwia sprawdzenie bieżącej konfiguracji interfejsu sieciowego na komputerze?

Jak nazywa się protokół, który umożliwia pobieranie wiadomości z serwera?

Które z poniższych kont nie jest wbudowane w system Windows XP?

W celu poprawy efektywności procesora Intel można wykorzystać procesor oznaczony literą

Który z wymienionych składników zalicza się do elementów pasywnych sieci?

Jaki system plików powinien być wybrany przy instalacji systemu Linux?

W systemie Windows przy użyciu polecenia assoc można

Jaką liczbę warstw określa model ISO/OSI?

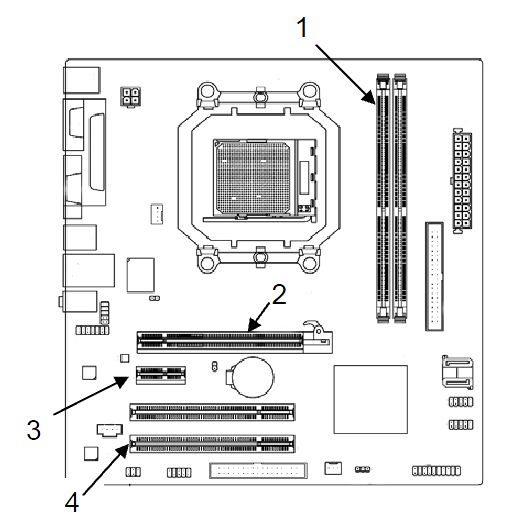

Na schemacie płyty głównej, gdzie można zamontować moduły pamięci RAM, gniazdo oznaczone cyfrą to

Oprogramowanie komputerowe, które można używać bezpłatnie i bez czasowych ograniczeń, jest udostępniane na mocy licencji typu

Jaki procesor powinien być zastosowany podczas składania komputera stacjonarnego opartego na płycie głównej Asus M5A78L-M/USB3 AMD760G socket AM3+?

Jaką długość ma adres IP wersji 4?

Rysunek ilustruje sposób działania drukarki

Jaki interfejs umożliwia transfer danych w formie cyfrowej i analogowej między komputerem a monitorem?