Pytanie 1

Aby uruchomić w systemie linux program nazwa.py, należy wpisać

Wynik: 40/40 punktów (100,0%)

Wymagane minimum: 20 punktów (50%)

Aby uruchomić w systemie linux program nazwa.py, należy wpisać

Który system montażu urządzeń przedstawiono na rysunku?

Znak ~ na początku ciągu znaków w systemach uniksowych oznacza

Jeżeli węzeł zatokowo–przedsionkowy będzie pobudzał serce generując bodźce elektryczne z częstotliwością 1 Hz, to wartość rytmu serca będzie wynosiła

Na zdjęciu RTG najjaśniejsze pole stanowi tkanka kostna, przez którą promieniowanie rentgenowskie jest

Do badania przewodnictwa powietrznego i kostnego służy

Dokręcenie śrub mocujących z wartością momentu 6 Nm, zgodnie z instrukcją montażową, należy wykonać kluczem

Który system plików jest dedykowany systemowi Linux oraz nie jest używany w systemie Windows?

W dokumentacji testera aparatury medycznej podano następujące informacje:

|

Przedstawiony na rysunku kolimator stanowi część

Konserwacja oprogramowania nie obejmuje

Które działanie nie odnosi się do podstawowej funkcji komputera?

Symbole: 1U, 2U, 3U stosowane do oznaczenia modułów w szafach typu rack określają

Fale mózgowe alfa, beta, gamma, delta i theta są rejestrowane w

Który system bazodanowy uniemożliwia bezpłatne zastosowanie komercyjne?

Które ustawienie należy wybrać na multimetrze w celu pomiaru napięcia 12 V w obwodzie prądu stałego?

W celu archiwizacji danych w systemie Windows, jest wymagane kopiowanie z katalogu źródłowego (kat_zrodlowy) do katalogu docelowego (kat_docelowy). Do kopiowania danych należy użyć polecenia

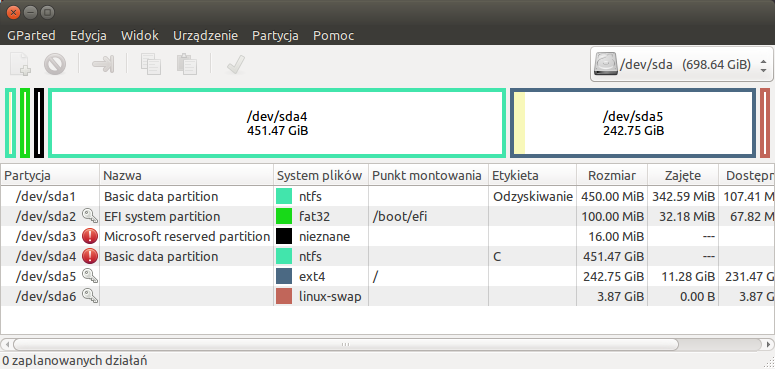

Ile dysków i z jakim interfejsem zostało wykazanych na zrzucie programu GParted?

Zaćma fotochemiczna jest wywołana promieniowaniem

Które polecenie w systemie Windows tworzy folder Dane?

Który rodzaj promieniowania jonizującego jest całkowicie pochłaniany przez naskórek, nie docierając do głębszych warstw tkanek?

Technologia dual channel dotyczy pracy dwóch takich samych

W celu archiwizacji danych w systemie Linux wymagane jest utworzenie archiwum. Korzystając z zamieszczonej w ramce pomocy dobierz odpowiednie polecenie.

| -c, --create | utworzenie nowego archiwum |

| -z, --gzip | filtrowanie archiwum przez gzip |

| -v, --verbose | wypisywanie szczegółów o przetwarzanych plikach |

| -f, --file=ARCHIWUM | użycie pliku lub urządzenia ARCHIWUM |

| -x, --extract | rozpakowanie plików z archiwum |

| -t, --list | wypisanie zawartości archiwum |

| -r, --append | dołączenie plików na końcu archiwum |

| -u, --update | dołączenie tylko plików nowszych niż kopie w archiwum |

Które polecenie SQL służy do utworzenia bazy danych?

Który podzespół komputerowy posiada obudowę o zamieszczonej specyfikacji?

| Specyfikacja obudowy | |

|---|---|

| Obsługiwane gniazda | LGA775 |

| TCASE | 71,4°C |

| Wymiary obudowy | 37,5 mm x 37,5 mm |

| Rozmiar płytki półprzewodnikowej | 214 mm² |

| Liczba tranzystorów płytki półprzewodnikowej | 820 milion |

| Dostępne opcje obniżonej zawartości halogenków | Patrz MDDS |

Ile operacji inkrementacji wykonano w przedstawionej liście kroków?

i=0; Dopóki i>3 wykonaj i=i+1; |

Jaki wpływ na organizm ludzki ma promieniowanie podczerwone IR?

Technika diagnostyki obrazowej polegająca na badaniu struktur serca i dużych naczyń krwionośnych za pomocą ultradźwięków jest określana skrótem

Do badań ultrasonograficznych struktur płytko położonych (np. tarczycy) stosuje się głowicę

Wymianą informacji pomiędzy układami znajdującymi się na płycie głównej komputera steruje

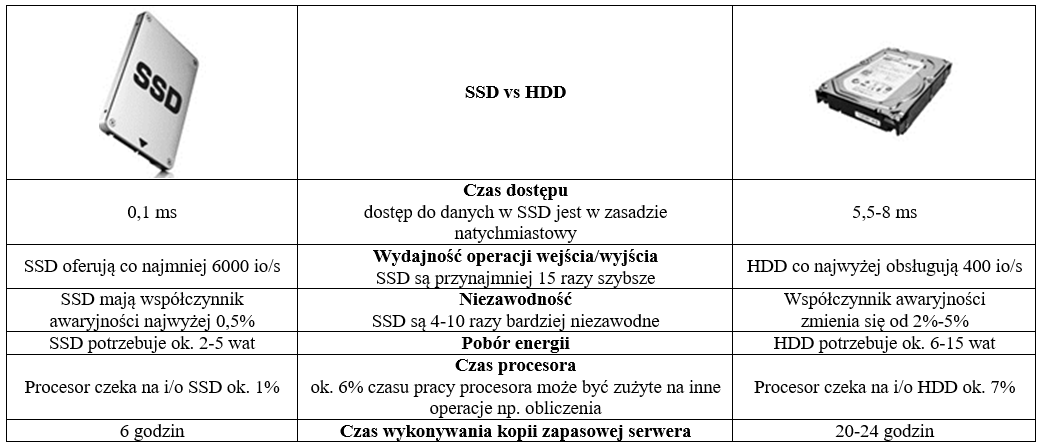

W tabeli zestawiono parametry pamięci półprzewodnikowej i pamięci magnetycznej. Zastosowanie którego rodzaju pamięci umożliwi szybszą pracę komputera?

Która magistrala służy do szeregowej transmisji danych?

Aby system komputerowy współpracujący z ultrasonografem mógł nagrywać na jednej płycie DVD dane z kolejnych, wykonywanych na bieżąco badań, musi być wyposażony w nagrywanie

Katalog /dev w Linuxie zawiera pliki

Czujnik tensometryczny i sonda ultradźwiękowa są elementami aparatu

Jaki format danych należy zastosować do archiwizacji, kompresji i szyfrowania danych?

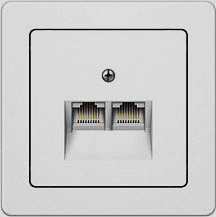

W sieci centralnego monitoringu zamontowane są gniazda przedstawione na rysunku. Jakiego typu wtykami muszą być zakończone kable?

Urządzenie, którego dotyczy fragment podanej specyfikacji, jest przystosowane do

| ■ Architektura sieci LAN: | Wireless IEEE 802.11ac, Wireless IEEE 802.11a, Wireless IEEE 802.11b, Wireless IEEE 802.11g, Wireless IEEE 802.11n |

| ■ Dodatkowe informacje: | PoE, RJ-45 Serial |

| ■ Typ urządzenia: | Bezprzewodowy kontroler |

| ■ Typ złącza anteny zewnętrznej: | 3x3 MIMO |

Zasilacz, który podczas normalnej pracy zasila urządzenie, jednocześnie ładując akumulator, a podczas awarii zasilania sieciowego zasila urządzenie z akumulatora, oznaczany jest skrótem

Pojęcie „Architektura Harvardska” odnosi się do