Pytanie 1

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakie urządzenie służy do połączenia 6 komputerów w ramach sieci lokalnej?

Aby procesor działał poprawnie, konieczne jest podłączenie złącza zasilania 4-stykowego lub 8-stykowego o napięciu

Jakie polecenie w systemie operacyjnym Linux umożliwia sprawdzenie bieżącej konfiguracji interfejsu sieciowego na komputerze?

Gdy komputer się uruchamia, na ekranie wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

Które dwa urządzenia sieciowe CISCO wyposażone w moduły z portami smart serial można połączyć przy użyciu kabla szeregowego?

Technologia, która umożliwia szerokopasmowy dostęp do Internetu z różnymi prędkościami pobierania i wysyłania danych, to

Wydanie komendy chmod 400 nazwa_pliku w systemie Linux spowoduje, że właściciel pliku

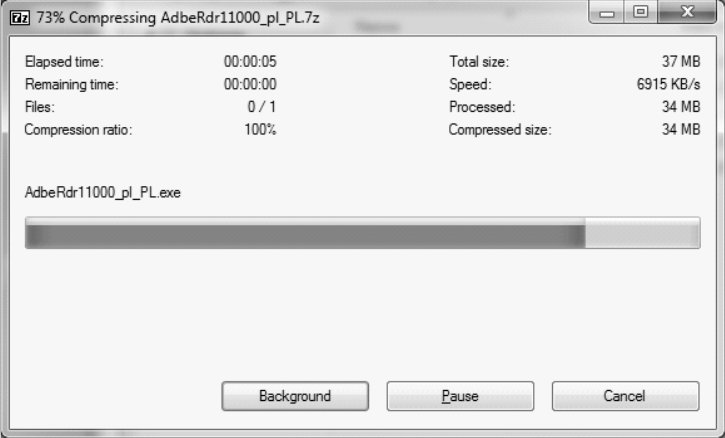

Na dołączonym obrazku ukazano proces

Wykonanie polecenia ipconfig /renew w trakcie ustawiania interfejsów sieciowych doprowadzi do

Jakie urządzenie w warstwie łącza danych modelu OSI analizuje adresy MAC zawarte w ramkach Ethernet i na tej podstawie decyduje o przesyłaniu sygnału między segmentami sieci lub jego blokowaniu?

Jakim materiałem eksploatacyjnym jest ploter solwentowy?

Licencja grupowa na oprogramowanie Microsoft należy do typu

Aby zmienić port drukarki zainstalowanej w systemie Windows, która funkcja powinna zostać użyta?

Które polecenie systemu Linux wyświetla czas pracy systemu oraz jego średnie obciążenie?

Jakie urządzenie sieciowe umożliwia połączenie sieci LAN z WAN?

Do sprawdzenia, czy zainstalowana karta graficzna komputera przegrzewa się, użytkownik może wykorzystać program

Thunderbolt to interfejs

Najlepszą metodą ochrony danych przedsiębiorstwa, którego biura znajdują się w różnych, odległych miejscach, jest wdrożenie

Co oznacza standard 100Base-T?

Zanim przystąpimy do prac serwisowych dotyczących modyfikacji rejestru systemu Windows, konieczne jest wykonanie

Na dołączonym obrazku pokazano działanie

Jakie protokoły są właściwe dla warstwy internetowej w modelu TCP/IP?

Aby zabezpieczyć komputery w lokalnej sieci przed nieautoryzowanym dostępem oraz atakami typu DoS, konieczne jest zainstalowanie i skonfigurowanie

Drukarka fotograficzna ma bardzo brudną obudowę oraz wyświetlacz. Aby usunąć zabrudzenia bez ich uszkodzenia, należy użyć

Aby zainstalować usługę Active Directory w systemie Windows Server, konieczne jest uprzednie zainstalowanie oraz skonfigurowanie serwera

W jakim systemie operacyjnym występuje mikrojądro?

Wykonanie polecenia attrib +h +s +r przykład.txt w terminalu systemu Windows spowoduje

Typowym objawem wskazującym na zbliżającą się awarię dysku twardego jest pojawienie się

W ustawieniach haseł w systemie Windows Server została dezaktywowana możliwość wymogu dotyczącego złożoności hasła. Z jakiej minimalnej liczby znaków powinno składać się hasło użytkownika?

Monitor CRT jest podłączany do karty graficznej przy użyciu złącza

Na nowym urządzeniu komputerowym program antywirusowy powinien zostać zainstalowany

Funkcja systemu operacyjnego, która umożliwia jednoczesne uruchamianie wielu aplikacji w trybie podziału czasu, z tym że realizacja tego podziału odbywa się przez same aplikacje, nosi nazwę

Użytkownik systemu Windows napotyka komunikaty o zbyt małej ilości pamięci wirtualnej. W jaki sposób można rozwiązać ten problem?

Która z ról w systemie Windows Server umożliwia m.in. zdalną, bezpieczną i uproszczoną instalację systemów operacyjnych Windows na komputerach w sieci?

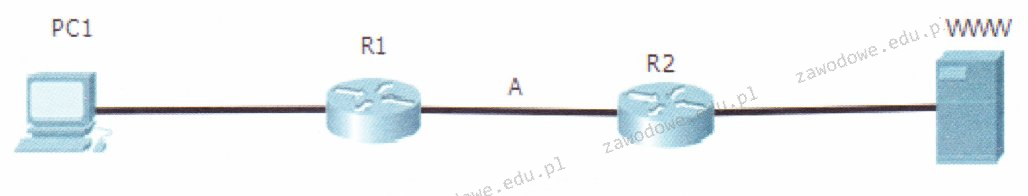

Ramka z informacjami przesyłanymi z komputera PC1 do serwera www znajduje się pomiędzy routerem R1 a routerem R2 w punkcie A). Jakie adresy są w niej zawarte?

Jakie rozszerzenia mają pliki instalacyjne systemu operacyjnego Linux?

Jaki rodzaj dysków jest podłączany do złącza IDE na płycie głównej komputera?

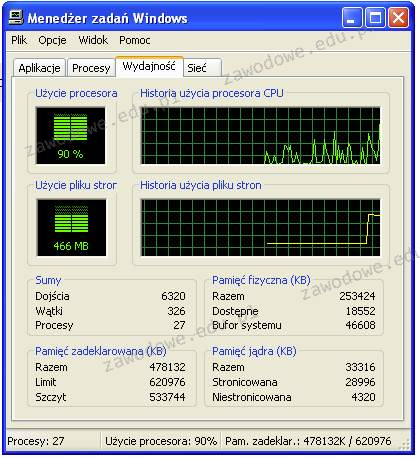

Przyglądając się przedstawionemu obrazkowi, można dostrzec, że deklarowany limit pamięci wynosi 620976 KB. Zauważamy również, że zainstalowana pamięć fizyczna w badanym systemie jest mniejsza niż pamięć zadeklarowana. Który typ pamięci wpływa na podniesienie limitu pamięci zadeklarowanej powyżej rozmiaru zainstalowanej pamięci fizycznej?

Na dysku należy umieścić 100 tysięcy oddzielnych plików, z których każdy ma rozmiar 2570 bajtów. W takim przypadku, zapisane pliki będą zajmować najmniej miejsca na dysku z jednostką alokacji wynoszącą