Pytanie 1

Jaką nazwę powinien mieć identyfikator, aby urządzenia w sieci mogły działać w danej sieci bezprzewodowej?

Wynik: 29/40 punktów (72,5%)

Wymagane minimum: 20 punktów (50%)

Jaką nazwę powinien mieć identyfikator, aby urządzenia w sieci mogły działać w danej sieci bezprzewodowej?

Przedstawione narzędzie jest przeznaczone do

Najskuteczniejszym zabezpieczeniem sieci bezprzewodowej jest

Który kolor żyły nie występuje w kablu typu skrętka?

W serwerach warto korzystać z dysków, które obsługują tryb Hot plugging, ponieważ

Gdy użytkownik wykonuje w wierszu poleceń komendę ping www.onet.pl, otrzymuje komunikat: "Żądanie polecenia ping nie może znaleźć hosta www.onet.pl Sprawdź nazwę i ponów próbę". Z kolei, po wpisaniu w wierszu poleceń komendy ping 213.180.141.140 (adres IP serwera www.onet.pl), użytkownik otrzymuje odpowiedź z serwera. Jakie mogą być przyczyny tej sytuacji?

Który z interfejsów stanowi port równoległy?

Który z portów znajdujących się na tylnej części komputera jest oznaczony podanym symbolem?

W systemie Linux można uzyskać listę wszystkich założonych kont użytkowników, wykorzystując polecenie

Program iftop działający w systemie Linux ma na celu

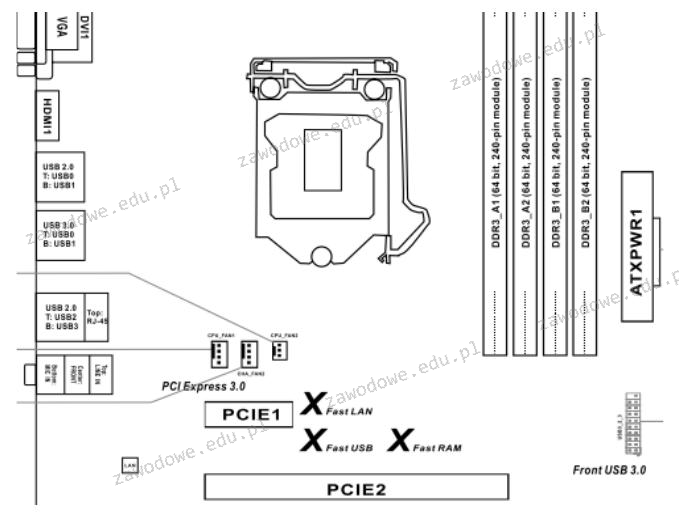

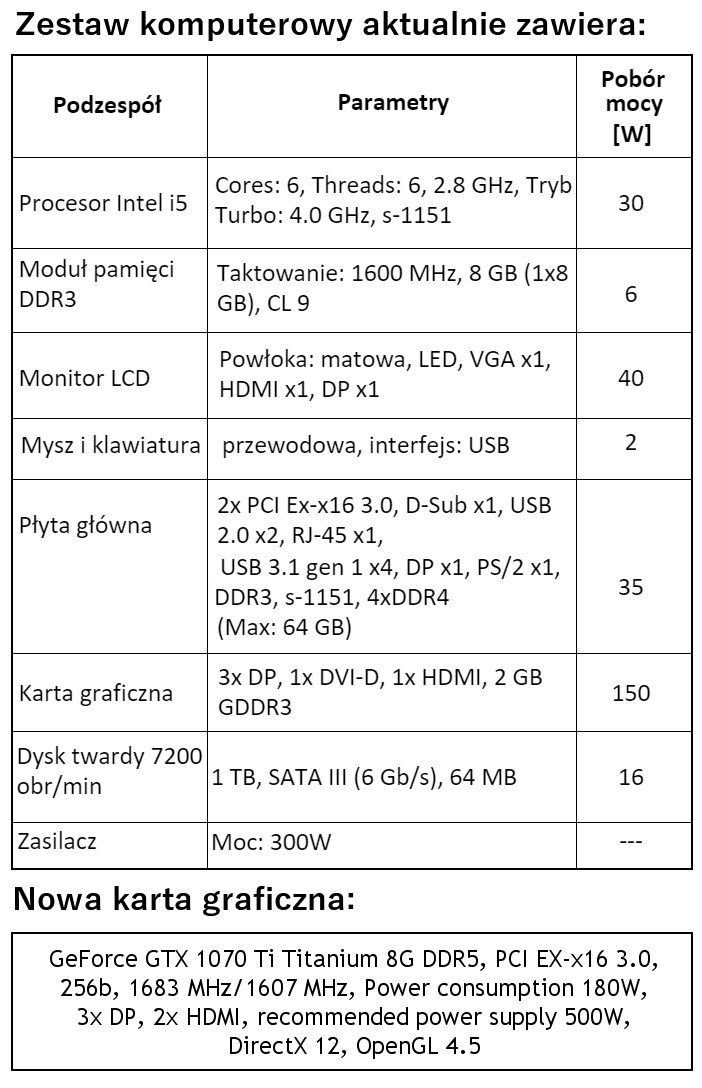

Na wskazanej płycie głównej możliwe jest zainstalowanie procesora w obudowie typu

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue, press Del to setup) naciśnięcie klawisza Del skutkuje

W zestawie komputerowym o parametrach wymienionych w tabeli konieczne jest zastąpienie karty graficznej nową, wskazaną w ramce. W związku z tym modernizacja tego komputera wymaga także wymiany

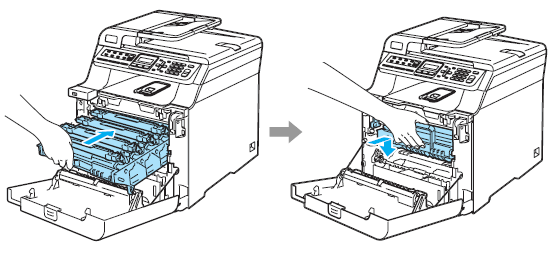

Czynność pokazana na rysunkach ilustruje mocowanie

Protokół User Datagram Protocol (UDP) należy do

Wynikiem przeprowadzenia polecenia arp -a 192.168.1.1 w systemie MS Windows jest pokazanie

Jakie urządzenie jest używane do pomiaru wartości rezystancji?

Aby uniknąć utraty danych w systemie do ewidencji uczniów, po zakończeniu codziennej pracy należy wykonać

Usługi na serwerze są konfigurowane za pomocą

Aby zrealizować transfer danych pomiędzy siecią w pracowni a siecią ogólnoszkolną, która ma inną adresację IP, należy zastosować

Cechą charakterystyczną transmisji w interfejsie równoległym synchronicznym jest to, że

Systemy operacyjne należące do rodziny Linux są dystrybuowane na mocy licencji

W trakcie instalacji oraz konfiguracji serwera DHCP w systemach z rodziny Windows Server istnieje możliwość dodania zastrzeżeń adresów, które określą

Które wbudowane narzędzie systemu Windows pozwala rozwiązywać problemy z błędnymi sektorami i integralnością plików?

Jak nazywa się interfejs wewnętrzny w komputerze?

Jaką liczbę podwójnych gniazd RJ45 należy zainstalować w pomieszczeniu o wymiarach 8 x 5 m, aby spełniać wymagania normy PN-EN 50173?

Aby uniknąć uszkodzenia sprzętu podczas modernizacji komputera przenośnego polegającej na wymianie modułów pamięci RAM należy

Dysk twardy podczas pracy stuka i można zaobserwować bardzo powolne uruchamianie systemu oraz odczytywanie danych. Aby naprawić tę usterkę, po zabezpieczeniu danych na nośniku zewnętrznym należy

Jakie polecenie w systemie operacyjnym Windows służy do wyświetlenia konfiguracji interfejsów sieciowych?

Jaki protokół stworzony przez IBM służy do udostępniania plików w architekturze klient-serwer oraz do współdzielenia zasobów z sieciami Microsoft w systemach operacyjnych LINUX i UNIX?

Po zauważeniu przypadkowego skasowania istotnych danych na dysku, najlepszym sposobem na odzyskanie usuniętych plików jest

Narzędzie System Image Recovery dostępne w zaawansowanych opcjach uruchamiania systemu Windows 7 pozwala na

Jaki typ rozbudowy serwera wymaga zainstalowania dodatkowych sterowników?

Komputer dysponuje adresem IP 192.168.0.1, a jego maska podsieci wynosi 255.255.255.0. Który adres stanowi adres rozgłoszeniowy dla podsieci, do której ten komputer przynależy?

Protokół Transport Layer Security (TLS) jest rozwinięciem standardu

Zainstalowanie gniazda typu keystone w serwerowej szafie jest możliwe w

Jakie złącze powinna mieć karta graficzna, aby mogła być bezpośrednio podłączona do telewizora LCD, który ma tylko analogowe złącze do komputera?

Jakie zastosowanie ma narzędzie tracert w systemach operacyjnych rodziny Windows?

W interfejsie graficznym systemów Ubuntu lub SuSE Linux, aby zainstalować aktualizacje programów systemowych, można zastosować aplikacje

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.