Pytanie 1

Jakie urządzenie w sieci lokalnej nie wydziela segmentów sieci komputerowej na kolizyjne domeny?

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Jakie urządzenie w sieci lokalnej nie wydziela segmentów sieci komputerowej na kolizyjne domeny?

Rzeczywistą kalibrację sprzętową monitora można wykonać

W sieciach bezprzewodowych typu Ad-Hoc IBSS (Independent Basic Service Set) wykorzystywana jest topologia fizyczna

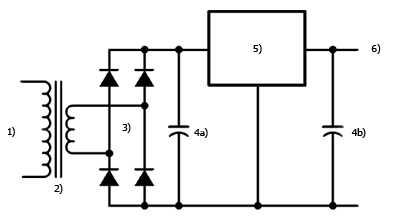

Na schemacie blokowym przedstawiającym zasadę działania zasilacza liniowego numerem 5) oznaczono

Rekord typu A w systemie DNS

Jakie będzie rezultatem dodawania liczb 10011012 i 110012 w systemie binarnym?

Jaką normę wykorzystuje się przy okablowaniu strukturalnym w komputerowych sieciach?

Jak nazywa się złącze wykorzystywane w sieciach komputerowych, pokazane na zamieszczonym obrazie?

Menedżer urządzeń w systemie Windows umożliwia identyfikację

Jakie polecenie w systemie Windows dedykowane dla stacji roboczej, umożliwia skonfigurowanie wymagań dotyczących logowania dla wszystkich użytkowników tej stacji roboczej?

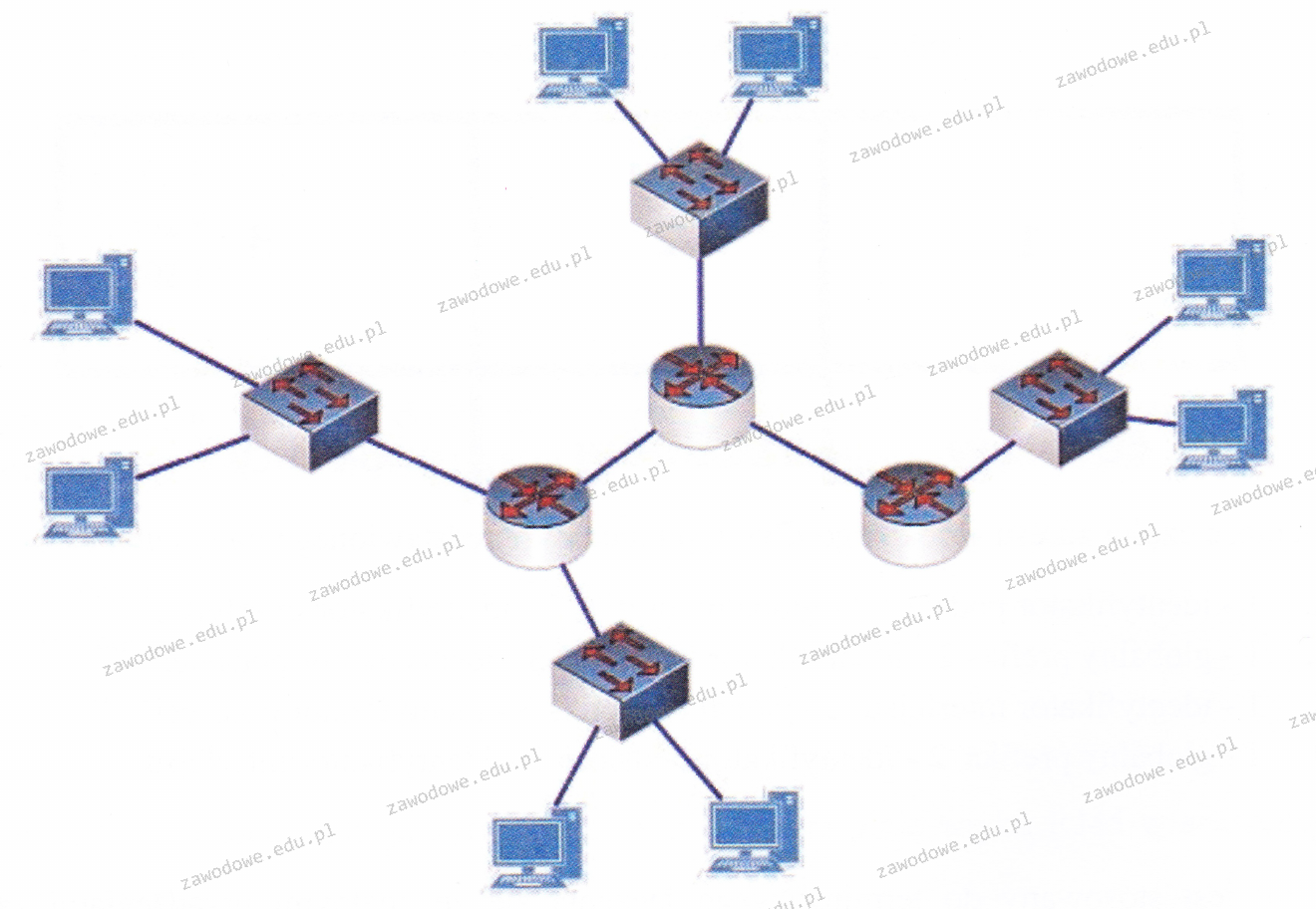

Ile symboli switchy i routerów znajduje się na schemacie?

Aby przywrócić dane z sformatowanego dysku twardego, konieczne jest zastosowanie programu

W jakich jednostkach opisuje się przesłuch zbliżny NEXT?

Która funkcja przełącznika zarządzalnego pozwala na łączenie kilku przełączników fizycznych w jedną wirtualną linię, aby zwiększyć przepustowość łącza?

Aby zorganizować pliki na dysku w celu poprawy wydajności systemu, należy:

Jak określa się w systemie Windows profil użytkownika, który jest tworzony przy pierwszym logowaniu do komputera i zapisywany na lokalnym dysku twardym, a wszelkie jego modyfikacje dotyczą tylko tego konkretnego komputera?

Usterka przedstawiona na ilustracji, widoczna na monitorze komputera, nie może być spowodowana przez

Które środowisko graficzne przeznaczone dla systemu Linux charakteryzuje się najmniejszymi wymaganiami parametrów pamięci RAM?

Ile punktów abonenckich (2 x RJ45) powinno być zainstalowanych w biurze o powierzchni 49 m2, zgodnie z normą PN-EN 50167?

Sprzęt sieciowy umożliwiający połączenie pięciu komputerów w tej samej sieci, minimalizując ryzyko kolizji pakietów, to

Jaki rezultat uzyskamy po wykonaniu odejmowania dwóch liczb heksadecymalnych 60A (h) - 3BF (h)?

Komputer stracił łączność z siecią. Jakie działanie powinno być podjęte w pierwszej kolejności, aby naprawić problem?

Drukarka ma przypisany stały adres IP 172.16.0.101 oraz maskę 255.255.255.0. Jaki adres IP powinien być ustawiony dla komputera, aby nawiązać komunikację z drukarką w lokalnej sieci?

Najwyższą prędkość transmisji danych w sieciach bezprzewodowych zapewnia standard

Narzędziem do monitorowania, które umożliwia przechwytywanie, rejestrowanie oraz dekodowanie różnych pakietów sieciowych, jest

Do usunięcia kurzu z wnętrza obudowy drukarki fotograficznej zaleca się zastosowanie

Router przypisany do interfejsu LAN dysponuje adresem IP 192.168.50.1. Został on skonfigurowany w taki sposób, aby przydzielać komputerom wszystkie dostępne adresy IP w sieci 192.168.50.0 z maską 255.255.255.0. Jaką maksymalną liczbę komputerów można podłączyć w tej sieci?

Użycie którego z urządzeń może prowadzić do wzrostu liczby kolizji pakietów w sieci?

Proporcja ładunku zgromadzonego na przewodniku do potencjału tego przewodnika definiuje jego

Który z komponentów komputera, gdy zasilanie jest wyłączone, zachowuje program inicjujący uruchamianie systemu operacyjnego?

Aby uzyskać informacje na temat aktualnie działających procesów w systemie Linux, można użyć polecenia

Na ilustracji ukazano narzędzie systemu Windows 7 służące do

Zgodnie z aktualnymi przepisami BHP, odległość oczu od ekranu monitora powinna wynosić

Jaki protokół umożliwia nawiązywanie szyfrowanych połączeń terminalowych z zdalnym komputerem?

Który z wymienionych składników stanowi element pasywny w sieci?

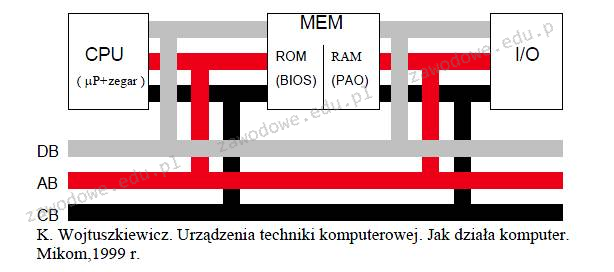

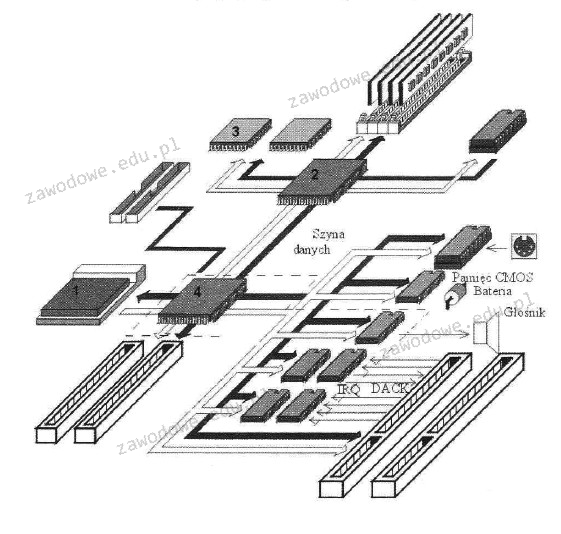

Jaką liczbą oznaczono procesor na diagramie płyty głównej komputera?

Dwie stacje robocze w tej samej sieci nie mają możliwości komunikacji. Która z poniższych okoliczności może być przyczyną tego problemu?

Który z elementów szafy krosowniczej został pokazany na ilustracji?

Ilustracja pokazuje rezultat testu sieci komputerowej za pomocą komendy

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z