Pytanie 1

Do zarządzania przydziałami przestrzeni dyskowej w systemach Windows 7 oraz Windows 8 wykorzystywane jest narzędzie

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Do zarządzania przydziałami przestrzeni dyskowej w systemach Windows 7 oraz Windows 8 wykorzystywane jest narzędzie

Jakie korzyści płyną z zastosowania systemu plików NTFS?

Grupa protokołów, która charakteryzuje się wspólną metodą szyfrowania, to

Na stabilność obrazu w monitorach CRT istotny wpływ ma

Aby w systemie Windows nadać użytkownikowi możliwość zmiany czasu systemowego, potrzebna jest przystawka

Chusteczki namoczone w płynie o działaniu antystatycznym są używane do czyszczenia

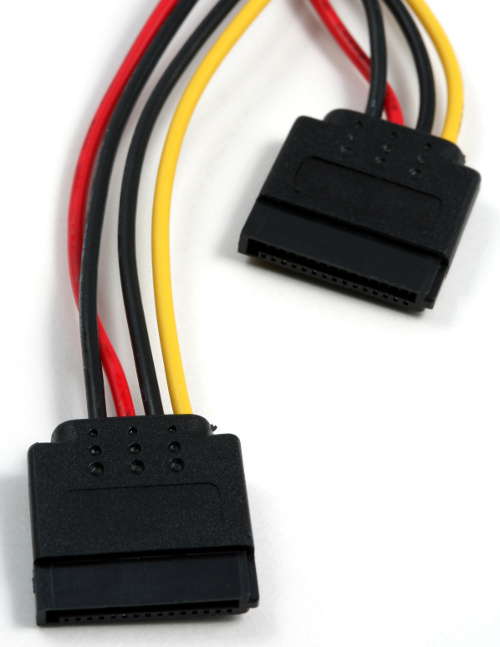

Na przedstawionym zdjęciu złącza pozwalają na

Która z opcji konfiguracji ustawień konta użytkownika o ograniczonych uprawnieniach w systemie Windows jest dostępna dzięki narzędziu secpol?

Wartość sumy liczb binarnych 1010 i 111 zapisana w systemie dziesiętnym to

Aby chronić konto użytkownika przed nieautoryzowanymi zmianami w systemie Windows 7, 8 lub 10, które wymagają uprawnień administratora, należy ustawić

Który z protokołów jest używany w komunikacji głosowej przez internet?

Jakie są zakresy częstotliwości oraz maksymalne prędkości przesyłu danych w standardzie 802.11g WiFi?

Na ilustracji zobrazowano

Jaki adres IPv4 wykorzystuje się do testowania protokołów TCP/IP na jednym hoście?

Który z protokołów powinien być zastosowany do pobierania wiadomości e-mail z własnego serwera?

Jakie zastosowanie ma narzędzie tracert w systemach operacyjnych rodziny Windows?

Administrator powinien podzielić sieć o adresie 193.115.95.0 z maską 255.255.255.0 na 8 równych podsieci. Jaką maskę sieci powinien wybrać administrator?

Profil mobilny staje się profilem obowiązkowym użytkownika po

Na dysku obok systemu Windows zainstalowano system Linux Ubuntu. W celu ustawienia kolejności uruchamiania systemów operacyjnych, konieczna jest modyfikacja zawartości

Jakie urządzenie elektroniczne ma zdolność do magazynowania ładunku elektrycznego?

Jakie typy połączeń z Internetem mogą być współdzielone w sieci lokalnej?

Zgodnie z wytycznymi dotyczącymi karty graficznej, jej możliwości pracy z systemem AGP 2X/4X pozwalają na

Jakie właściwości posiada topologia fizyczna sieci opisana w ramce?

Na ilustracji ukazano port w komputerze, który służy do podłączenia

Długi oraz dwa krótkie dźwięki sygnałowe BIOS POST od AMI i AWARD sygnalizują problem

Po przeanalizowaniu wyników testu dysku twardego, jakie czynności powinny zostać wykonane, aby zwiększyć jego wydajność?

| Wolumin (C:) | ||

| Rozmiar woluminu | = | 39,06 GB |

| Rozmiar klastra | = | 4 KB |

| Zajęte miejsce | = | 27,48 GB |

| Wolne miejsce | = | 11,58 GB |

| Procent wolnego miejsca | = | 29 % |

| Fragmentacja woluminu | ||

| Fragmentacja całkowita | = | 15 % |

| Fragmentacja plików | = | 31 % |

| Fragmentacja wolnego miejsca | = | 0 % |

Adres IP urządzenia umożliwiającego innym komputerom w sieci lokalnej dostęp do Internetu, to adres

Koprocesor (Floating Point Unit) w systemie komputerowym jest odpowiedzialny za realizację

Informacje ogólne na temat zdarzeń systemowych w systemie Linux są zapisywane w

Aby oddzielić komputery działające w sieci z tym samym adresem IPv4, które są podłączone do zarządzalnego przełącznika, należy przypisać

Ile maksymalnie dysków twardych można bezpośrednio podłączyć do płyty głównej, której fragment specyfikacji jest przedstawiony w ramce?

|

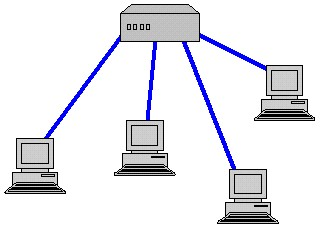

Jaką topologię fizyczną sieci ukazuje przedstawiony rysunek?

Który zakres adresów IPv4 jest poprawnie przypisany do danej klasy?

| Zakres adresów IPv4 | Klasa adresu IPv4 | |

|---|---|---|

| A. | 1.0.0.0 ÷ 127.255.255.255 | A |

| B. | 128.0.0.0 ÷ 191.255.255.255 | B |

| C. | 192.0.0.0 ÷ 232.255.255.255 | C |

| D. | 233.0.0.0 ÷ 239.255.255.255 | D |

Jakie zagrożenia eliminują programy antyspyware?

Interfejs UDMA to interfejs

ACPI jest skrótem oznaczającym

Dysk twardy podczas pracy stuka i można zaobserwować bardzo powolne uruchamianie systemu oraz odczytywanie danych. Aby naprawić tę usterkę, po zabezpieczeniu danych na nośniku zewnętrznym należy

W których nośnikach pamięci masowej jedną z najczęstszych przyczyn uszkodzeń jest uszkodzenie powierzchni?

Przedstawione na ilustracji narzędzie służy do

Wskaż zewnętrzny protokół rutingu?