Pytanie 1

Jak nazywa się topologia fizyczna, w której każdy węzeł łączy się bezpośrednio ze wszystkimi innymi węzłami?

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Jak nazywa się topologia fizyczna, w której każdy węzeł łączy się bezpośrednio ze wszystkimi innymi węzłami?

Do konserwacji elementów łożyskowanych oraz ślizgowych w urządzeniach peryferyjnych stosuje się

W systemie Linux polecenie touch ma na celu

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Kiedy wygasa autorskie prawo majątkowe dotyczące programu komputerowego, stworzonego przez kilku programistów, którzy jako jego autorzy podpisali aplikację swoimi imionami i nazwiskami?

Trudności w systemie operacyjnym Windows wynikające z konfliktów dotyczących zasobów sprzętowych, takich jak przydział pamięci, przerwań IRQ oraz kanałów DMA, najłatwiej zidentyfikować za pomocą narzędzia

Jak nazywa się licencja oprogramowania, która pozwala na bezpłatne rozpowszechnianie aplikacji?

Protokół poczty elektronicznej, który umożliwia zarządzanie wieloma skrzynkami pocztowymi oraz pobieranie i manipulowanie na wiadomościach przechowywanych na zdalnym serwerze, to

Urządzeniem stworzonym do generowania etykiet oraz kodów kreskowych, które działa dzięki roztopieniu pokrywy specjalnej taśmy, co powoduje, że barwnik z taśmy przylega do materiału, na którym odbywa się drukowanie jest drukarka

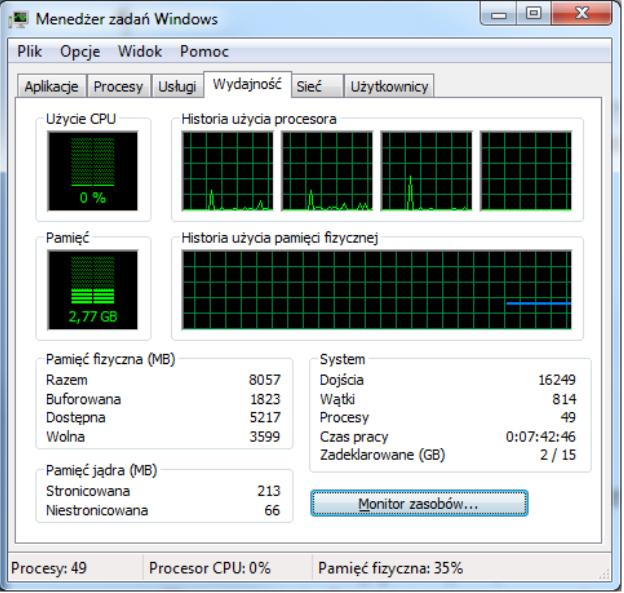

Aby zidentyfikować, który program najbardziej obciąża CPU w systemie Windows, należy otworzyć program

Jaki typ rozbudowy serwera wymaga zainstalowania dodatkowych sterowników?

Czym jest kopia różnicowa?

Aby uruchomić przedstawione narzędzie w systemie Windows, jakie polecenie należy zastosować?

Aby zablokować oraz usunąć złośliwe oprogramowanie, takie jak exploity, robaki i trojany, konieczne jest zainstalowanie oprogramowania

Jakie narzędzie jest używane do diagnozowania łączności między hostami w systemie Windows?

Thunderbolt to interfejs

Który z protokołów w systemach operacyjnych Linux jest używany w sieciach lokalnych?

Aby stworzyć kontroler domeny w środowisku systemów Windows Server na lokalnym serwerze, konieczne jest zainstalowanie roli

Przy pomocy testów statycznych okablowania można zidentyfikować

Który z protokołów nie działa w warstwie aplikacji modelu ISO/OSI?

Wskaż koszt brutto wykonanych przez serwisanta usług, jeśli do rachunku doliczony jest również koszt dojazdu w wysokości 55,00 zł netto.

| LP | Wykonana usługa | Cena usługi netto w zł | Stawka podatku VAT |

|---|---|---|---|

| 1. | Instalacja/ konfiguracja programu | 10,00 | 23% |

| 2. | Wymiana zasilacza | 40,00 | |

| 3. | Tworzenie kopii zapasowej i archiwizacja danych | 40,00 | |

| 4. | Konfiguracja przełącznika | 25,00 | |

| 5. | Instalacja i konfiguracja skanera | 45,00 |

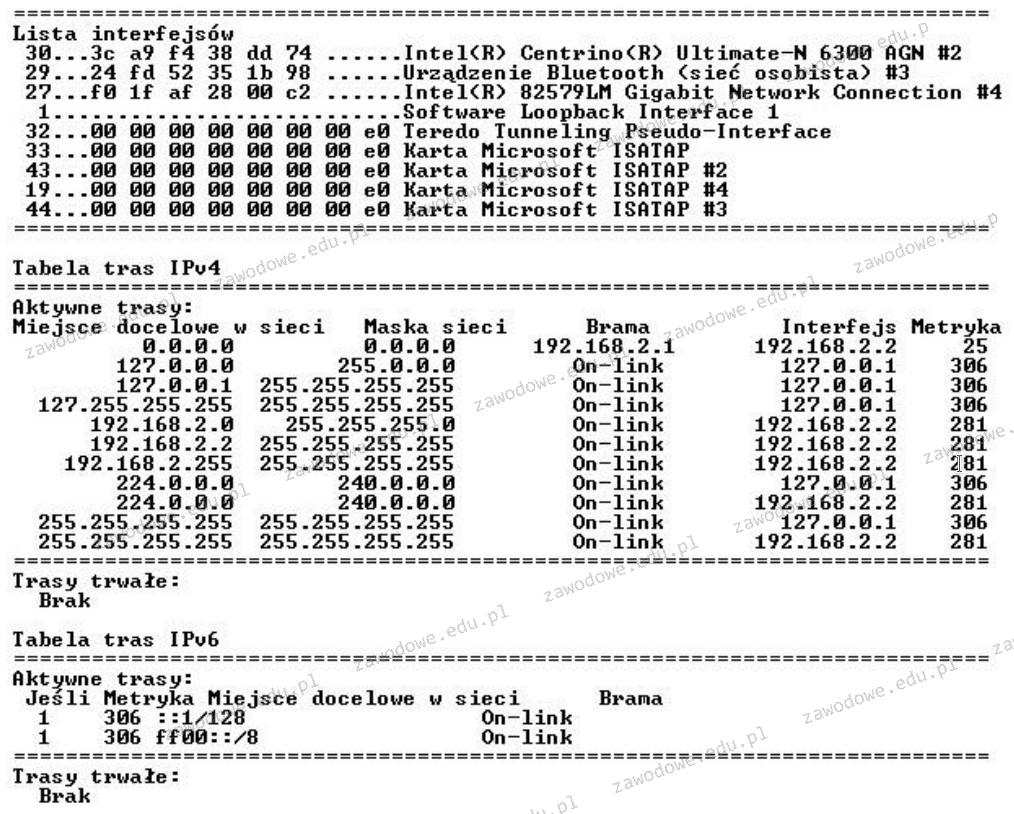

Jaki jest rezultat realizacji którego polecenia w systemie operacyjnym z rodziny Windows, przedstawiony na poniższym rysunku?

Jakie będą całkowite wydatki na materiały potrzebne do wyprodukowania 20 kabli połączeniowych typu patchcord o długości 1,5 m każdy, jeżeli koszt jednego metra kabla wynosi 1 zł, a wtyk to 50 gr?

Komenda msconfig uruchamia w systemie Windows:

Jakie urządzenia wyznaczają granice domeny rozgłoszeniowej?

Jaka liczba hostów może być podłączona w sieci o adresie 192.168.1.128/29?

Który z protokołów umożliwia szyfrowane połączenia?

Według normy PN-EN 50174 maksymalny rozplot kabla UTP powinien wynosić nie więcej niż

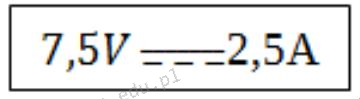

Na urządzeniu zasilanym prądem stałym znajduje się wskazane oznaczenie. Co można z niego wywnioskować o pobieranej mocy urządzenia, która wynosi około

Proporcja ładunku zgromadzonego na przewodniku do potencjału tego przewodnika definiuje jego

Termin "10 W" w dokumentacji technicznej dotyczącej głośnika komputerowego wskazuje na jego

Jak nazywa się translacja adresów źródłowych w systemie NAT routera, która zapewnia komputerom w sieci lokalnej dostęp do internetu?

Do właściwego funkcjonowania procesora konieczne jest podłączenie złącza zasilania 4-stykowego lub 8-stykowego o napięciu

Wskaż rodzaj wtyczki zasilającej, którą należy połączyć z napędem optycznym podczas montażu komputera.

Jaki jest standardowy port dla serwera HTTP?

Aby komputery mogły udostępniać swoje zasoby w sieci, muszą mieć przypisane różne

W systemie Windows Server narzędzie, które pozwala na zarządzanie zasadami grupowymi, to

Do utworzenia skompresowanego archiwum danych w systemie Linux można użyć polecenia

Zestaw komputerowy, który został przedstawiony, jest niepełny. Który z elementów nie został wymieniony w tabeli, a jest kluczowy dla prawidłowego funkcjonowania zestawu?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Zalman Obudowa R1 Midi Tower bez PSU, USB 3.0 |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, BOX |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Którego polecenia należy użyć, aby w ruterze skonfigurować trasę statyczną dla adresu następnego skoku 192.168.1.1?