Pytanie 1

Który z poniższych adresów należy do klasy B?

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Który z poniższych adresów należy do klasy B?

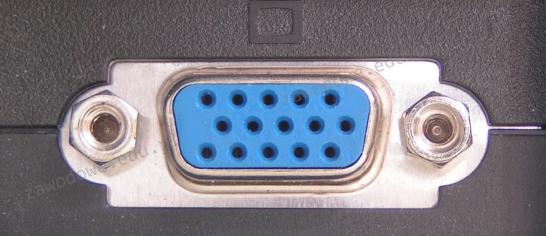

Na ilustracji widoczny jest

Przedstawione na ilustracji narzędzie służy do

Aby przekształcić zeskanowany obraz na tekst, należy użyć oprogramowania, które stosuje techniki

Jaki będzie rezultat odejmowania dwóch liczb zapisanych w systemie heksadecymalnym 60Ah - 3BFh?

Industry Standard Architecture to norma magistrali, według której szerokość szyny danych wynosi

Interfejs HDMI w komputerze umożliwia przesyłanie sygnału

Osobom pracującym zdalnie, dostęp do serwera znajdującego się w prywatnej sieci za pośrednictwem publicznej infrastruktury, jaką jest Internet, umożliwia

Jednym z metod ograniczenia dostępu do sieci bezprzewodowej dla osób nieuprawnionych jest

Jakie urządzenie powinno się zastosować do pomiaru topologii okablowania strukturalnego w sieci lokalnej?

Wskaż symbol, który znajduje się na urządzeniach elektrycznych przeznaczonych do handlu w Unii Europejskiej?

Wskaż komponent, który nie jest zgodny z płytą główną o parametrach przedstawionych w tabeli

| Podzespół | Parametry |

|---|---|

| Płyta główna GIGABYTE | 4x DDR4, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8 x USB 2.0, S-AM3+ |

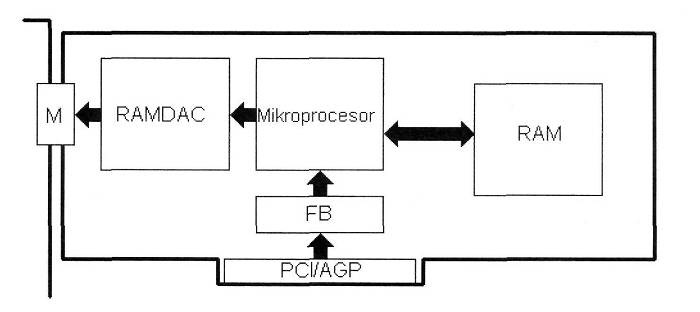

Na schemacie blokowym funkcjonalny blok RAMDAC ilustruje

Jakie urządzenie sieciowe umożliwia połączenie lokalnej sieci LAN z rozległą siecią WAN?

Urządzenie peryferyjne, które jest kontrolowane przez komputer i wykorzystywane do obsługi dużych, płaskich powierzchni, a do produkcji druków odpornych na czynniki zewnętrzne używa farb rozpuszczalnikowych, to ploter

Użytkownik napotyka trudności z uruchomieniem systemu Windows. W celu rozwiązania tego problemu skorzystał z narzędzia System Image Recovery, które

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Funkcja failover usługi DHCP umożliwia

Który z podanych adresów IPv4 stanowi adres publiczny?

Jak powinno być usytuowanie gniazd komputerowych RJ45 względem powierzchni biurowej zgodnie z normą PN-EN 50174?

Układy sekwencyjne stworzone z grupy przerzutników, najczęściej synchronicznych typu D, które mają na celu przechowywanie danych, to

Jaką maskę trzeba zastosować, aby podzielić sieć z adresem 192.168.1.0 na 4 podsieci?

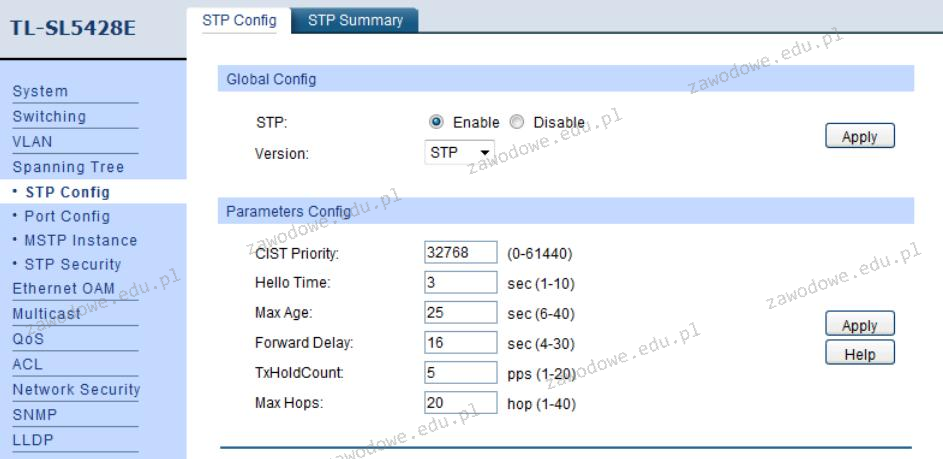

Na podstawie zrzutu ekranu ilustrującego ustawienia przełącznika można wnioskować, że

Czym wyróżniają się procesory CISC?

Co nie ma wpływu na utratę danych z dysku HDD?

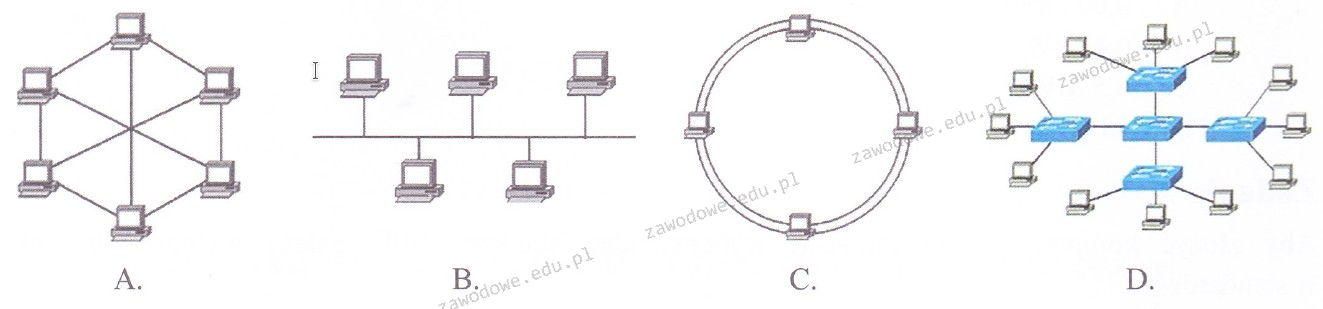

Na którym z przedstawionych rysunków ukazano topologię sieci typu magistrala?

Na ilustracji pokazano tylną część panelu

Które z poleceń systemu Linux nie umożliwia przeprowadzenia diagnostyki sprzętu komputerowego?

W systemie Linux narzędzie fsck umożliwia

Jaki system operacyjny funkcjonuje w trybie tekstowym i umożliwia uruchomienie środowiska graficznego KDE?

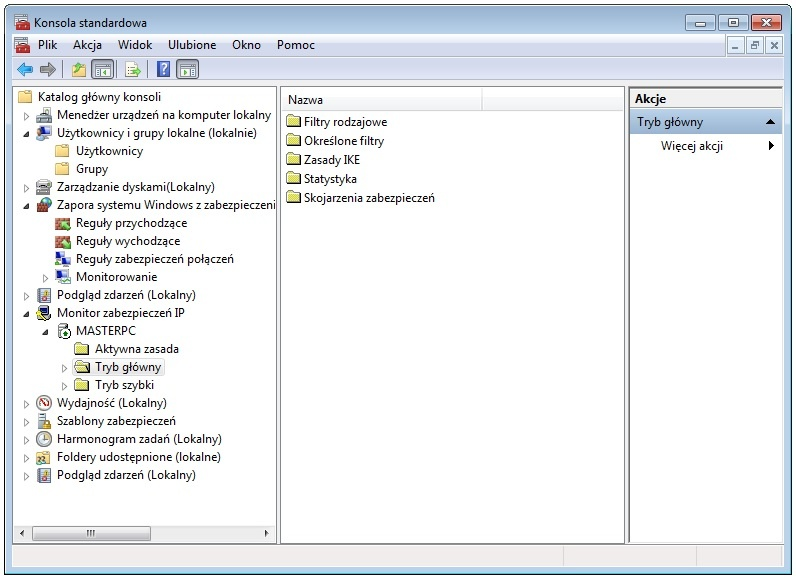

Okno narzędzia przedstawionego na ilustracji można uzyskać poprzez wykonanie polecenia

Która z poniższych opcji nie jest usługą katalogową?

W systemie Windows, aby uruchomić usługę związaną z wydajnością komputera, należy użyć polecenia

Złącze widoczne na ilustracji służy do podłączenia

Do czego służy nóż uderzeniowy?

Administrator systemu Linux wydał polecenie mount /dev/sda2 /mnt/flash . Spowoduje ono

Czym jest odwrotność bezstratnego algorytmu kompresji danych?

Jakim symbolem jest oznaczona skrętka bez ekranowania?

Który standard implementacji sieci Ethernet określa sieć wykorzystującą kabel koncentryczny, z maksymalną długością segmentu wynoszącą 185 m?

Zgodnie z wytycznymi dotyczącymi karty graficznej, jej możliwości pracy z systemem AGP 2X/4X pozwalają na