Pytanie 1

Jakie są prędkości przesyłu danych w sieciach FDDI (ang. Fiber Distributed Data Interface) wykorzystujących technologię światłowodową?

Wynik: 9/40 punktów (22,5%)

Wymagane minimum: 20 punktów (50%)

Jakie są prędkości przesyłu danych w sieciach FDDI (ang. Fiber Distributed Data Interface) wykorzystujących technologię światłowodową?

W przypadku awarii którego urządzenia w sieci lokalnej, cała sieć przestaje działać w topologii magistrali?

Jakie urządzenie należy zastosować do pomiaru mocy zużywanej przez komputer?

Komputer lokalny dysponuje adresem 192.168.0.5. Po otwarciu strony internetowej z tego komputera, która rozpoznaje adresy w sieci, uzyskano informację, że adres komputera to 195.182.130.24. To oznacza, że

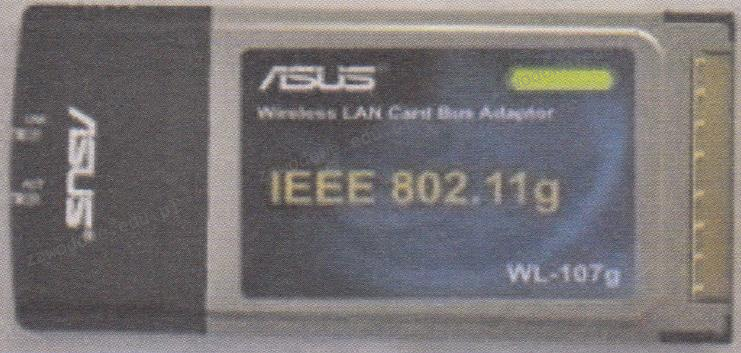

Karta sieciowa przedstawiona na ilustracji ma zdolność przesyłania danych z maksymalną prędkością

Za przypisanie czasu procesora do wyznaczonych zadań odpowiada

Plik ma rozmiar 2 KiB. Jest to

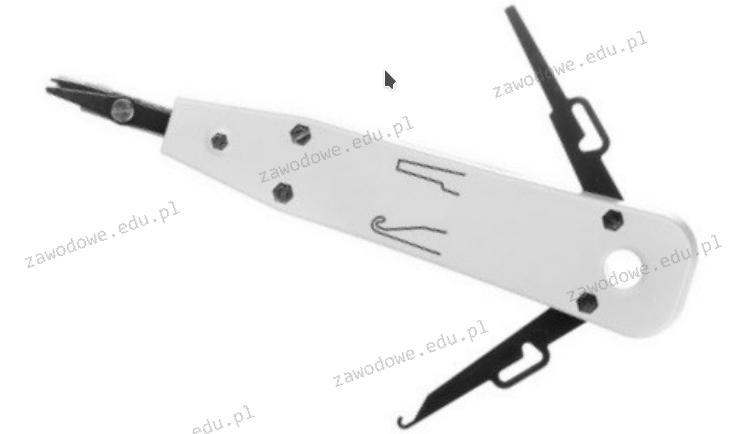

To narzędzie może być wykorzystane do

Członkostwo komputera w danej sieci wirtualnej nie może być ustalane na podstawie

W sieciach komputerowych, gniazdo, które jednoznacznie wskazuje na dany proces na urządzeniu, stanowi połączenie

Licencja obejmująca oprogramowanie układowe, umieszczone na stałe w sprzętowej części systemu komputerowego, to

Drukarka fotograficzna ma bardzo brudną obudowę oraz wyświetlacz. Aby usunąć zabrudzenia bez ich uszkodzenia, należy użyć

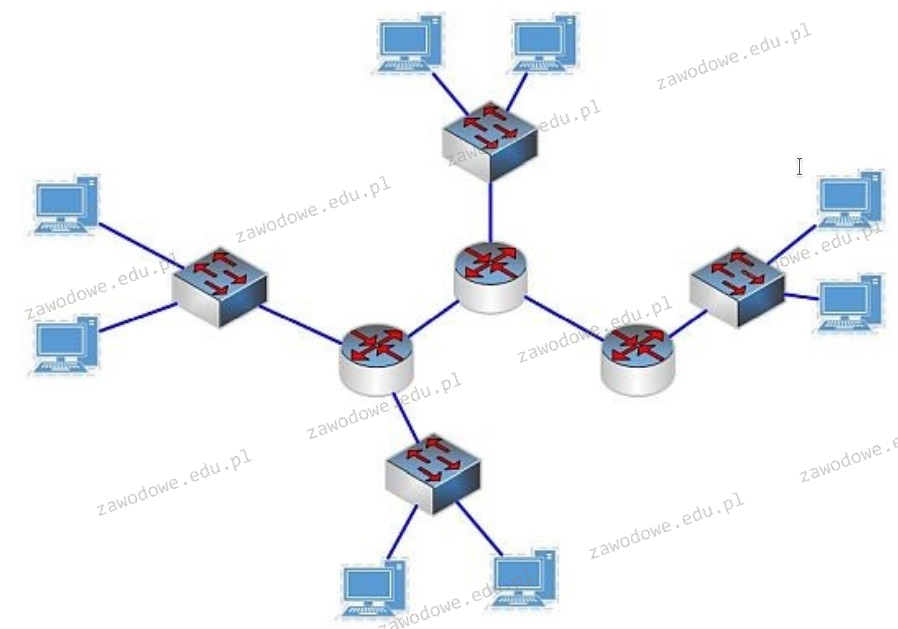

Urządzenie pokazane na ilustracji służy do

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Złącze SC powinno być zainstalowane na kablu

Wskaż poprawną kolejność czynności prowadzących do zamontowania procesora w gnieździe LGA na nowej płycie głównej, odłączonej od źródła zasilania.

| Nr czynności | Działanie |

|---|---|

| 1 | Odgięcie dźwigni i otwarcie klapki |

| 2 | Montaż układu chłodzącego |

| 3 | Zamknięcie klapki i dociśnięcie dźwigni |

| 4 | Podłączenie układu chłodzącego do zasilania |

| 5 | Lokalizacja gniazda procesora |

| 6 | Nałożenie pasty termoprzewodzącej |

| 7 | Włożenie procesora do gniazda |

Co nie wpływa na utratę z pamięci masowej HDD?

Płyta główna serwerowa potrzebuje pamięci z rejestrem do prawidłowego funkcjonowania. Który z poniższych modułów pamięci będzie zgodny z tą płytą?

W czterech różnych sklepach ten sam model komputera oferowany jest w różnych cenach. Gdzie można go kupić najtaniej?

W przedsiębiorstwie trzeba było zreperować 5 komputerów i serwer. Czas potrzebny na naprawę każdego z komputerów wyniósł 1,5 godziny, a serwera 2,5 godziny. Stawka za usługę to 100,00 zł za roboczogodzinę, a do tego doliczany jest podatek VAT w wysokości 23%. Jaka kwota brutto będzie należna za tę usługę?

Kluczowe znaczenie przy tworzeniu stacji roboczej dla wielu wirtualnych maszyn ma

Adres IP przydzielony komputerowi pozwala odbiorcy pakietu IP na odróżnienie identyfikatorów

Firma świadcząca usługi sprzątania potrzebuje drukować faktury tekstowe w czterech kopiach równocześnie, na papierze samokopiującym. Jaką drukarkę powinna wybrać?

Określ najprawdopodobniejszą przyczynę pojawienia się komunikatu: CMOS checksum error press F1 to continue press DEL to setup podczas uruchamiania systemu

Transmisję danych bezprzewodowo realizuje interfejs

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się działania usuwania starych plików oraz dodawania nowych plików, doświadcza

Na schemacie przedstawiono podstawowe informacje dotyczące ustawień karty sieciowej. Do jakiej klasy należy adres IP przypisany do tej karty?

Adres IPv4 . . . . . . . . . . . : 192.168.56.1 Maska podsieci . . . . . . . . . : 255.255.255.0 Brama domyślna . . . . . . . . . :

Magistrala PCI-Express do przesyłania danych stosuje metodę komunikacyjną

Wskaż interfejsy płyty głównej widoczne na rysunku.

Z wykorzystaniem polecenia dxdiag uruchomionego z linii komend systemu Windows można

Menedżer urządzeń w systemie Windows umożliwia identyfikację

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue press DEL to setup. Naciśnięcie klawisza DEL spowoduje

Który z elementów szafy krosowniczej został pokazany na ilustracji?

Jak należy rozmieszczać gniazda komputerowe RJ45 w odniesieniu do przestrzeni biurowej zgodnie z normą PN-EN 50174?

Transmisję danych w sposób bezprzewodowy umożliwia standard, który zawiera interfejs

Jakie złącze, które pozwala na podłączenie monitora, znajduje się na karcie graficznej pokazanej na ilustracji?

Na diagramie przedstawione są symbole

Który z portów znajdujących się na tylnej części komputera jest oznaczony podanym symbolem?

Po stwierdzeniu przypadkowego usunięcia ważnych danych na dysku twardym, aby odzyskać usunięte pliki, najlepiej

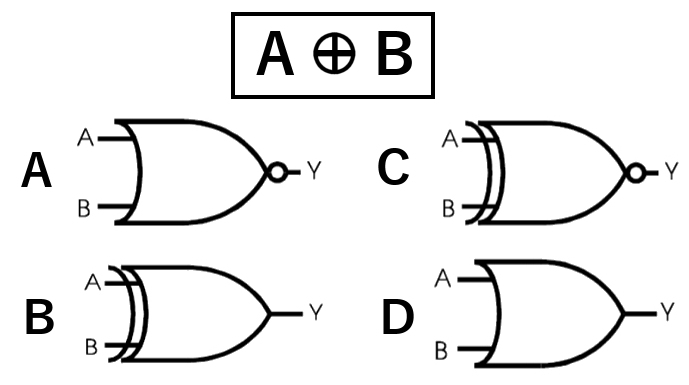

Jaką bramkę logiczną reprezentuje to wyrażenie?