Pytanie 1

Jaka usługa sieciowa domyślnie wykorzystuje port 53?

Wynik: 16/40 punktów (40,0%)

Wymagane minimum: 20 punktów (50%)

Jaka usługa sieciowa domyślnie wykorzystuje port 53?

Czym dokonuje się przekształcenia kodu źródłowego w program do wykonania?

Wskaż program w systemie Linux, który jest przeznaczony do kompresji plików?

Jaką wartość w systemie dziesiętnym ma suma liczb szesnastkowych: 4C + C4?

Aby zapewnić możliwość odzyskania ważnych danych, należy regularnie

Który z wymienionych składników stanowi element pasywny w sieci?

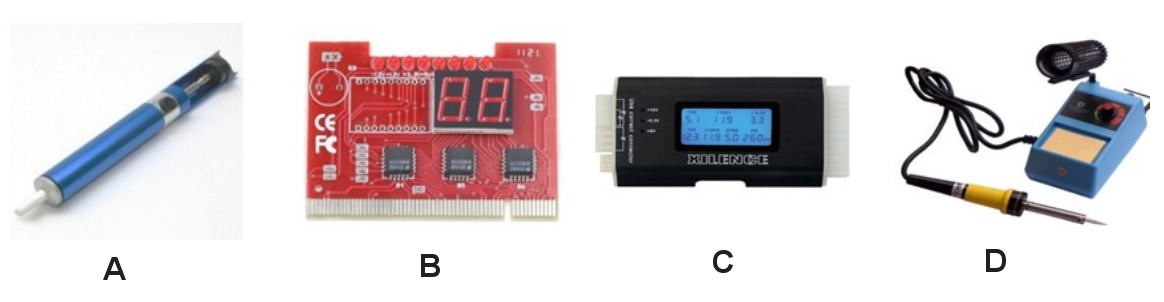

Jakie narzędzie powinno być użyte do uzyskania rezultatów testu POST dla komponentów płyty głównej?

Oprogramowanie, które pozwala na interakcję pomiędzy kartą sieciową a systemem operacyjnym, to

Parametry katalogowe przedstawione w ramce dotyczą dysku twardego

| ST31000528AS |

| Seagate Barracuda 7200.12 ,32 MB, |

| Serial ATA/300, Heads 4, Capacity 1TB |

Adres IP komputera wyrażony sekwencją 172.16.0.1 jest zapisany w systemie

Kabel pokazany na ilustracji może być zastosowany do realizacji okablowania sieci o standardzie

Lista sprzętu kompatybilnego z systemem operacyjnym Windows, publikowana przez firmę Microsoft to

Rodzaj przesyłania danych do jednego lub wielu komputerów jednocześnie, w którym odbiorcy są postrzegani przez nadawcę jako jedyny zbiorczy odbiorca, to

Aby była możliwa komunikacja pomiędzy dwiema różnymi sieciami, do których należą karty sieciowe serwera, należy w systemie Windows Server dodać rolę

Wynikiem wykonania komendy arp -a 192.168.1.1 w systemie MS Windows jest pokazanie

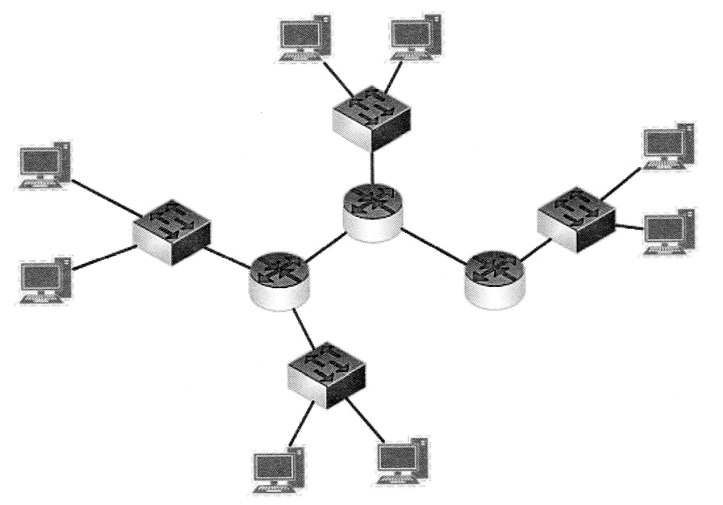

Na ilustracji zaprezentowano sieć komputerową w układzie

NAT64 (Network Address Translation 64) to proces, który dokonuje mapowania adresów

Gniazdo w sieciach komputerowych, które jednoznacznie identyfikuje dany proces na urządzeniu, stanowi kombinację

Możliwość weryfikacji poprawności działania pamięci RAM można uzyskać za pomocą programu diagnostycznego

Jakie znaczenie mają zwory na dyskach z interfejsem IDE?

Po włączeniu komputera wyświetlił się komunikat: "non-system disk or disk error. Replace and strike any key when ready". Jakie mogą być przyczyny?

Po wykonaniu eksportu klucza HKCR zostanie zapisana kopia rejestru, zawierająca informacje dotyczące konfiguracji

Ile maksymalnie urządzeń, wliczając w nie huby oraz urządzenia końcowe, może być podłączonych do interfejsu USB za pomocą magistrali utworzonej przy użyciu hubów USB?

Jakim protokołem komunikacyjnym, który gwarantuje niezawodne przesyłanie danych, jest protokół

Aby bezpiecznie połączyć się z firmowym serwerem przez Internet i mieć dostęp do zasobów firmy, należy wykorzystać odpowiednie oprogramowanie klienckie

Jaka jest binarna reprezentacja adresu IP 192.168.1.12?

Wskaż koszt brutto wykonanych przez serwisanta usług, jeśli do rachunku doliczony jest również koszt dojazdu w wysokości 55,00 zł netto.

| LP | Wykonana usługa | Cena usługi netto w zł | Stawka podatku VAT |

|---|---|---|---|

| 1. | Instalacja/ konfiguracja programu | 10,00 | 23% |

| 2. | Wymiana zasilacza | 40,00 | |

| 3. | Tworzenie kopii zapasowej i archiwizacja danych | 40,00 | |

| 4. | Konfiguracja przełącznika | 25,00 | |

| 5. | Instalacja i konfiguracja skanera | 45,00 |

Ile sieci obejmują komputery z adresami IP i maskami sieci podanymi w tabeli?

| Adres IPv4 | Maska |

|---|---|

| 10.120.16.10 | 255.255.0.0 |

| 10.120.18.16 | 255.255.0.0 |

| 10.110.16.18 | 255.255.255.0 |

| 10.110.16.14 | 255.255.255.0 |

| 10.130.16.12 | 255.255.255.0 |

Który z parametrów czasowych w pamięci RAM określany jest jako czas dostępu?

Jak nazywa się interfejs wewnętrzny w komputerze?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jak określana jest transmisja w obie strony w sieci Ethernet?

Na płycie głównej uszkodzona została zintegrowana karta sieciowa. Komputer nie ma możliwości uruchomienia systemu operacyjnego, ponieważ brakuje dysku twardego oraz napędów optycznych, a system operacyjny uruchamia się z lokalnej sieci. W celu odzyskania utraconej funkcjonalności należy zainstalować w komputerze

Która z warstw modelu ISO/OSI ma związek z protokołem IP?

Na ilustracji ukazana jest karta

Zadania systemu operacyjnego nie obejmują

Który z protokołów przesyła datagramy użytkownika BEZ GWARANCJI ich dostarczenia?

Jakie funkcje realizuje system informatyczny?Kursy informatyczne

Ile symboli routerów i przełączników występuje na diagramie?

Unity Tweak Tool oraz narzędzia dostrajania to elementy systemu Linux, które mają na celu