Pytanie 1

Gdy użytkownik zauważy, że ważne pliki zniknęły z dysku twardego, powinien

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Gdy użytkownik zauważy, że ważne pliki zniknęły z dysku twardego, powinien

Instalacja systemów Linux oraz Windows 7 odbyła się bez żadnych problemów. Systemy zainstalowały się prawidłowo z domyślnymi konfiguracjami. Na tym samym komputerze, przy tej samej specyfikacji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

Jakiego rodzaju złącze powinna mieć płyta główna, aby umożliwić zainstalowanie karty graficznej przedstawionej na rysunku?

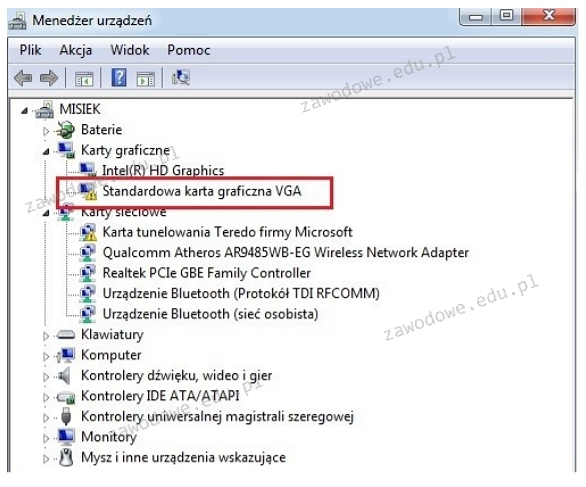

Błędy systemu operacyjnego Windows spowodowane przez konflikty zasobów sprzętowych, takie jak przydział pamięci, przydział przerwań IRQ i kanałów DMA, najłatwiej jest wykryć za pomocą narzędzia

Jaki adres IPv4 identyfikuje urządzenie funkcjonujące w sieci o adresie 14.36.64.0/20?

Brak danych dotyczących parzystości liczby lub znaku rezultatu operacji w ALU może sugerować usterki w funkcjonowaniu

Wyjście audio dla słuchawek lub głośników minijack na karcie dźwiękowej oznaczone jest jakim kolorem?

Kable światłowodowe nie są szeroko używane w lokalnych sieciach komputerowych z powodu

Jaka jest maksymalna prędkość transferu danych w sieci lokalnej, w której zastosowano przewód UTP kat.5e do budowy okablowania strukturalnego?

Który sterownik drukarki jest niezależny od urządzenia i systemu operacyjnego oraz jest standardem w urządzeniach poligraficznych?

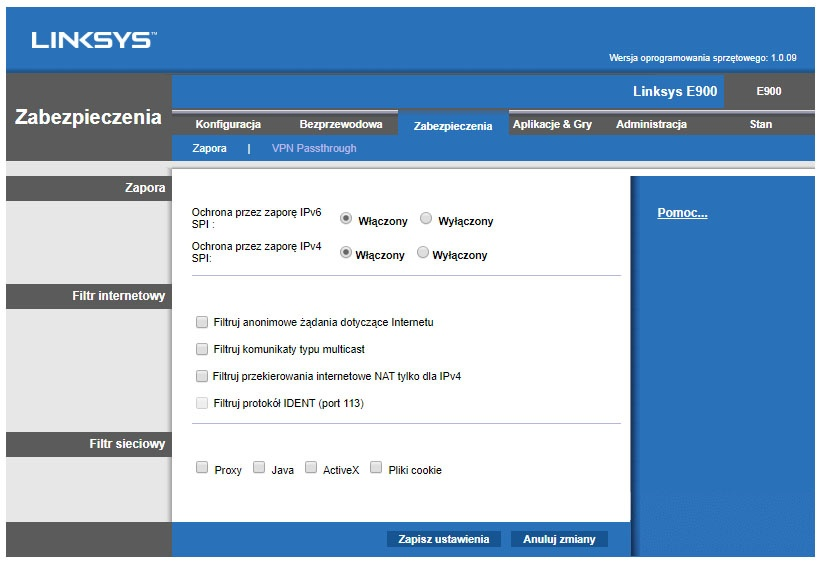

Na ilustracji przedstawiono okno konfiguracji rutera. Wskaż opcję, która wpływa na zabezpieczenie urządzenia przed atakami DDoS.

Na ilustracji ukazany jest komunikat systemowy. Jakie kroki powinien podjąć użytkownik, aby naprawić błąd?

Wykonanie polecenia attrib +h +s +r przykład.txt w terminalu systemu Windows spowoduje

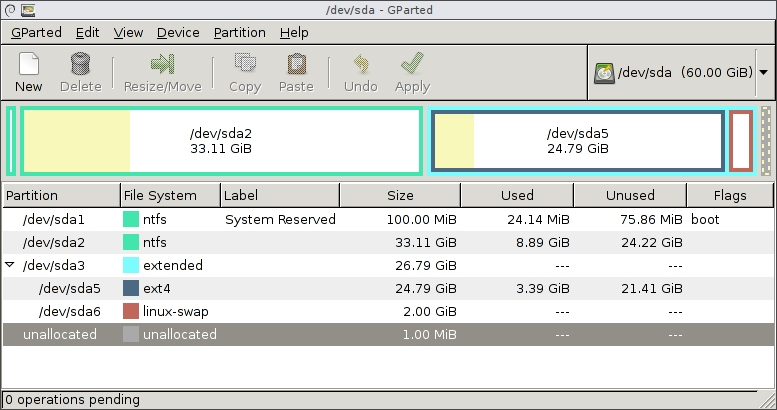

Badanie danych przedstawionych przez program umożliwia dojście do wniosku, że

Aby zweryfikować schemat połączeń kabla UTP Cat 5e w sieci lokalnej, należy zastosować

Które z poniższych poleceń w systemie Linux służy do zmiany uprawnień pliku?

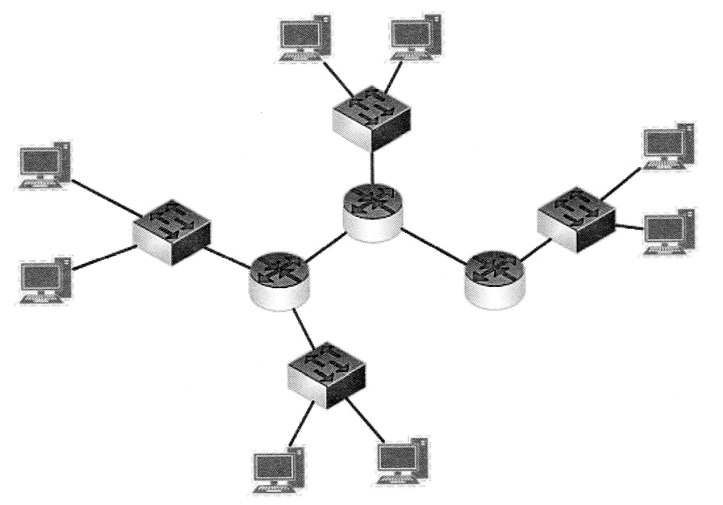

Ile symboli routerów i przełączników występuje na diagramie?

Program o nazwie dd, którego przykład zastosowania przedstawiono w systemie Linux, umożliwia

Która norma określa parametry transmisji dla komponentów kategorii 5e?

Aktywacja opcji Udostępnienie połączenia internetowego w systemie Windows powoduje automatyczne przydzielanie adresów IP dla komputerów (hostów) z niej korzystających. W tym celu używana jest usługa

Brak informacji o parzystości liczby lub o znaku wyniku operacji w ALU może sugerować problemy z funkcjonowaniem

Protokół poczty elektronicznej, który umożliwia zarządzanie wieloma skrzynkami pocztowymi oraz pobieranie i manipulowanie na wiadomościach przechowywanych na zdalnym serwerze, to

W jakiej topologii sieci komputerowej każdy komputer jest połączony z dokładnie dwoma innymi komputerami, bez żadnych dodatkowych urządzeń aktywnych?

Który standard Ethernet określa Gigabit Ethernet dla okablowania UTP?

Którego wbudowanego narzędzia w systemie Windows 8 Pro można użyć do szyfrowania danych?

Aby wymusić na użytkownikach lokalnych systemów z rodziny Windows Server regularną zmianę haseł oraz stosowanie haseł o odpowiedniej długości, które spełniają kryteria złożoności, należy ustawić

Tryb pracy portu równoległego, bazujący na magistrali ISA, umożliwiający transfer danych do 2,4 MB/s, dedykowany dla skanerów i urządzeń wielofunkcyjnych, to

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Dokument służący do zaprezentowania oferty cenowej dla inwestora dotyczącej wykonania robót instalacyjnych sieci komputerowej, to

Narzędzie zaprezentowane na rysunku jest wykorzystywane do przeprowadzania testów

Jakiego typu macierz RAID nie zapewnia odporności na awarie żadnego z dysków tworzących jej strukturę?

Użytkownik uszkodził płytę główną z gniazdem procesora AM2. Uszkodzoną płytę można wymienić na model z gniazdem, nie zmieniając procesora i pamięci

W systemie Linux program top umożliwia

Do weryfikacji integralności systemu plików w środowisku Linux trzeba zastosować polecenie

Tester strukturalnego okablowania umożliwia weryfikację

Jak należy rozmieszczać gniazda komputerowe RJ45 w odniesieniu do przestrzeni biurowej zgodnie z normą PN-EN 50174?

Jak można zwolnić miejsce na dysku, nie tracąc przy tym danych?

Podczas testowania kabla sieciowego zakończonego wtykami RJ45 przy użyciu diodowego testera okablowania, diody LED zapalały się w odpowiedniej kolejności, z wyjątkiem diod oznaczonych numerami 2 i 3, które świeciły równocześnie na jednostce głównej testera, natomiast na jednostce zdalnej nie świeciły wcale. Jaka mogła być tego przyczyna?

Jakie zastosowanie ma oprogramowanie Microsoft Hyper-V?

Które z poniższych stwierdzeń odnosi się do sieci P2P - peer to peer?