Pytanie 1

Które środki kontrastujące wykorzystywane są w diagnostyce rezonansem magnetycznym?

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Które środki kontrastujące wykorzystywane są w diagnostyce rezonansem magnetycznym?

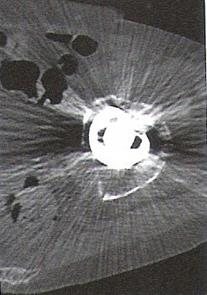

Zarejestrowany na obrazie TK artefakt jest spowodowany

Diagnozowanie metodą PET oparte jest na zjawisku

Teleradioterapia 4D na etapie planowania leczenia wykorzystuje obrazy

W radioterapii konwencjonalnej pacjent jest leczony promieniowaniem pochodzącym

Jakie wymagania techniczne muszą spełniać aparaty terapeutyczne stosowane w zakładach brachyterapii, służące bezpośrednio do napromieniania pacjenta metodą zdalnego wprowadzania źródeł promieniotwórczych?

W obrazowaniu MR wykorzystuje się moment magnetyczny

W badaniu PET stosuje się tylko radioizotopy emitujące

Która sekwencja obrazowania MR wykorzystuje impulsy RF o częstotliwości rezonansowej tłuszczu do tłumienia sygnału pochodzącego z tkanki tłuszczowej?

Brachyterapia polegająca na wielokrotnym wsuwaniu i wysuwaniu źródła promieniowania do tego samego aplikatora nosi nazwę

Zadaniem technika elektroradiologa w pracowni naczyniowej jest

Technika stereotaktyczna polega na napromienianiu nowotworu

Wysoką rozdzielczość przestrzenną obrazowania MR uzyskuje się przez

Który radioizotop jest emiterem promieniowania alfa?

Ligand stosuje się

Która struktura może być oknem akustycznym w badaniu ultrasonograficznym?

W której technice obrazowania zostają zarejestrowane jednocześnie dwa przeciwbieżne kwanty promieniowania gamma o równej energii 511 keV?

Hiperfrakcjonowanie dawki w teleradioterapii polega na napromienianiu 2 do 3 razy dziennie dawką frakcyjną

Wskaż roczną dawkę graniczną dla osób zatrudnionych w warunkach narażenia na promieniowanie jonizujące.

Jakie są wielkości mocy dawki stosowanej w brachyterapii HDR?

Do pomiaru dawek indywidualnych u osób narażonych zawodowo na promieniowanie rentgenowskie są stosowane

Promieniowanie rentgenowskie jest

W trakcie obrazowania metodą rezonansu magnetycznego wykorzystywane jest zjawisko wysyłania sygnału emitowanego przez

Źródłem promieniowania protonowego stosowanego w radioterapii jest

Zwiększenie napięcia na lampie rentgenowskiej powoduje

Która przyczyna spowodowała powstanie artefaktu widocznego na zamieszczonym obrazie MR?

Obrazy DDR są tworzone w trakcie

W medycznym przyspieszaczu liniowym jest generowana wiązka fotonów o energii w zakresie

W badaniu PET CT wykorzystuje się radioizotopy emitujące promieniowanie

W radiografii mianem SID określa się

Zastosowana w badaniu radiologicznym kratka przeciwrozproszeniowa powoduje

Promieniowanie jonizujące pośrednio to

W badaniu MR czas repetycji TR jest parametrem określającym odstęp czasu między

Przemiana promieniotwórcza radu w ren opisana wzorem \( {}_{88}^{226}\text{Ra} \to {}_{86}^{222}\text{Rn} + {}_{2}^{4}\text{He} \) jest rozpadem

W pozytonowej tomografii emisyjnej PET zostaje zarejestrowane promieniowanie powstające podczas

Nieostrość geometryczna obrazu rentgenowskiego zależy od

Skrótem CTV w radioterapii oznacza się

Podstawowym elementem diagnostycznym aparatury izotopowej wykorzystującej emisyjne metody pomiaru jest

Standardowe badanie USG średniej wielkości piersi wykonuje się głowicą w zakresie częstotliwości

Ligand stosuje się