Pytanie 1

Impulsator pozwala na testowanie uszkodzonych systemów logicznych w komputerze, między innymi poprzez

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Impulsator pozwala na testowanie uszkodzonych systemów logicznych w komputerze, między innymi poprzez

Wskaż błędny podział dysku MBR na partycje?

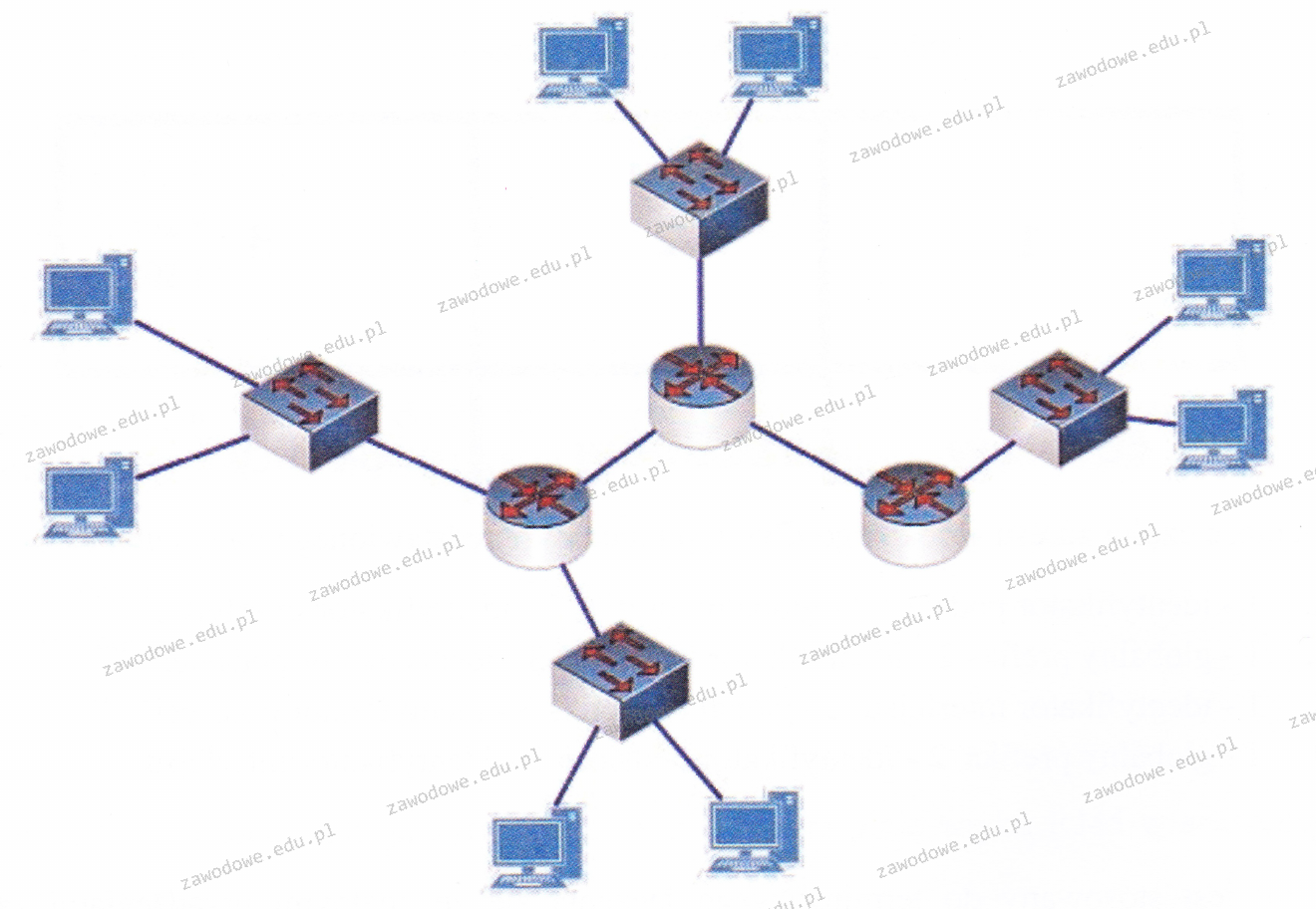

Na ilustracji przedstawiono sieć komputerową w danej topologii

Termin określający wyrównanie tekstu do prawego i lewego marginesu to

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jeżeli rozmiar jednostki alokacji wynosi 1024 bajty, to ile klastrów zajmą pliki umieszczone w tabeli na dysku?

| Nazwa | Wielkość |

|---|---|

| Ala.exe | 50 B |

| Dom.bat | 1024 B |

| Wirus.exe | 2 kB |

| Domes.exr | 350 B |

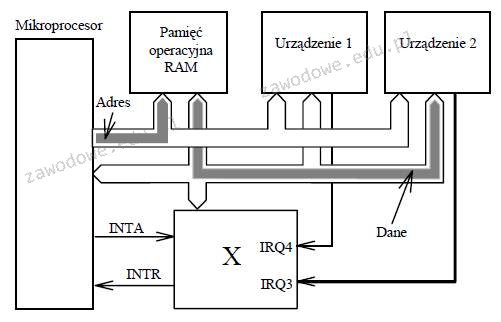

Na przedstawionym schemacie blokowym fragmentu systemu mikroprocesorowego, co oznacza symbol X?

Które urządzenie może zostać wykorzystane do rutowania ruchu sieciowego między sieciami VLAN?

W hierarchicznym modelu sieci, komputery należące do użytkowników są składnikami warstwy

W usłudze, jaką funkcję pełni protokół RDP?

Kiedy dysze w drukarce atramentowej wyschną z powodu długotrwałych przerw w użytkowaniu, co powinno się najpierw wykonać?

Oprogramowanie, które pozwala na interakcję pomiędzy kartą sieciową a systemem operacyjnym, to

Który kolor żyły znajduje się w kablu skrętkowym?

Aby zabezpieczyć system przed oprogramowaniem o zdolności do samoreplikacji, należy zainstalować

Instalacja systemów Linux oraz Windows 7 przebiegła bez żadnych problemów. Systemy zainstalowały się poprawnie z domyślnymi ustawieniami. Na tym samym komputerze, przy tej samej konfiguracji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

Najwyższą prędkość transmisji danych w sieciach bezprzewodowych zapewnia standard

Aby zwiększyć bezpieczeństwo osobistych danych podczas przeglądania stron internetowych, warto dezaktywować w ustawieniach przeglądarki

Który aplet w panelu sterowania systemu Windows 7 pozwala na ograniczenie czasu, jaki użytkownik spędza przed komputerem?

Bezprzewodową komunikację komputerów w sieci lokalnej zapewnia

Co oznacza skrót RAID w kontekście pamięci masowej?

W dokumentacji płyty głównej podano informację "wsparcie dla S/PDIF Out". Co to oznacza w kontekście tej płyty głównej?

Ile symboli switchy i routerów znajduje się na schemacie?

Przedstawiony moduł pamięci należy zamontować na płycie głównej w gnieździe

Do serwisu komputerowego przyniesiono laptop z matrycą, która bardzo słabo wyświetla obraz. Dodatkowo obraz jest niezwykle ciemny i widoczny jedynie z bliska. Co może być przyczyną tej usterki?

Do przeprowadzenia aktualizacji systemu Windows służy polecenie

Co oznacza oznaczenie kabla skrętkowego U/FTP?

Wynikiem dodawania dwóch liczb binarnych 1101011 oraz 1001001 jest liczba w systemie dziesiętnym

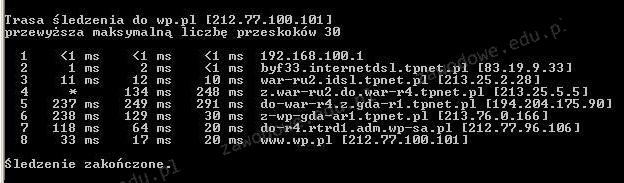

Jaki wynik działania którego z poleceń w systemie Windows jest zaprezentowany na rysunku?

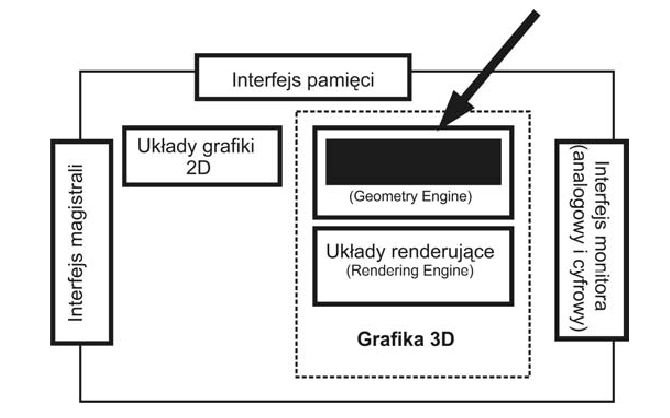

Jakie zadanie realizuje układ oznaczony strzałką na diagramie karty graficznej?

W trakcie konserwacji oraz czyszczenia drukarki laserowej, która jest odłączona od zasilania, pracownik serwisu komputerowego może zastosować jako środek ochrony osobistej

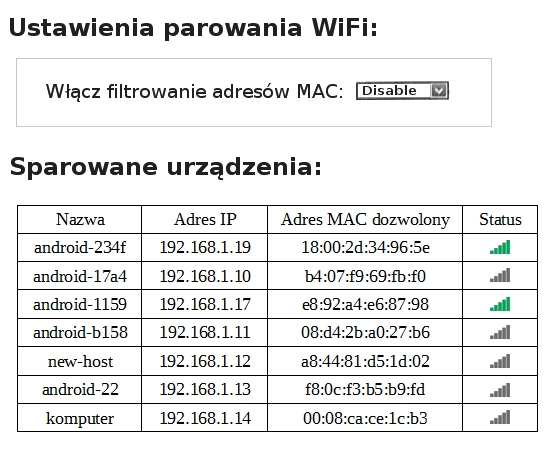

Na rysunku przedstawiono konfigurację urządzenia WiFi. Wskaż, które z poniższych stwierdzeń dotyczących tej konfiguracji jest poprawne?

W IPv6 odpowiednikiem adresu pętli zwrotnej jest adres

Podstawowym zadaniem mechanizmu Plug and Play jest:

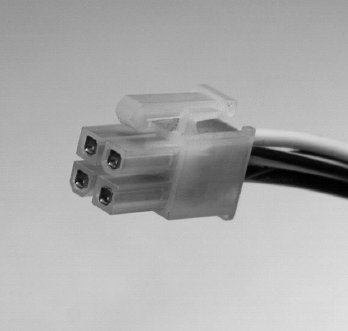

Wtyczka zaprezentowana na fotografie stanowi element obwodu elektrycznego zasilającego

W systemie Linux polecenie touch jest używane do

Jakim systemem operacyjnym jest system czasu rzeczywistego?

Jaką funkcję pełni protokół ARP (Address Resolution Protocol)?

W lokalnej sieci protokołem odpowiedzialnym za dynamiczną konfigurację adresów IP jest

Która z kart graficznych nie będzie kompatybilna z monitorem, posiadającym złącza pokazane na ilustracji (zakładając, że nie można użyć adaptera do jego podłączenia)?

Podczas zamykania systemu operacyjnego na ekranie pojawił się błąd, tak zwany bluescreen, 0x000000F3 Bug Check 0xF3 DISORDERLY_SHUTDOWN – niepowodzenie zamykania systemu, spowodowane brakiem pamięci. Błąd ten może wskazywać na