Pytanie 1

Aby ustalić fizyczny adres karty sieciowej, w terminalu systemu Microsoft Windows należy wpisać komendę

Wynik: 10/40 punktów (25,0%)

Wymagane minimum: 20 punktów (50%)

Aby ustalić fizyczny adres karty sieciowej, w terminalu systemu Microsoft Windows należy wpisać komendę

Jaką normę stosuje się w przypadku okablowania strukturalnego w sieciach komputerowych?

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue, press Del to setup) naciśnięcie klawisza Del skutkuje

Ikona z wykrzyknikiem, którą widać na ilustracji, pojawiająca się przy nazwie urządzenia w Menedżerze urządzeń, wskazuje, że to urządzenie

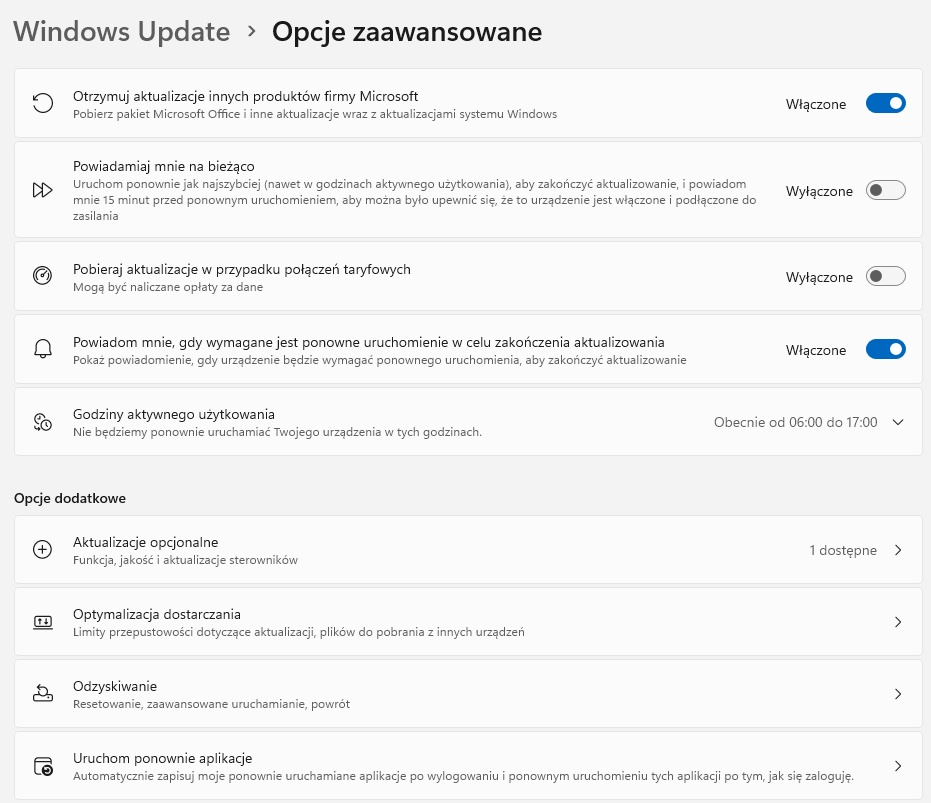

Biorąc pod uwagę konfigurację wykonywaną na ilustracji, administrator po zainstalowaniu systemu operacyjnego uznał za istotne, aby

W jakim modelu płyty głównej można zainstalować procesor o wymienionych specyfikacjach?

| Intel Core i7-4790 3,6 GHz 8MB cache s. 1150 Box |

Równoległy interfejs, w którym magistrala składa się z 8 linii danych, 4 linii sterujących oraz 5 linii statusowych, nie zawiera linii zasilających i umożliwia transmisję na odległość do 5 metrów, pod warunkiem, że przewody sygnałowe są skręcane z przewodami masy; w przeciwnym razie limit wynosi 2 metry, nazywa się

Aby osiągnąć przepustowość wynoszącą 4 GB/s w obie strony, konieczne jest zainstalowanie w komputerze karty graficznej korzystającej z interfejsu

Jakie funkcje pełni protokół ARP (Address Resolution Protocol)?

Na ilustracji przedstawiono część procesu komunikacji z serwerem, która została przechwycona przez aplikację Wireshark. Jaki to serwer?

Discover - Transaction ID 0x6a16b7a5 Offer - Transaction ID 0x6a16b7a5 Request - Transaction ID 0x6a16b7a5 ACK - Transaction ID 0x6a16b7a5

Informacja tekstowa KB/Interface error, widoczna na wyświetlaczu komputera podczas BIOS POST od firmy AMI, wskazuje na problem

Jakim elementem sieci SIP jest telefon IP?

Program "VirtualPC", dostępny do pobrania z witryny Microsoft, jest przeznaczony do korzystania:

Oznaczenie CE świadczy o tym, że

Które środowisko graficzne przeznaczone dla systemu Linux charakteryzuje się najmniejszymi wymaganiami parametrów pamięci RAM?

Aby uzyskać na ekranie monitora odświeżanie obrazu 85 razy w ciągu sekundy, trzeba częstotliwość jego odświeżania ustawić na

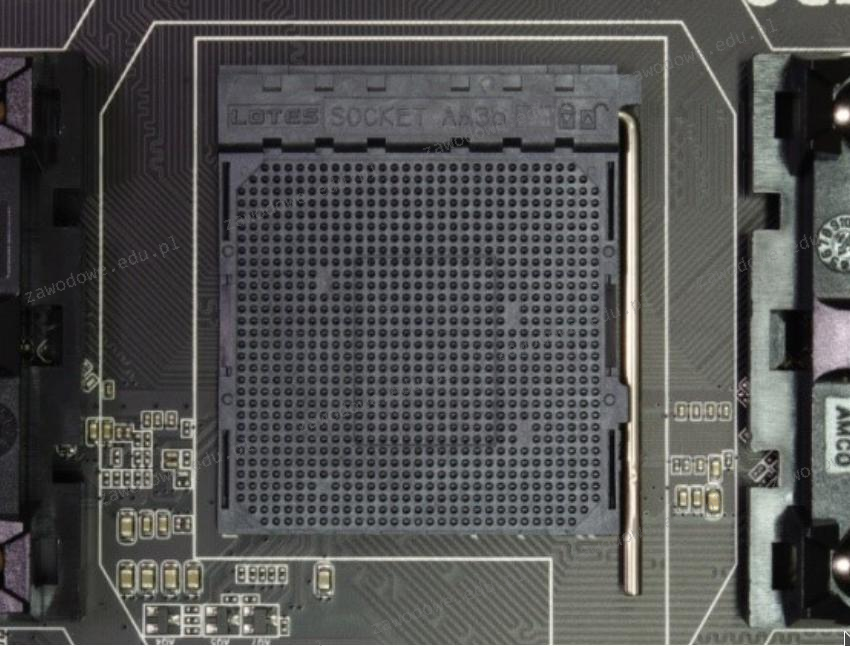

Na płycie głównej z gniazdem pokazanym na fotografii możliwe jest zainstalowanie procesora

Urządzenie przedstawione na obrazie jest przeznaczone do

Jaki protokół umożliwia terminalowe połączenie zdalne z urządzeniami, zapewniając przy tym transfer danych w sposób zaszyfrowany?

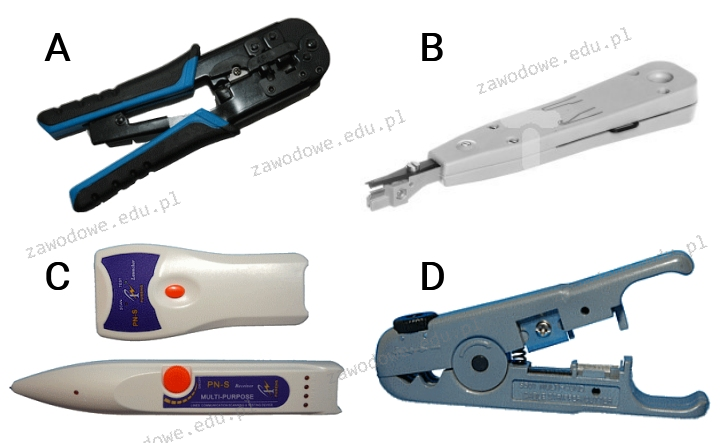

Jakie urządzenie jest używane do mocowania pojedynczych żył kabla miedzianego w złączach?

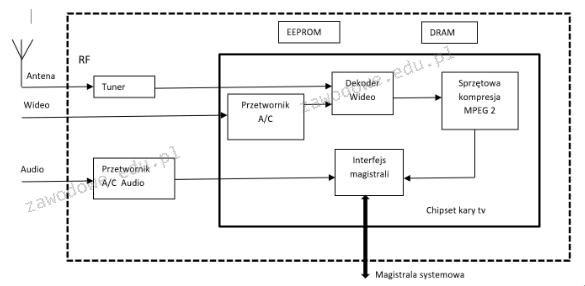

Na ilustracji przedstawiono diagram blokowy karty

Ile adresów urządzeń w sieci jest dostępnych dzięki zastosowaniu klasy adresowej C w systemach opartych na protokołach TCP/IP?

Jaki akronim odnosi się do przepustowości sieci oraz usług, które mają między innymi na celu nadawanie priorytetów przesyłanym pakietom?

Na ilustracji pokazano interfejs w komputerze dedykowany do podłączenia

Jakie polecenie systemu Windows przedstawione jest na ilustracji?

Adres fizyczny Nazwa transportu

===========================================================

00-23-AE-09-47-CF Nośnik rozłączony

00-23-4D-CB-B4-BB Brak

00-23-4D-CB-B4-BB Nośnik rozłączonyAby zwiększyć wydajność komputera, można zainstalować procesor obsługujący technologię Hyper-Threading, która pozwala na

Jaką postać ma liczba szesnastkowa: FFFF w systemie binarnym?

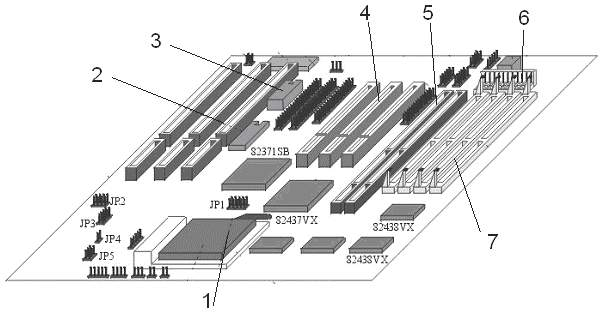

Na schemacie płyty głównej port PCI oznaczony jest numerem

Jakie zastosowanie ma oprogramowanie Microsoft Hyper-V?

Jak można skonfigurować interfejs sieciowy w systemie Linux, modyfikując plik

Jakie narzędzie pozwala na zarządzanie menadżerem rozruchu w systemach Windows od wersji Vista?

Port AGP służy do łączenia

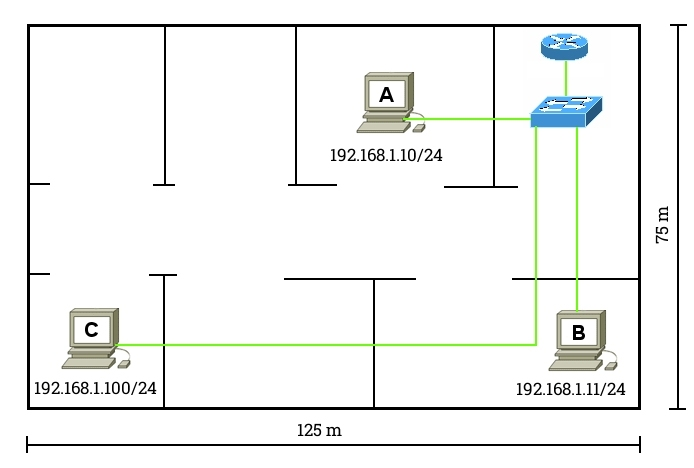

Na schemacie pokazano sieć LAN wykorzystującą okablowanie kategorii 6. Stacja robocza C nie może nawiązać połączenia z siecią. Jaki problem warstwy fizycznej może być przyczyną braku komunikacji?

Członkostwo komputera w danej sieci wirtualnej nie może być ustalane na podstawie

Router Wi-Fi działający w technologii 802.11n umożliwia osiągnięcie maksymalnej prędkości przesyłu danych

Klawiatura w układzie QWERTY, która pozwala na wpisywanie znaków typowych dla języka polskiego, jest znana jako klawiatura

W schemacie logicznym struktury okablowania, zgodnie z polską terminologią zawartą w normie PN-EN 50174, cechą kondygnacyjnego punktu dystrybucyjnego jest to, że

Aby zmagazynować 10 GB danych na pojedynczej płycie DVD, jaki typ nośnika powinien być wykorzystany?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Dysk zewnętrzny 3,5" o pojemności 5 TB, służący do przechowywania lub tworzenia kopii zapasowych, posiada obudowę z czterema interfejsami komunikacyjnymi do wyboru. Który z tych interfejsów należy wykorzystać do połączenia z komputerem, aby uzyskać największą prędkość transmisji?