Pytanie 1

Zapisana w ramce funkcja zawiera

| Funkcja oblicz(n) Jeżeli n=0 oblicz=1 W przeciwnym wypadku oblicz=(n-1)*oblicz(n-1) |

Wynik: 40/40 punktów (100,0%)

Wymagane minimum: 20 punktów (50%)

Zapisana w ramce funkcja zawiera

| Funkcja oblicz(n) Jeżeli n=0 oblicz=1 W przeciwnym wypadku oblicz=(n-1)*oblicz(n-1) |

Pojęcie „Architektura Harvardska” odnosi się do

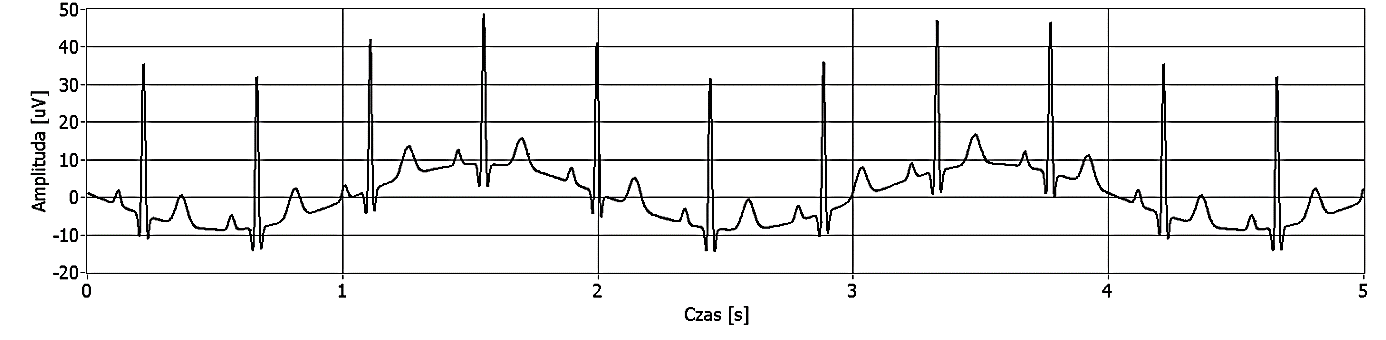

Które oznaczenie określa zapis elektryczny aktywności mózgu?

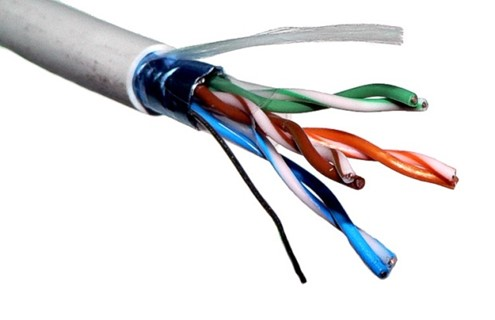

Który typ przewodu przedstawiono na rysunku?

Który system plików pozwala na szyfrowanie danych w systemie Windows?

Zestaw przedstawiony na rysunku przeznaczony jest do przeprowadzania testu aparatu

Który system plików jest dedykowany systemowi Linux oraz nie jest używany w systemie Windows?

Który interfejs nie umożliwia podłączenia urządzeń peryferyjnych w standardzie „plug and play”?

Zasilacz, który podczas normalnej pracy zasila urządzenie, jednocześnie ładując akumulator, a podczas awarii zasilania sieciowego zasila urządzenie z akumulatora, oznaczany jest skrótem

Rysunek przedstawia raport sprawdzający połączenie pomiędzy stacjami monitorującymi informatycznego systemu medycznego. Którego polecenia należy użyć aby go uzyskać?

W programowaniu, aby przerwać wykonywanie pętli i wyjść z niej, należy użyć polecenia

W dokumentacji skanera zapisano „rozdzielczość optyczna 600 x 600 [dpi]”. Skrót dpi określa liczbę punktów

Dla sieci o adresie 192.150.160.0/26 pula adresów IP dla urządzeń w tej sieci zawiera się w zakresie

Który zabieg wymusza naprzemienną pracę mięśni zginaczy i prostowników poprzez stymulację mięśni impulsem prądowym?

Które ustawienie należy wybrać na multimetrze w celu pomiaru napięcia 12 V w obwodzie prądu stałego?

Dla której wartości z wymienionych rezystancji, zastosowanie układu poprawnie mierzonego prądu zapewnia najmniejszy błąd pomiaru?

Proces, w którym w bazie danych są usuwane nadmiarowe dane, jest określany jako

W zabiegu jonoforezy leki są transportowane przez skórę do głębiej położonych warstw poprzez zastosowanie

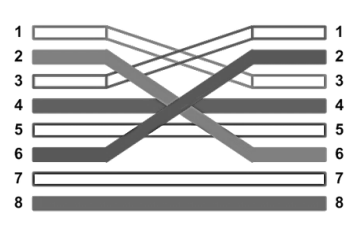

Kabel krosowany jest wykorzystany do połączenia

Który endoskop pozwala na badanie wnętrza tchawicy i oskrzeli?

Zjawisko polegające na zmianie częstotliwości fali odbitej od poruszającego się obiektu jest wykorzystywane w

W celu wyszukania błędów w programie wykorzystuje się

Które polecenie w systemie Windows tworzy folder Dane?

W dokumencie urządzenia elektroniki medycznej podano następujące informacje:

Interfejs obrazu DICOM • Maksymalna szybkość przesyłania wg standardu Ethernet: 100 Mb/s. • Szybkość przesyłania obrazów: 2 MB/s. Interfejs RIS/CIS zgodny z DICOM • Maksymalna szybkość przesyłania wg standardu Ethernet: 100 Mb/s. |

Które urządzenie medyczne wspomaga lub zastępuje mięśnie pacjenta w oddychaniu?

Podczas testowania elektrokardiografu otrzymano przedstawiony przebieg. Na jego podstawie stwierdzono, że nieprawidłowo działa filtr zakłóceń

Technologia OLED znajduje zastosowanie w

Do badania przewodnictwa powietrznego i kostnego służy

Wymianą informacji pomiędzy układami znajdującymi się na płycie głównej komputera steruje

Rysunek przedstawia wynik działania polecenia ipconfig urządzenia w sieci LAN. Który adres rutera umożliwia dostęp tego urządzenia do sieci WAN?

Którego nośnika pamięci należy użyć w komputerze, aby zapewnić najszybsze ładowanie się systemu operacyjnego podczas jego uruchamiania?

W celu określenia trasy, przez jakie routery przechodzi sygnał pomiędzy komputerami w sieci szpitalnej, można zastosować polecenie

W dokumentacji elektrokardiografu znajduje się informacja o wyposażeniu aparatu w filtry cyfrowe 50 Hz, 35 Hz i filtr antydriftowy. Które zakłócenia eliminuje z sygnału EKG filtr 50 Hz?

Przepływ przez organizm człowieka prądów o wysokiej częstotliwości, mających zastosowanie w elektrochirurgii, może powodować

Na zdjęciu przedstawiono

Wynikiem działania funkcji F(n) będzie

funkcja F(n) jeżeli n>1 F(n)=3*F(n-1) w przeciwnym wypadku F(n)=3 |

Jaki powinien być ustawiony adres maski podsieci, aby umożliwiał podłączenie maksymalnie 30 urządzeń?

Który system informatyki medycznej umożliwia archiwizację obrazów?

Którą metodę montażu należy zastosować w celu zakończenia przewodu zasilającego końcówkami przedstawionymi na fotografii?

Czujnik tensometryczny i sonda ultradźwiękowa są elementami aparatu