Pytanie 1

Wykorzystane kasety od drukarek powinny być

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Wykorzystane kasety od drukarek powinny być

Na komputerze z zainstalowanymi systemami operacyjnymi Windows i Linux, po przeprowadzeniu reinstalacji systemu Windows, drugi system przestaje się uruchamiać. Aby przywrócić możliwość uruchamiania systemu Linux oraz zachować dane i ustawienia w nim zgromadzone, co należy zrobić?

Do jakich celów powinno się aktywować funkcję RMON (Remote Network Monitoring) w przełączniku?

Aby dostęp do systemu Windows Serwer 2016 był możliwy dla 50 urządzeń, bez względu na liczbę użytkowników, należy w firmie zakupić licencję

Skrót określający translację adresów w sieciach to

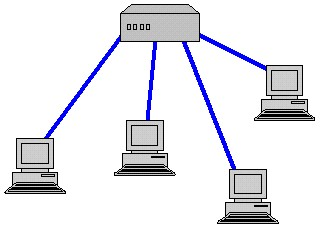

Jaką topologię fizyczną sieci ukazuje przedstawiony rysunek?

Wykonanie polecenia fsck w systemie Linux będzie skutkować

Obecnie pamięci podręczne drugiego poziomu procesora (ang. "L-2 cache") są zbudowane z układów pamięci

Proces zapisywania kluczy rejestru do pliku określamy jako

Jak określa się w systemie Windows profil użytkownika, który jest tworzony przy pierwszym logowaniu do komputera i zapisywany na lokalnym dysku twardym, a wszelkie jego modyfikacje dotyczą tylko tego konkretnego komputera?

Aby monitorować stan dysków twardych w serwerach, komputerach osobistych i laptopach, można użyć programu

Najbardziej nieinwazyjnym, a zarazem efektywnym sposobem naprawy komputera zainfekowanego wirusem typu rootkit jest

Na komputerze, na którym zainstalowane są dwa systemy – Windows i Linux, po przeprowadzeniu reinstalacji systemu Windows drugi system przestaje się uruchamiać. Aby ponownie umożliwić uruchamianie systemu Linux oraz aby zachować wszystkie dane i ustawienia w nim zawarte, co należy zrobić?

W systemie operacyjnym Linux, do konfigurowania sieci VLAN wykorzystuje się polecenie

Aby osiągnąć optymalną prędkość przesyłu danych, gdy domowy ruter działa w paśmie 5 GHz, do laptopa należy zainstalować kartę sieciową bezprzewodową obsługującą standard

Transmisję danych bezprzewodowo realizuje interfejs

Minimalna odległość toru nieekranowanego kabla sieciowego od instalacji elektrycznej oświetlenia powinna wynosić

Programem wiersza poleceń w systemie Windows, który umożliwia kompresję oraz dekompresję plików i folderów, jest aplikacja

Jakie miejsce nie jest zalecane do przechowywania kopii zapasowej danych z dysku twardego komputera?

Najlepszym sposobem na zabezpieczenie domowej sieci Wi-Fi jest

Przedstawione narzędzie podczas naprawy zestawu komputerowego przeznaczone jest do

Gdy użytkownik zauważy, że ważne pliki zniknęły z dysku twardego, powinien

Rezultatem wykonania przedstawionego fragmentu skryptu jest:

#!/bin/sh mkdir kat1 touch kat1/plik.txt

Aby użytkownik systemu Linux mógł sprawdzić zawartość katalogu, wyświetlając pliki i katalogi, oprócz polecenia ls może skorzystać z polecenia

Zastąpienie koncentratorów przełącznikami w sieci Ethernet doprowadzi do

Jaką funkcję pełni serwer ISA w systemie Windows?

Jaką prędkość przesyłu danych określa standard sieci Ethernet IEEE 802.3z?

Do jakiej grupy w systemie Windows Server 2008 powinien być przypisany użytkownik odpowiedzialny jedynie za archiwizację danych zgromadzonych na dysku serwera?

Podczas skanowania reprodukcji obrazu z magazynu, na skanie obrazu ukazały się regularne wzory, zwane morą. Jakiej funkcji skanera należy użyć, aby usunąć te wzory?

Które narzędzie jest przeznaczone do lekkiego odgięcia blachy obudowy komputera oraz zamocowania śruby montażowej w trudno dostępnym miejscu?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Użytkownicy sieci Wi-Fi zauważyli zakłócenia oraz częste przerwy w połączeniu. Przyczyną tej sytuacji może być

Jakie porty powinny być odblokowane w ustawieniach firewalla na komputerze, na którym działa usługa serwera WWW?

Urządzenie sieciowe działające w drugiej warstwie modelu OSI, które przesyła sygnał do portu połączonego z urządzeniem odbierającym dane na podstawie analizy adresów MAC nadawcy i odbiorcy, to

W norma PN-EN 50174 brak jest wskazówek odnoszących się do

Jak nazywa się zestaw usług internetowych dla systemów operacyjnych Microsoft Windows, który pozwala na działanie jako serwer FTP i serwer WWW?

Jakiego typu wkrętak należy użyć do wypięcia dysku twardego mocowanego w laptopie za pomocą podanych śrub?

Która z poniższych topologii sieciowych charakteryzuje się centralnym węzłem, do którego podłączone są wszystkie inne urządzenia?

Po podłączeniu działającej klawiatury do jednego z portów USB nie ma możliwości wyboru awaryjnego trybu uruchamiania systemu Windows. Mimo to po uruchomieniu systemu w standardowym trybie klawiatura funkcjonuje prawidłowo. Co to oznacza?

Jakie czynniki nie powodują utraty danych z dysku twardego HDD?