Pytanie 1

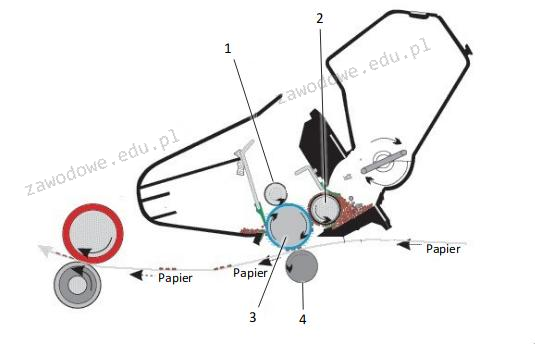

Na schemacie ilustrującym konstrukcję drukarki, w której toner jest nierównomiernie dostarczany do bębna, należy wskazać wałek magnetyczny oznaczony numerem

Wynik: 36/40 punktów (90,0%)

Wymagane minimum: 20 punktów (50%)

Na schemacie ilustrującym konstrukcję drukarki, w której toner jest nierównomiernie dostarczany do bębna, należy wskazać wałek magnetyczny oznaczony numerem

Aby umożliwić wymianę informacji pomiędzy sieciami VLAN, wykorzystuje się

Płyta główna wyposażona w gniazdo G2 będzie współpracowała z procesorem

Minimalna zalecana ilość pamięci RAM dla systemu operacyjnego Windows Server 2008 wynosi przynajmniej

Jak nazywa się materiał używany w drukarkach 3D?

Jaki procesor powinien być zastosowany podczas składania komputera stacjonarnego opartego na płycie głównej Asus M5A78L-M/USB3 AMD760G socket AM3+?

Jakie znaczenie ma parametr LGA 775 zawarty w dokumentacji technicznej płyty głównej?

Funkcja systemu Windows Server, umożliwiająca zdalną instalację systemów operacyjnych na komputerach kontrolowanych przez serwer, to

Protokół SNMP (Simple Network Management Protocol) jest wykorzystywany do

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakie polecenie systemu Windows przedstawione jest na ilustracji?

Adres fizyczny Nazwa transportu

===========================================================

00-23-AE-09-47-CF Nośnik rozłączony

00-23-4D-CB-B4-BB Brak

00-23-4D-CB-B4-BB Nośnik rozłączonyKtóre z kart sieciowych o podanych adresach MAC zostały wytworzone przez tego samego producenta?

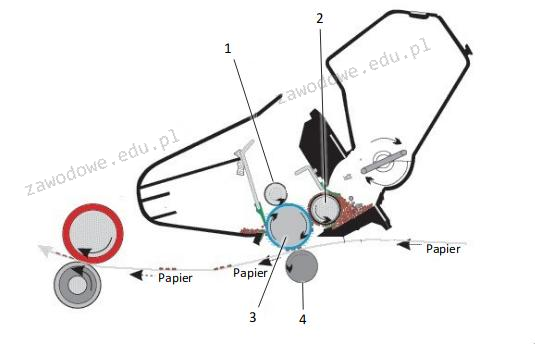

Na ilustracji widoczne jest oznaczenie sygnalizacji świetlnej w dokumentacji technicznej laptopa. Wskaż numer odpowiadający kontrolce, która zapala się podczas ładowania akumulatora?

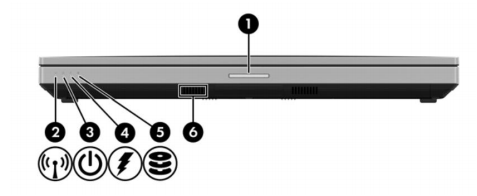

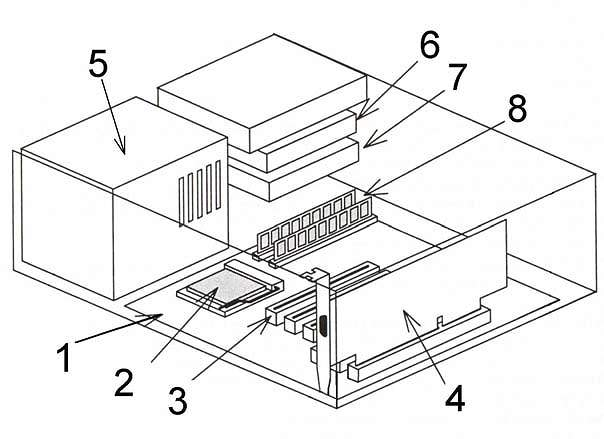

Na ilustracji procesor jest oznaczony liczbą

Jaką rolę należy przypisać serwerowi z rodziny Windows Server, aby mógł świadczyć usługi rutingu?

Jaka usługa musi być aktywna na serwerze, aby stacja robocza mogła automatycznie otrzymywać adres IP?

W hierarchicznym modelu sieci komputery użytkowników stanowią część warstwy

Dostosowanie ustawień parametrów TCP/IP urządzenia na podstawie adresu MAC karty sieciowej jest funkcją protokołu

Ile podsieci tworzą komputery z adresami: 192.168.5.12/25, 192.168.5.50/25, 192.168.5.200/25, 192.158.5.250/25?

W doborze zasilacza do komputera kluczowe znaczenie

Który z protokołów jest używany do przesyłania plików na serwer?

Pamięć RAM pokazana na ilustracji jest instalowana na płycie głównej posiadającej gniazdo

W sytuacji, gdy brakuje odpowiedniej ilości pamięci RAM do przeprowadzenia operacji, takiej jak uruchomienie aplikacji, system Windows pozwala na przeniesienie nieużywanych danych z pamięci RAM do pliku

Transmisja w standardzie 100Base-T korzysta z kabli skrętkowych, które mają

Atak na system komputerowy przeprowadzany jednocześnie z wielu maszyn w sieci, który polega na zablokowaniu działania tego systemu przez zajęcie wszystkich dostępnych zasobów, określany jest mianem

Program df pracujący w systemach z rodziny Linux pozwala na wyświetlenie

Nie jest możliwe tworzenie okresowych kopii zapasowych z dysku serwera na przenośnych nośnikach typu

Według KNR (katalogu nakładów rzeczowych) montaż 4-parowego modułu RJ45 oraz złącza krawędziowego to 0,07 r-g, natomiast montaż gniazd abonenckich natynkowych wynosi 0,30 r-g. Jak wysoki będzie koszt robocizny za zamontowanie 10 pojedynczych gniazd natynkowych z modułami RJ45, jeśli wynagrodzenie godzinowe montera-instalatora wynosi 20,00 zł?

Aby uzyskać listę procesów aktualnie działających w systemie Linux, należy użyć polecenia

Urządzenie peryferyjne, które jest kontrolowane przez komputer i wykorzystywane do obsługi dużych, płaskich powierzchni, a do produkcji druków odpornych na czynniki zewnętrzne używa farb rozpuszczalnikowych, to ploter

Przedstawiony skaner należy podłączyć do komputera przy użyciu złącza

Jak nazywa się seria procesorów produkowanych przez firmę Intel, charakteryzująca się małymi wymiarami oraz niskim zużyciem energii, zaprojektowana z myślą o urządzeniach mobilnych?

Które z urządzeń używanych w sieci komputerowej NIE WPŁYWA na liczbę domen kolizyjnych?

Płyta główna serwerowa potrzebuje pamięci z rejestrem do prawidłowego funkcjonowania. Który z poniższych modułów pamięci będzie zgodny z tą płytą?

Aby poprawić bezpieczeństwo zasobów sieciowych, administrator sieci komputerowej w firmie został zobowiązany do podziału istniejącej lokalnej sieci komputerowej na 16 podsieci. Pierwotna sieć miała adres IP 192.168.20.0 z maską 255.255.255.0. Jaką maskę sieci powinien zastosować administrator?

Aby uzyskać wyświetlenie podanych informacji o systemie Linux w terminalu, należy skorzystać z komendy

Które z metod szyfrowania wykorzystywanych w sieciach bezprzewodowych jest najsłabiej zabezpieczone przed łamaniem haseł?

W warstwie łącza danych modelu odniesienia ISO/OSI możliwą przyczyną błędów działania lokalnej sieci komputerowej jest

Użytkownik systemu Windows wybrał opcję powrót do punktu przywracania. Które pliki powstałe po wybranym punkcie nie zostaną naruszone przez tę akcję?

Termin określający wyrównanie tekstu do prawego i lewego marginesu to