Pytanie 1

Jakie polecenie należy wprowadzić w wierszu polecenia systemów Windows Server, aby zaktualizować dzierżawy adresów DHCP oraz przeprowadzić rejestrację nazw w systemie DNS?

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Jakie polecenie należy wprowadzić w wierszu polecenia systemów Windows Server, aby zaktualizować dzierżawy adresów DHCP oraz przeprowadzić rejestrację nazw w systemie DNS?

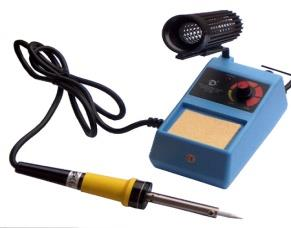

Urządzenie przedstawione na ilustracji, wraz z podanymi danymi technicznymi, może być zastosowane do pomiarów systemów okablowania

Do realizacji alternatywy logicznej z negacją należy użyć funktora

Jaki protokół jest używany przez komendę ping?

Który przyrząd należy wykorzystać do uzyskania wyników testu POST dla modułów płyty głównej?

Prawo osobiste twórcy do oprogramowania komputerowego

Której komendy wiersza poleceń z opcji zaawansowanych naprawy systemu Windows należy użyć, aby naprawić uszkodzony MBR dysku?

Jakie urządzenie powinno być użyte w sieci Ethernet, aby zredukować liczbę kolizji pakietów?

W skład sieci komputerowej wchodzą 3 komputery stacjonarne oraz drukarka sieciowa, połączone kablem UTP z routerem mającym 1 x WAN oraz 5 x LAN. Które z urządzeń sieciowych pozwoli na podłączenie dodatkowych dwóch komputerów do tej sieci za pomocą kabla UTP?

Która z wymienionych czynności konserwacyjnych związana jest wyłącznie z drukarką laserową?

Który z podanych adresów IP jest adresem publicznym?

Do eliminowania plików lub folderów w systemie Linux używa się polecenia

W strukturze sieciowej zaleca się umiejscowienie jednego punktu abonenckiego na powierzchni wynoszącej

Co jest efektem polecenia ipconfig /release?

W trakcie instalacji oraz konfiguracji serwera DHCP w systemach z rodziny Windows Server istnieje możliwość dodania zastrzeżeń adresów, które określą

Jakie oprogramowanie opisuje najnowsza wersja wieloplatformowego klienta, który cieszy się popularnością wśród użytkowników na całym świecie, oferującego wirtualną sieć prywatną do nawiązywania połączenia pomiędzy hostem a lokalnym komputerem, obsługującego uwierzytelnianie z wykorzystaniem kluczy, certyfikatów, nazwy użytkownika i hasła, a także dodatkowych kart w wersji dla Windows?

Aby użytkownik systemu Linux mógł sprawdzić zawartość katalogu, wyświetlając pliki i katalogi, oprócz polecenia ls może skorzystać z polecenia

Nie wykorzystuje się do zdalnego kierowania stacjami roboczymi

Poleceniem systemu Linux służącym do wyświetlenia informacji, zawierających aktualną godzinę, czas działania systemu oraz liczbę zalogowanych użytkowników, jest

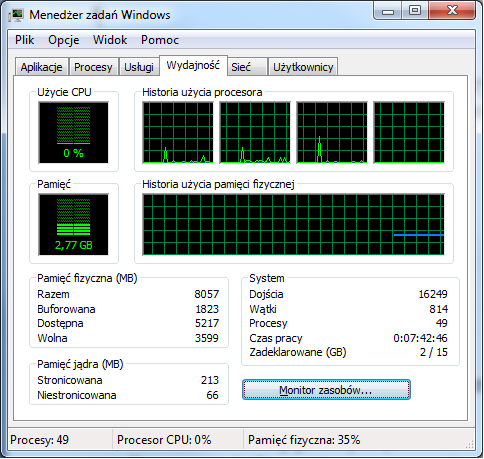

W systemie Windows do uruchomienia przedstawionego narzędzia należy użyć polecenia

Który adres IP posiada maskę w postaci pełnej, zgodną z klasą adresu?

Router Wi-Fi działający w technologii 802.11n umożliwia osiągnięcie maksymalnej prędkości przesyłu danych

Jakie znaczenie ma parametr NEXT w kontekście pomiarów systemów okablowania strukturalnego?

W systemie Windows XP, aby zmienić typ systemu plików z FAT32 na NTFS, należy użyć programu

Aby przekształcić zeskanowany obraz na tekst, należy użyć oprogramowania, które stosuje techniki

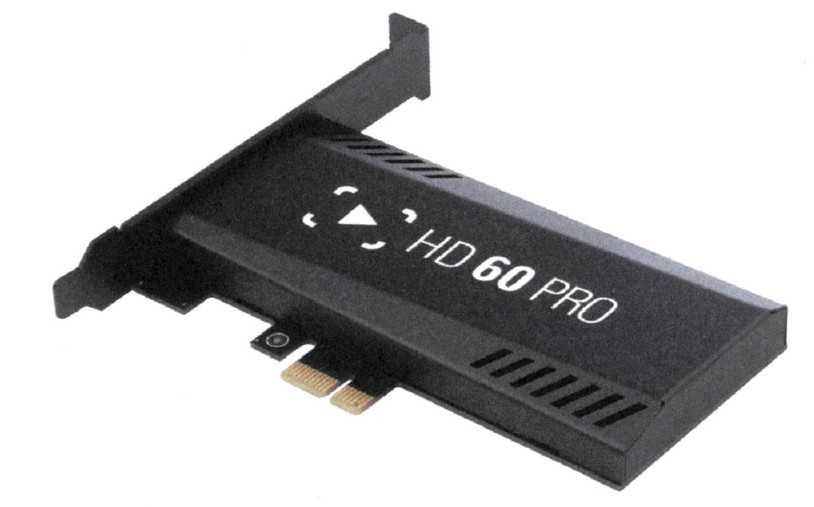

Karta do przechwytywania wideo, która została przedstawiona, będzie kompatybilna z płytą główną posiadającą port

Cechą oprogramowania służącego do monitorowania zdarzeń metodą Out-Of-Band w urządzeniach sieciowych jest

W systemie Windows, który wspiera przydziały dyskowe, użytkownik o nazwie Gość

Atak DDoS (z ang. Distributed Denial of Service) na serwer może spowodować

Impulsator pozwala na testowanie uszkodzonych systemów logicznych w komputerze, między innymi poprzez

Jakie będzie rezultatem dodawania liczb 10011012 i 110012 w systemie binarnym?

Jakiego systemu plików powinno się użyć podczas instalacji dystrybucji Linux?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jaki element sieci SIP określamy jako telefon IP?

Jakim protokołem posługujemy się do przesyłania dokumentów hipertekstowych?

W systemie Linux uruchomiono skrypt z czterema argumentami. Jak można uzyskać dostęp do listy wszystkich wartości w skrypcie?

Kabel pokazany na ilustracji może być zastosowany do realizacji okablowania sieci o standardzie

Zintegrowana karta sieciowa na płycie głównej uległa awarii. Komputer nie może załadować systemu operacyjnego, ponieważ brakuje zarówno dysku twardego, jak i napędów optycznych, a system operacyjny jest uruchamiany z lokalnej sieci. W celu przywrócenia utraconej funkcjonalności, należy zainstalować w komputerze

Jakie znaczenie mają zwory na dyskach z interfejsem IDE?

/dev/sda: Czas odczytu z pamięci podręcznej: 18100 MB w 2.00 sekundy = 9056.95 MB/sek. Przedstawiony wynik wykonania polecenia systemu Linux jest używany do diagnostyki