Pytanie 1

Jakie oprogramowanie służy do sprawdzania sterowników w systemie Windows?

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Jakie oprogramowanie służy do sprawdzania sterowników w systemie Windows?

Jakie polecenie w systemie Linux nie pozwala na diagnozowanie sprzętu komputerowego?

Który z poniższych adresów IPv4 wraz z prefiksem reprezentuje adres sieci?

Urządzenie sieciowe, które umożliwia połączenie pięciu komputerów w tej samej sieci, eliminując kolizje pakietów, to

Licencja na Office 365 PL Personal (na 1 stanowisko, subskrypcja na 1 rok) ESD jest przypisana do

Aby zwiększyć lub zmniejszyć wielkość ikony na pulpicie, należy obracać kółkiem myszy, trzymając jednocześnie klawisz:

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Norma IEEE 802.11 określa typy sieci

Który z poniższych systemów operacyjnych jest systemem typu open-source?

Notacja #102816 oznacza zapis w systemie liczbowym

Które z metod szyfrowania wykorzystywanych w sieciach bezprzewodowych jest najsłabiej zabezpieczone przed łamaniem haseł?

Jakie urządzenie stosuje technikę polegającą na wykrywaniu zmian w pojemności elektrycznej podczas manipulacji kursorem na monitorze?

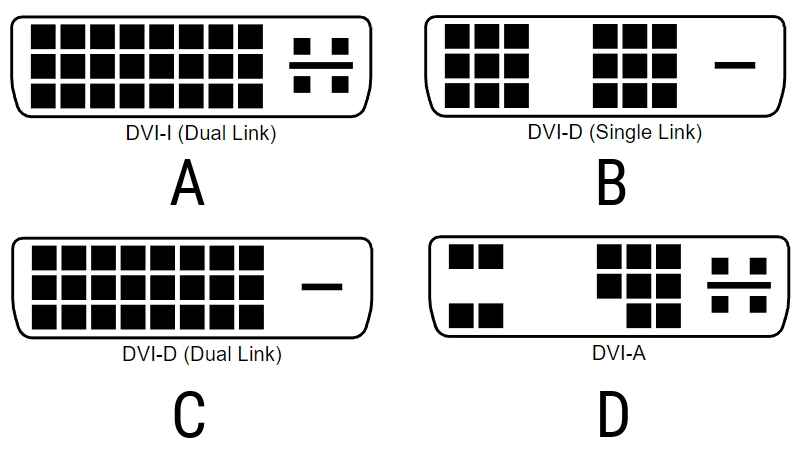

Który standard złącza DVI pozwala na przesyłanie jedynie sygnału analogowego?

Jakie urządzenie powinno być użyte w sieci Ethernet, aby zredukować liczbę kolizji pakietów?

Jaka jest prędkość przesyłania danych w standardzie 1000Base-T?

Jakiego materiału używa się w drukarkach tekstylnych?

W systemie Linux narzędzie fsck służy do

ping 192.168.11.3 Jaką komendę należy wpisać w miejsce kropek, aby w systemie Linux wydłużyć domyślny odstęp czasowy między pakietami podczas używania polecenia ping?

Jaką nazwę powinien mieć identyfikator, aby urządzenia w sieci mogły działać w danej sieci bezprzewodowej?

Aby zapewnić możliwość odzyskania ważnych danych, należy regularnie

Usługa odpowiedzialna za konwersję nazw domen na adresy sieciowe to

Strategia zapisywania kopii zapasowych ukazana na diagramie określana jest mianem

| Day | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | 11 | 12 | 13 | 14 | 15 | 16 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Media Set | A | A | A | A | A | A | A | A | ||||||||

| B | B | B | B | |||||||||||||

| C | C | C | ||||||||||||||

| E |

W systemie Windows odpowiednikiem macierzy RAID 1 jest wolumin o nazwie

Jaki zakres adresów IPv4 jest prawidłowo przypisany do danej klasy?

Ile bitów trzeba wydzielić z części hosta, aby z sieci o adresie IPv4 170.16.0.0/16 utworzyć 24 podsieci?

Gdzie w dokumencie tekstowym Word umieszczony jest nagłówek oraz stopka?

Ile urządzeń jest w stanie współpracować z portem IEEE1394?

Rekord startowy dysku twardego w komputerze to

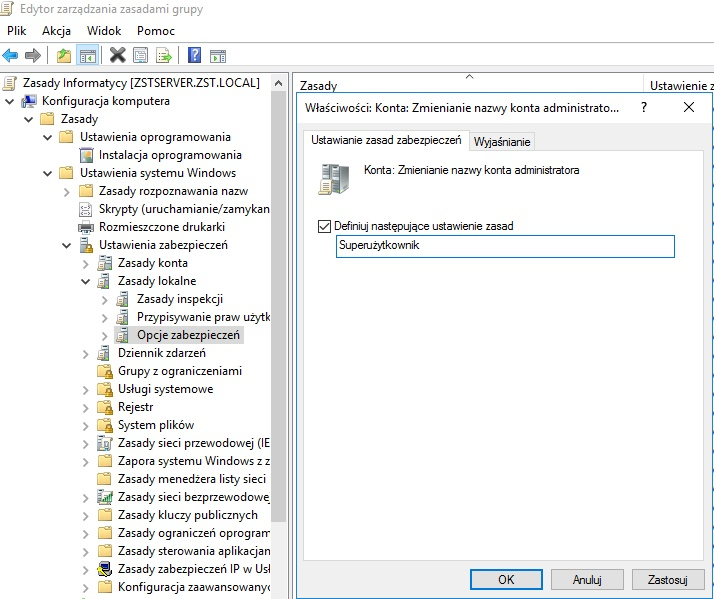

Rezultatem działania przedstawionego na ilustracji okna jest

Ile par kabli jest używanych w standardzie 100Base-TX do obustronnej transmisji danych?

Aby uzyskać wyświetlenie podanych informacji o systemie Linux w terminalu, należy skorzystać z komendy

W systemie Linux plik posiada uprawnienia ustawione na 541. Właściciel ma możliwość pliku

Aby wyjąć dysk twardy zamocowany w laptopie przy użyciu podanych śrub, najlepiej zastosować wkrętak typu

W doborze zasilacza do komputera kluczowe znaczenie

Jaką topologię fizyczną sieci komputerowej przedstawia załączony rysunek?

Który z protokołów umożliwia bezpieczne połączenie klienta z zachowaniem anonimowości z witryną internetową banku?

W architekturze sieci lokalnych opartej na modelu klient-serwer

Jaką liczbę warstw określa model ISO/OSI?

Jakie polecenie w systemach Linux służy do przedstawienia konfiguracji interfejsów sieciowych?

Wskaż błędny sposób podziału dysku MBR na partycje?