Pytanie 1

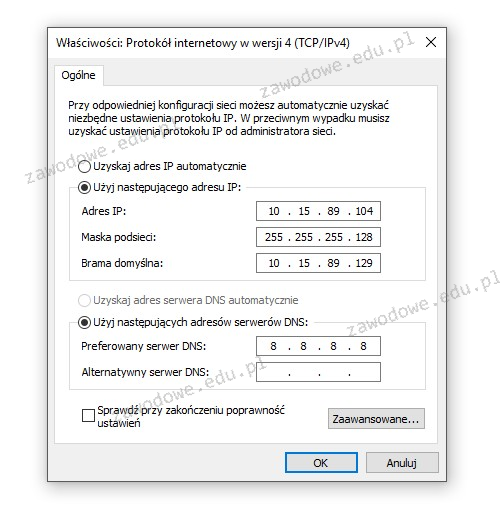

Na rysunku przedstawiono ustawienia karty sieciowej urządzenia z adresem IP 10.15.89.104/25. Co z tego wynika?

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Na rysunku przedstawiono ustawienia karty sieciowej urządzenia z adresem IP 10.15.89.104/25. Co z tego wynika?

Na ilustracji pokazano tylną część panelu

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie urządzenie umożliwia zwiększenie zasięgu sieci bezprzewodowej?

Ile liczb w systemie szesnastkowym jest wymaganych do zapisania pełnej formy adresu IPv6?

Aby możliwe było przekierowanie drukowanego dokumentu na dysk twardy, należy w opcjach konfiguracyjnych drukarki wybrać drukowanie do portu

Aby poprawić organizację plików na dysku i przyspieszyć działanie systemu, co należy zrobić?

W którym programie należy zmodyfikować ustawienia, aby użytkownik komputera mógł wybrać z menu i uruchomić jeden z kilku systemów operacyjnych zainstalowanych na jego komputerze?

Który z poniższych elementów jest częścią mechanizmu drukarki atramentowej?

Aby odzyskać dane ze sformatowanego dysku twardego, należy wykorzystać program

Ile warstw zawiera model ISO/OSI?

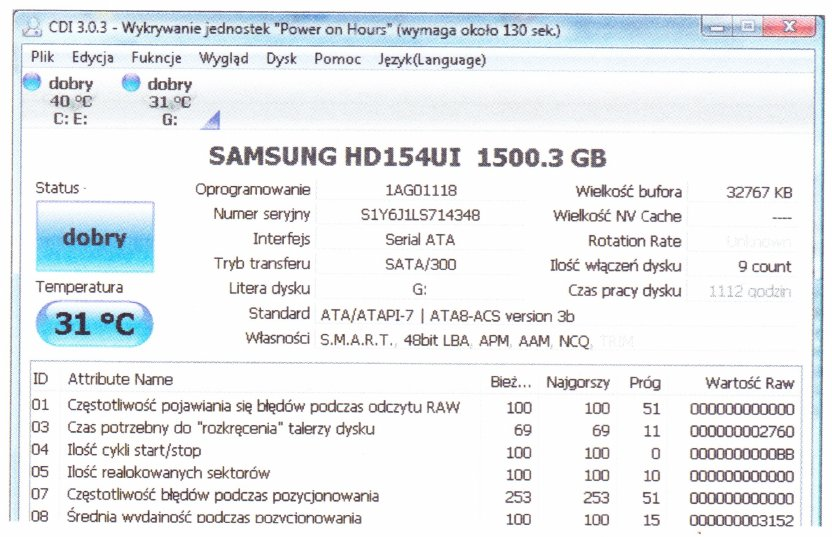

Zjawiskiem typowym, które może świadczyć o nadchodzącej awarii twardego dysku, jest wystąpienie

Który typ macierzy RAID zapewnia tzw. mirroring dysków?

Jaka usługa musi być aktywna na serwerze, aby stacja robocza mogła automatycznie uzyskać adres IP?

Która z poniższych topologii sieciowych charakteryzuje się centralnym węzłem, do którego podłączone są wszystkie inne urządzenia?

W tabeli przedstawiono numery podzespołów, które są ze sobą kompatybilne

| Lp. | Podzespół | Parametry |

|---|---|---|

| 1. | Procesor | INTEL COREi3-4350- 3.60 GHz, x2/4, 4 MB, 54W, HD 4600, BOX, s-1150 |

| 2. | Procesor | AMD Ryzen 7 1800X, 3.60 GHz, 95W, s-AM4 |

| 3. | Płyta główna | GIGABYTE ATX, X99, 4x DDR3, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8 x USB 2.0, S-AM3+ |

| 4. | Płyta główna | Asus CROSSHAIR VI HERO, X370, SATA3, 4xDDR4, USB3.1, ATX, WI-FI AC, s- AM4 |

| 5. | Pamięć RAM | Corsair Vengeance LPX, DDR4 2x16GB, 3000MHz, CL15 black |

| 6. | Pamięć RAM | Crucial Ballistix DDR3, 2x8GB, 1600MHz, CL9, black |

Co jest przyczyną wysokiego poziomu przesłuchu zdalnego w kablu?

Jakie są różnice pomiędzy poleceniem ps a poleceniem top w systemie Linux?

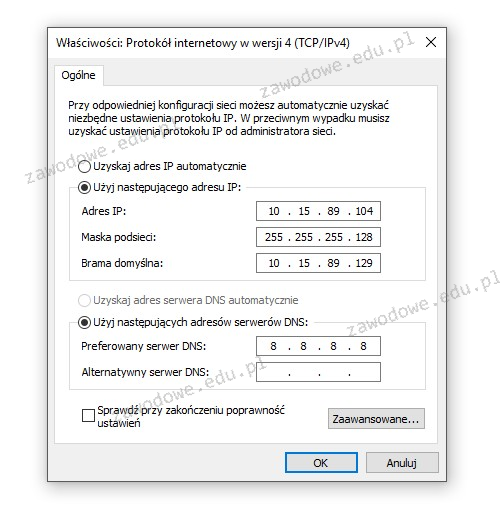

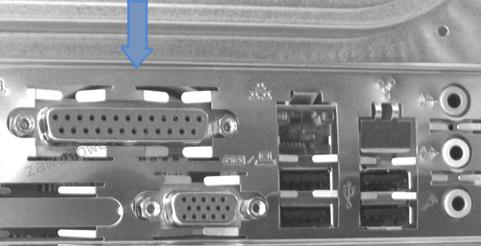

Jaki port na tylnym panelu płyty głównej jest w dokumentacji określany jako port zgodny z normą RS232C?

W dokumentacji płyty głównej znajduje się informacja "Wsparcie dla S/PDIF Out". Co to oznacza w kontekście tej płyty głównej?

IMAP jest protokołem do

Płyta główna z gniazdem G2 będzie kompatybilna z procesorem

Urządzenie komputerowe, które powinno być koniecznie podłączone do zasilania za pomocą UPS, to

Aby przeprowadzić instalację systemu operacyjnego z rodziny Windows na stacjach roboczych, konieczne jest dodanie na serwerze usług

Usługa, która odpowiada za przekształcanie nazw domenowych na adresy IP, to

Jaką liczbę komórek pamięci można bezpośrednio zaadresować w 64-bitowym procesorze z 32-bitową szyną adresową?

Jakie polecenie w systemie Windows przeznaczonym dla stacji roboczej umożliwia ustalenie wymagań logowania dla wszystkich użytkowników tej stacji?

Na ilustracji, strzałka wskazuje na złącze interfejsu

Aby zweryfikować integralność systemu plików w systemie Linux, które polecenie powinno zostać użyte?

Która przystawka MMC systemu Windows umożliwia przegląd systemowego Dziennika zdarzeń?

Dobrze zaplanowana sieć komputerowa powinna pozwalać na rozbudowę, co oznacza, że musi charakteryzować się

Jaką maksymalną liczbę kanałów z dostępnego pasma kanałów standardu 802.11b można stosować w Polsce?

Jakie narzędzie powinno się wykorzystać w systemie Windows, aby uzyskać informacje o problemach z systemem?

Jakie informacje można uzyskać dzięki programowi Wireshark?

Który adres IP posiada maskę w postaci pełnej, zgodną z klasą adresu?

Na ilustracji zaprezentowano system monitorujący

Zgodnie z aktualnymi przepisami BHP, odległość oczu od ekranu monitora powinna wynosić

Oprogramowanie OEM (Original Equipment Manufacturer) jest przypisane do

Licencja grupowa na oprogramowanie Microsoft należy do typu

Zakres operacji we/wy dla kontrolera DMA w notacji heksadecymalnej wynosi 0094-009F, a w systemie dziesiętnym?