Pytanie 1

Komenda systemowa ipconfig pozwala na konfigurację

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Komenda systemowa ipconfig pozwala na konfigurację

Podstawowym zadaniem mechanizmu Plug and Play jest

Który z parametrów należy użyć w poleceniu netstat, aby uzyskać statystyki interfejsu sieciowego dotyczące liczby przesłanych oraz odebranych bajtów i pakietów?

Partycja, na której zainstalowany jest system operacyjny, określana jest jako partycja

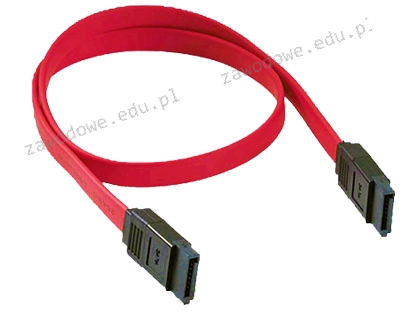

Na ilustracji przedstawiono przewód z wtykami

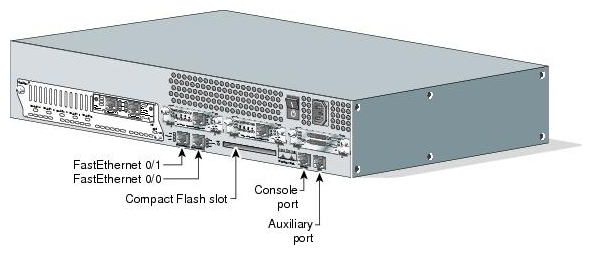

Urządzenie sieciowe, które widoczna jest na ilustracji, to

W systemie Linux komenda chmod pozwala na

Zgodnie z normą 802.3u technologia sieci FastEthernet 100Base-FX stosuje

Aktywacja opcji OCR podczas ustawiania skanera umożliwia

Dostosowywanie parametrów TCP/IP hosta w oparciu o adres MAC karty sieciowej to funkcjonalność jakiego protokołu?

Początkowe znaki heksadecymalne adresu IPv6 przeznaczonego do link-local to

Reprezentacja koloru RGB(255, 170, 129) odpowiada formatowi

Najefektywniejszym zabezpieczeniem danych firmy, której siedziby znajdują się w różnych, odległych od siebie lokalizacjach, jest zastosowanie

Użytkownik napotyka trudności z uruchomieniem systemu Windows. W celu rozwiązania tego problemu skorzystał z narzędzia System Image Recovery, które

Jakie zadanie pełni router?

Relacja między ładunkiem zmagazynowanym na przewodniku a potencjałem tego przewodnika wskazuje na jego

Aby skonfigurować wolumin RAID 5 na serwerze, wymagane jest minimum

Sieć 192.200.100.0 z maską 255.255.255.128 podzielono na 4 równe podsieci. Ile maksymalnie adresów hostów jest dostępnych w każdej podsieci?

Jakiej klasy adresów IPv4 dotyczą adresy, które mają dwa najbardziej znaczące bity ustawione na 10?

W którym modelu płyty głównej można zamontować procesor o podanych parametrach?

| Intel Core i7-4790 3,6 GHz 8MB cache s. 1150 Box |

Symbol graficzny przedstawiony na ilustracji oznacza jaką bramkę logiczną?

Jakie składniki systemu komputerowego muszą być usuwane w wyspecjalizowanych zakładach przetwarzania ze względu na obecność niebezpiecznych substancji lub chemicznych pierwiastków?

Symbol błyskawicy pokazany na rysunku jest używany do oznaczania złącza

Podstawowy protokół stosowany do ustalania ścieżki oraz przesyłania pakietów danych w sieci komputerowej to

Co się stanie, jeśli w systemie operacyjnym komputera zainstalowany zostanie program określany jako Trojan?

Aby monitorować stan dysków twardych w serwerach, komputerach osobistych i laptopach, można użyć programu

Do jakiej grupy w systemie Windows Server 2008 powinien być przypisany użytkownik odpowiedzialny wyłącznie za archiwizację danych przechowywanych na serwerowym dysku?

Wykonanie komendy perfmon w konsoli systemu Windows spowoduje

Jakie polecenie w systemie Windows służy do monitorowania bieżących połączeń sieciowych?

Jakie ustawienie należy wprowadzić przy konfiguracji serwera DHCP?

Zestaw komputerowy, który został przedstawiony, jest niepełny. Który z elementów nie został wymieniony w tabeli, a jest kluczowy dla prawidłowego funkcjonowania zestawu?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Zalman Obudowa R1 Midi Tower bez PSU, USB 3.0 |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, BOX |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Jakie medium transmisyjne w sieciach LAN rekomenduje się do użycia w historycznych obiektach?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Do jednoczesnej zmiany tła pulpitu, kolorów okien, dźwięków oraz wygaszacza ekranu na komputerze z zainstalowanym systemem Windows należy wykorzystać

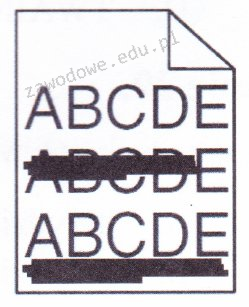

Co może być przyczyną problemów z wydrukiem z drukarki laserowej przedstawionych na ilustracji?

Wykonanie komendy NET USER GRACZ * /ADD w wierszu poleceń systemu Windows spowoduje

Cena wydrukowania jednej strony tekstu to 95 gr, a koszt przygotowania jednej płyty CD wynosi 1,54 zł. Jakie wydatki poniesie firma, tworząca płytę z prezentacjami oraz 120-stronicowy poradnik?

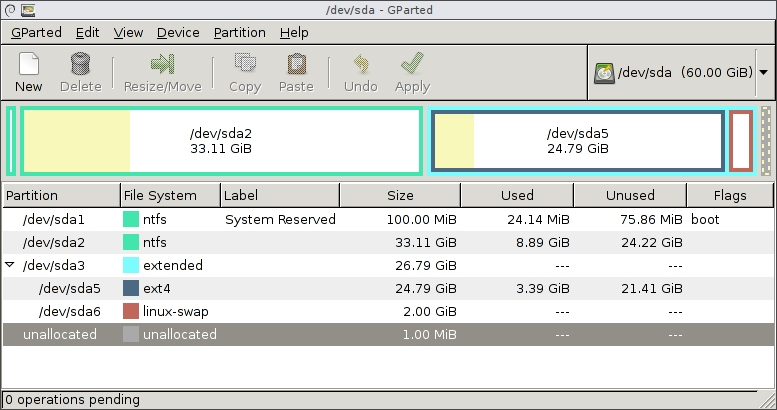

Badanie danych przedstawionych przez program umożliwia dojście do wniosku, że

Awaria drukarki igłowej może być spowodowana uszkodzeniem

Kabel sieciowy z końcówkami RJ45 był testowany za pomocą diodowego urządzenia do sprawdzania okablowania. Na tym urządzeniu diody LED włączały się po kolei, z wyjątkiem diod oznaczonych numerami 2 i 3, które świeciły jednocześnie na jednostce głównej testera, natomiast nie świeciły na jednostce zdalnej. Jaka była tego przyczyna?