Pytanie 1

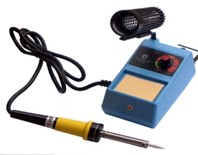

Przedstawione narzędzie jest przeznaczone do

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Przedstawione narzędzie jest przeznaczone do

Które polecenie w systemie Linux służy do zakończenia procesu?

Jaki procesor powinien być zastosowany podczas składania komputera stacjonarnego opartego na płycie głównej Asus M5A78L-M/USB3 AMD760G socket AM3+?

Aby stworzyć bezpieczny wirtualny tunel pomiędzy dwoma komputerami korzystającymi z Internetu, należy użyć technologii

Która z kopii w trakcie archiwizacji plików pozostawia ślad archiwizacji?

Pierwsze trzy bity adresu IP w formacie binarnym mają wartość 010. Jaką klasę reprezentuje ten adres?

Który z wewnętrznych protokołów routingu bazuje na metodzie wektora odległości?

W systemie Windows można zweryfikować parametry karty graficznej, używając następującego polecenia

Jakie zabezpieczenie w dokumentacji technicznej określa mechanizm zasilacza komputerowego zapobiegający przegrzaniu urządzenia?

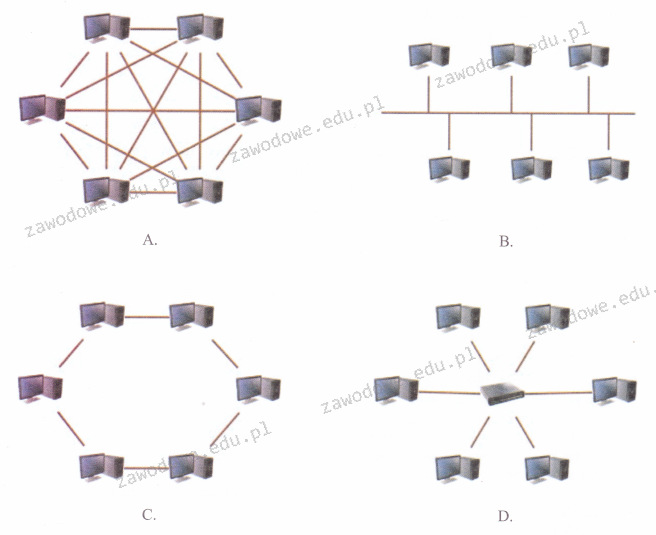

Która z zaprezentowanych na rysunkach topologii odpowiada topologii siatki?

Który z portów znajdujących się na tylnej części komputera jest oznaczony podanym symbolem?

Menedżer urządzeń w systemie Windows pozwala na wykrycie

Najlepszą metodą ochrony danych przedsiębiorstwa, którego biura znajdują się w różnych, odległych miejscach, jest wdrożenie

Które narzędzie należy wykorzystać do uzyskania wyników testu POST dla modułów płyty głównej?

Sygnatura (ciąg bitów) 55AA (w systemie szesnastkowym) kończy tablicę partycji. Jaka jest odpowiadająca jej wartość w systemie binarnym?

Jakie narzędzie służy do obserwacji zdarzeń w systemie Windows?

Jaką maksymalną liczbę adresów można przypisać urządzeniom w sieci 10.0.0.0/22?

Wskaż nazwę programu stosowanego w systemie Linux do przekrojowego monitorowania parametrów, między innymi takich jak obciążenie sieci, zajętość systemu plików, statystyki partycji, obciążenie CPU czy statystyki IO.

Jakie polecenie w systemie Linux pokazuje czas działania systemu oraz jego średnie obciążenie?

W jakim urządzeniu elektronicznym znajduje się układ RAMDAC?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Oprogramowanie OEM (Original Equipment Manufacturer) jest związane z

Standard IEEE 802.11 określa typy sieci

Główną czynnością serwisową w drukarce igłowej jest zmiana pojemnika

Jakie urządzenie wskazujące działa na podstawie zmian pojemności elektrycznej?

Według modelu TCP/IP protokoły DNS, FTP i SMTP są przypisane do warstwy

Podstawowym zadaniem mechanizmu Plug and Play jest:

Jakie polecenie powinno być użyte do obserwacji lokalnych połączeń?

Urządzeniem wejściowym komputera, realizującym z najwyższą precyzją funkcje wskazujące w środowisku graficznym 3D, jest

Na dysku obok systemu Windows zainstalowano system Linux Ubuntu. W celu ustawienia kolejności uruchamiania systemów operacyjnych, konieczna jest modyfikacja zawartości

Komenda "mmc" w systemach Windows 2000 oraz Windows XP uruchamia aplikację do tworzenia, zapisywania i otwierania

Wyjście audio dla słuchawek lub głośników minijack na karcie dźwiękowej oznaczone jest jakim kolorem?

Aby podłączyć 6 komputerów do sieci przy użyciu światłowodu, potrzebny jest kabel z co najmniej taką ilością włókien:

Komunikat "BIOS checksum error" pojawiający się w trakcie startu komputera zazwyczaj wskazuje na

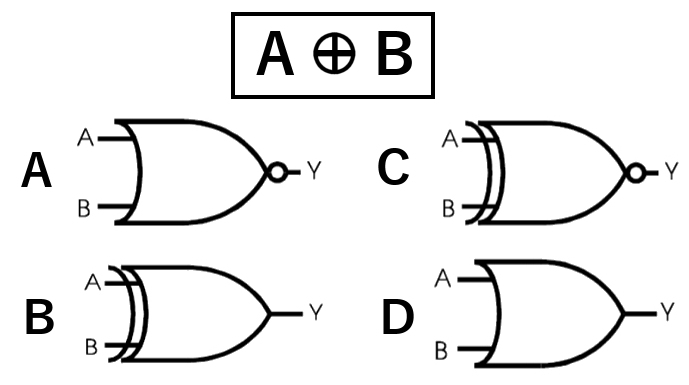

Jaką bramkę logiczną reprezentuje to wyrażenie?

Jaka jest maska dla adresu IP 192.168.1.10/8?

Jak można skonfigurować interfejs sieciowy w systemie Linux, modyfikując plik

Bezpośrednio po usunięciu istotnych plików z dysku twardego, użytkownik powinien

Jaką cechę posiada przełącznik sieciowy?

Polecenie uname -s w systemie Linux służy do identyfikacji