Pytanie 1

Na zdjęciu przedstawiono

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Na zdjęciu przedstawiono

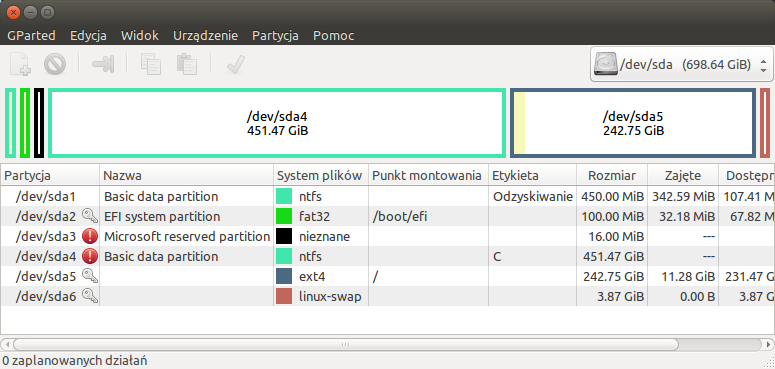

Które systemy operacyjne mogą być zainstalowane na dysku, którego działanie obrazuje GParted?

W celu przerwania działania funkcji i powrotu do miejsca jej wywołania należy użyć instrukcji

Do badania przewodnictwa powietrznego i kostnego służy

Jakie jest przeznaczenie drukarki, której dotyczy zamieszczony fragment specyfikacji?

| Głowica drukująca | 24-igłowa |

| Średnica przewodu | 0,2 mm |

| Kierunek druku | Dwukierunkowe/bezkierunkowe drukowanie |

| Rozdzielczość grafiki | Maks. 360 (wys.) x 360 (szer.) dpi |

| Szybkość drukowania | High Speed Draft: 607 znaków/s, tryb Utility: 485 znaków/s, tryb Near Letter Quality: 245 znaków/s, Letter Quality: 165 znaków/s |

| Gęstość przesunięć wierszy | 4,23 mm (1/6"), 3,18 mm (1/8"), n x 0,42 mm (m/60") (m=0-127), n x 0,14 mm (n/180") (n=0-255), n x 0,12 mm (n/216") (n=0-255), n x 0,07 mm (n/360") (n=0-255) |

| Szybkość podajnika | 10 cali na sekundę |

| Pobieranie papieru | Ręczne (góra), traktor pchający (góra), traktor pchający (tył), traktor pchający (dół), podajnik pojedynczych arkuszy (tył) |

| Gęstość znaków | High Speed Draft: 10,0 zn./cal 18,0 zn./cal Jakość użytkowa: 10,0 zn./cal 12,0 zn./cal 15,0 zn./cal 17,1 zn./cal 20 zn./cal Tryb Near Letter Quality: 10,0 zn./cal 12,0 zn./cal 15,0 zn./cal 17,1 zn./cal 20,0 zn./cal Tryb Letter Quality: 10 zn./cal 12 zn./cal 15 zn./cal 17,1 zn./cal 20 zn./cal, proporcjonalnie |

| Szerokość druku | 136 zn./linia przy ANK 10 zn./cal |

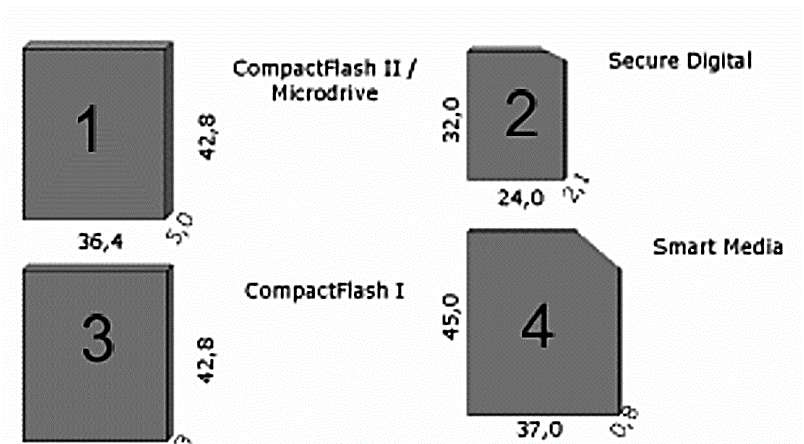

W aparacie holterowskim sygnał jest archiwizowany na karcie SD. Który rysunek przedstawia wymieniony nośnik pamięci?

Proces, w którym w bazie danych są usuwane nadmiarowe dane, jest określany jako

Które badanie endoskopowe należy wykorzystać do wizualizacji jamy stawu?

Rejestr rozkazów procesora przechowuje

Która część narządu wzroku rejestruje światło widzialne?

Pierwszym krokiem podczas prac serwisowych wymagających modyfikowania rejestru w systemie Windows jest wykonanie

Zapis w dokumentacji układu holterowskiego „metoda pomiaru – oscylometryczna” świadczy o możliwości monitorowania

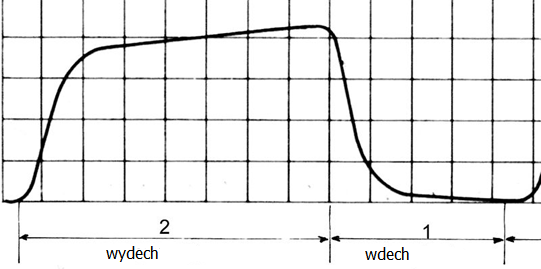

Stężenie którego gazu z wydychanego powietrza prezentuje kapnogram?

Aby dodać nowe konto „rejestracja” w systemie Windows, należy wykorzystać polecenie

W celu podłączenia monitora do systemu wizualizacji obrazów wymagany jest interfejs Display Port. Ile takich interfejsów posiada karta graficzna przedstawiona na rysunku?

Symbole: 1U, 2U, 3U stosowane do oznaczenia modułów w szafach typu rack określają

Membrana półprzepuszczalna jest podstawowym elementem

Na zdjęciu RTG najjaśniejsze pole stanowi tkanka kostna, przez którą promieniowanie rentgenowskie jest

Programowanie obiektowe wykorzystuje dziedziczenie, które polega na

Przedstawiony fragment dokumentacji dotyczy

Częstotliwość: 2.0-10.0MHz; Tryb obrazowania: B, B/B, B/M, M, 4B; Dynamiczne 4-stopniowe ogniskowanie; |

Który z nośników danych umożliwia wielokrotny zapis i ma największą pojemność?

Operacje stałoprzecinkowe w procesorze wykonuje jednostka oznaczona jako

W celu wyszukania błędów w programie wykorzystuje się

Podczas wymiany podzespołów elektronicznych czułych na wyładowania elektrostatyczne należy zastosować

Który zasilacz pozwala na tymczasowe utrzymanie zasilania akumulatorowego w razie braku zasilania sieciowego?

Operacja warunkowa w większości języków programowania wysokiego poziomu zaczyna się słowem

Procesor GPU jest odpowiedzialny za wykonywanie operacji obliczeniowych w karcie

Który podzespół komputerowy posiada obudowę o zamieszczonej specyfikacji?

| Specyfikacja obudowy | |

|---|---|

| Obsługiwane gniazda | LGA775 |

| TCASE | 71,4°C |

| Wymiary obudowy | 37,5 mm x 37,5 mm |

| Rozmiar płytki półprzewodnikowej | 214 mm² |

| Liczba tranzystorów płytki półprzewodnikowej | 820 milion |

| Dostępne opcje obniżonej zawartości halogenków | Patrz MDDS |

Sterowniki klawiatury, magistral i przerwań są elementami

Aby zainstalować brakujące oprogramowanie w systemie z rodziny Linux należy wykorzystać polecenie

Ilość jodu-131 podana pacjentowi w terapii tarczycy zmniejszy się o połowę po

Jakiego typu papier należy zastosować w aparacie elektrokardiograficznym?

Jak nazywa się terapia stosowana w przypadku niewydolności nerek, polegająca na oczyszczaniu krwi ze zbędnych składników przemiany materii?

Pod wpływem bodźca świetlnego, dźwiękowego lub czuciowego mózg generuje elektryczne potencjały wywołane rejestrowane przez

Podczas pracy z układami elektronicznymi CMOS na stanowisku montażowym należy stosować

W dokumentacji sieci centralnego monitoringu zapisano, że sieć jest wykonana w standardzie 802.11 Do montażu takiej sieci są wymagane urządzenia wykorzystujące

Technologia dual channel dotyczy pracy dwóch takich samych

Jaką funkcję pełni przedstawiona na rysunku procedura BIOS?

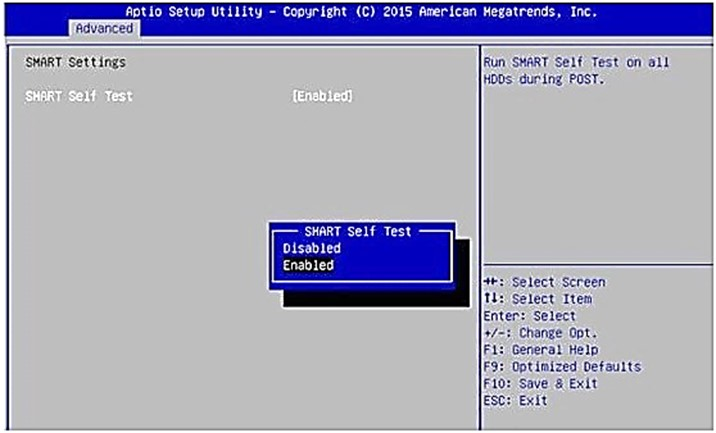

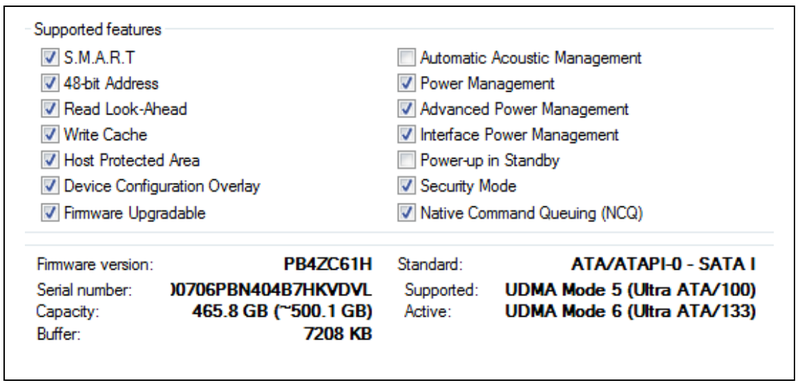

Przedstawiony zrzut ekranu prezentuje parametry

Pod wpływem zwiększenia natężenia promieniowania widzialnego (bodźca świetlnego) źrenica zdrowego oka ludzkiego