Pytanie 1

Liczba szesnastkowa 1E2F₍₁₆₎ zapisana w systemie ósemkowym ma postać

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Liczba szesnastkowa 1E2F₍₁₆₎ zapisana w systemie ósemkowym ma postać

Narzędziem służącym do tworzenia logicznych podziałów na dysku twardym w systemie GNU/Linux jest

W systemie Windows po wykonaniu polecenia systeminfo nie otrzyma się informacji o

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

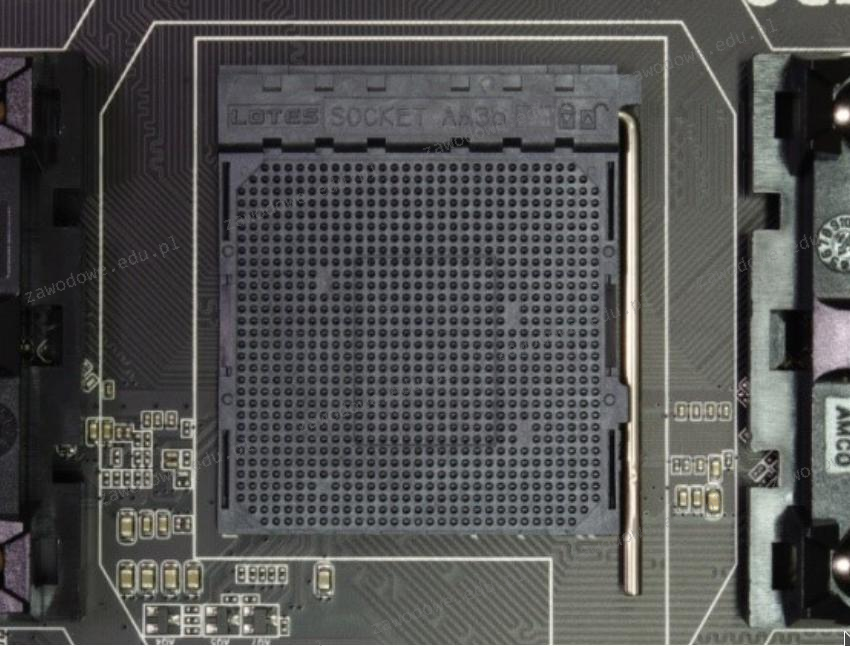

Na płycie głównej z gniazdem pokazanym na fotografii możliwe jest zainstalowanie procesora

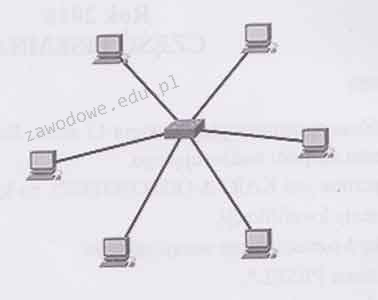

Schemat ilustruje fizyczną strukturę

W systemie Windows ochrona polegająca na ostrzeganiu przed uruchomieniem nierozpoznanych aplikacji i plików pobranych z Internetu jest realizowana przez

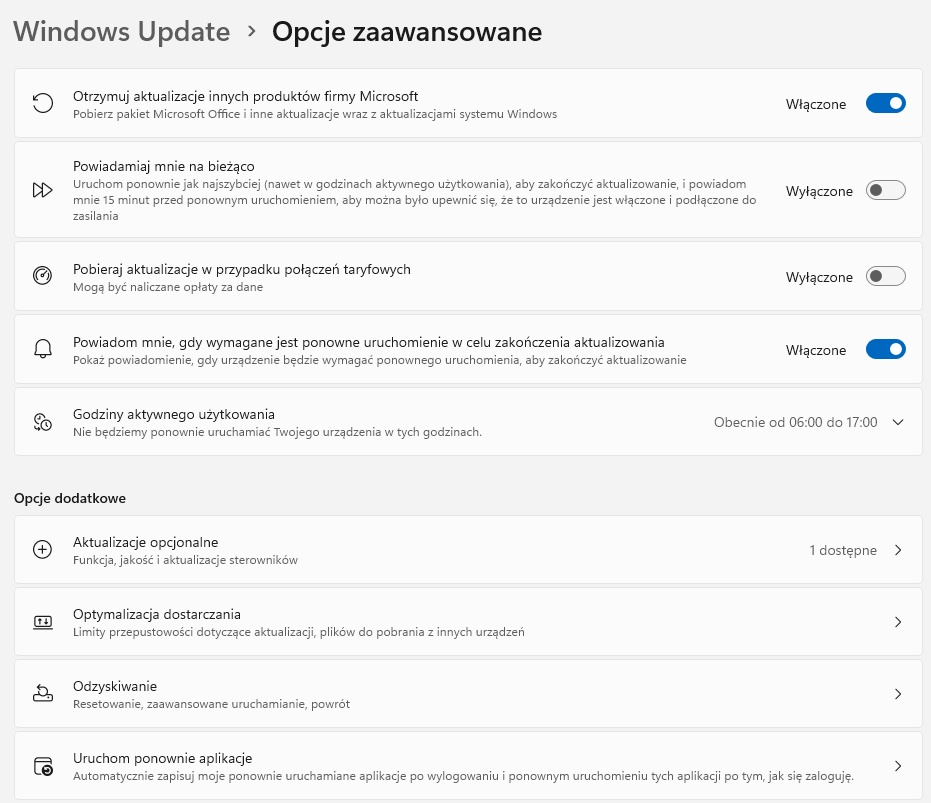

Biorąc pod uwagę konfigurację wykonywaną na ilustracji, administrator po zainstalowaniu systemu operacyjnego uznał za istotne, aby

Gniazdo na tablicy interaktywnej jest oznaczone tym symbolem. Które złącze powinno być wykorzystane do połączenia tablicy z komputerem?

Aby procesor działał poprawnie, konieczne jest podłączenie złącza zasilania 4-stykowego lub 8-stykowego o napięciu

Który adres IP jest najwyższy w sieci 196.10.20.0/26?

Które z poniższych stwierdzeń odnosi się do sieci P2P - peer to peer?

Wysyłanie żetonu (ang. token) występuje w sieci o fizycznej strukturze

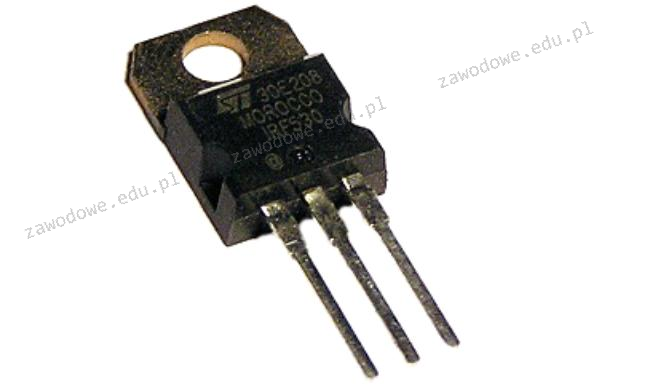

Element elektroniczny przedstawiony na ilustracji to

Firma Dyn, której serwery DNS zostały zaatakowane, przyznała, że część tego ataku … miała miejsce z użyciem różnych urządzeń podłączonych do sieci. Ekosystem kamer, czujników i kontrolerów określany ogólnie jako 'Internet rzeczy' został wykorzystany przez cyberprzestępców jako botnet − sieć maszyn-zombie. Jakiego rodzaju atak jest opisany w tym cytacie?

Jeśli jednostka alokacji ma 1024 bajty, to pliki podane w tabeli zajmują na dysku:

Nazwa Wielkość

Ala.exe 50B

Dom.bat 1024B

Wirus.exe 2kB

Domes.exr 350B

W skład sieci komputerowej wchodzi 3 komputery stacjonarne oraz drukarka sieciowa, które są połączone kablem UTP z routerem mającym porty 1 x WAN oraz 5 x LAN. Które urządzenie sieciowe pozwoli na dołączenie kablem UTP dwóch dodatkowych komputerów do tej sieci?

Przedstawiona na diagramie strategia zapisu kopii zapasowych na nośnikach nosi nazwę

| Day | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | 11 | 12 | 13 | 14 | 15 | 16 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Media Set | A | A | A | A | A | A | A | A | ||||||||

| B | B | B | B | |||||||||||||

| C | C | C | ||||||||||||||

| E |

Emisja przez BIOS firmy AMI jednego długiego oraz dwóch krótkich sygnałów dźwiękowych oznacza

Jaką usługę trzeba zainstalować na serwerze, aby umożliwić korzystanie z nazw domen?

Domyślnie dostęp anonimowy do zasobów serwera FTP umożliwia

Jaką liczbę komórek pamięci można bezpośrednio zaadresować w 64-bitowym procesorze z 32-bitową szyną adresową?

Do przeprowadzenia aktualizacji systemu Windows służy polecenie

Równoległy interfejs, w którym magistrala składa się z 8 linii danych, 4 linii sterujących oraz 5 linii statusowych, nie zawiera linii zasilających i umożliwia transmisję na odległość do 5 metrów, pod warunkiem, że przewody sygnałowe są skręcane z przewodami masy; w przeciwnym razie limit wynosi 2 metry, nazywa się

Na płycie głównej doszło do awarii zintegrowanej karty sieciowej. Komputer nie ma dysku twardego ani innych napędów, takich jak stacja dysków czy CD-ROM. Klient informuje, że w sieci firmowej komputery nie mają napędów, a wszystko "czyta" się z serwera. Aby przywrócić utraconą funkcjonalność, należy zainstalować

Jakie urządzenie powinno być użyte, aby poprawić zasięg sieci bezprzewodowej w obiekcie?

Narzędzie służące do oceny wydajności systemu komputerowego to

Aby komputer osobisty współpracował z urządzeniami korzystającymi z przedstawionych na rysunku złącz, należy wyposażyć go w interfejs

W załączonej ramce przedstawiono opis technologii

| Technologia ta to rewolucyjna i nowatorska platforma, która pozwala na inteligentne skalowanie wydajności podsystemu graficznego poprzez łączenie mocy kilku kart graficznych NVIDIA pracujących na płycie głównej. Dzięki wykorzystaniu zastrzeżonych algorytmów oraz wbudowanej w każdy z procesorów graficznych NVIDIA dedykowanej logiki sterującej, która odpowiada za skalowanie wydajności, technologia ta zapewnia do 2 razy (w przypadku dwóch kart) lub 2,8 razy (w przypadku trzech kart) wyższą wydajność niż w przypadku korzystania z pojedynczej karty graficznej. |

Wskaż ilustrację obrazującą typowy materiał eksploatacyjny używany w drukarkach żelowych?

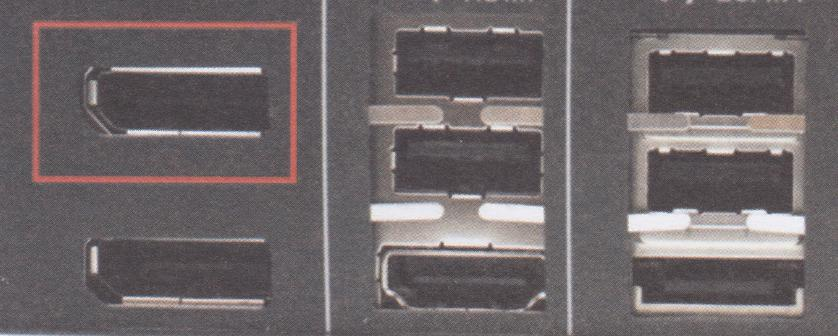

Na ilustracji, złącze monitora zaznaczone czerwoną ramką, będzie kompatybilne z płytą główną, która ma interfejs

Ile minimalnie pamięci RAM powinien mieć komputer, aby możliwe było uruchomienie 32-bitowego systemu operacyjnego Windows 7 w trybie graficznym?

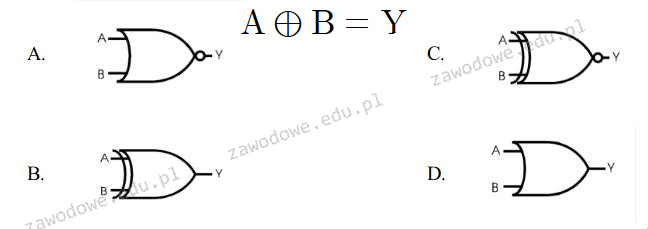

Jaką bramkę logiczną reprezentuje to wyrażenie?

Shareware to typ licencji, który opiera się na

W jaki sposób skonfigurować zaporę Windows, aby spełniała zasady bezpieczeństwa i umożliwiała użycie polecenia ping do weryfikacji komunikacji z innymi urządzeniami w sieci?

Zastosowanie której zasady zwiększy bezpieczeństwo podczas korzystania z portali społecznościowych?

Na podstawie danych z "Właściwości systemu" można stwierdzić, że na komputerze zainstalowano fizycznie pamięć RAM o pojemności

| Komputer: Intel(R) Pentium (R)4 CPU 1.8GHz AT/XT Compatible 523 760 kB RAM |

Jak brzmi nazwa klucza rejestru w systemie Windows, gdzie zapisane są relacje między typami plików a programami je obsługującymi?

Jak nazywa się identyfikator, który musi być jednakowy, aby urządzenia sieciowe mogły współpracować w danej sieci bezprzewodowej?

Na ilustracji przedstawiono tylną stronę