Pytanie 1

Aby ocenić stabilność systemu Windows Server, należy użyć narzędzia

Wynik: 37/40 punktów (92,5%)

Wymagane minimum: 20 punktów (50%)

Aby ocenić stabilność systemu Windows Server, należy użyć narzędzia

Zestaw dodatkowy, który zawiera strzykawkę z cieczą, igłę oraz rękawice ochronne, jest przeznaczony do napełniania pojemników z medium drukującym w drukarkach

Jakie medium transmisyjne gwarantuje izolację galwaniczną pomiędzy systemami przesyłu danych?

Pamięć, która nie traci danych, może być elektrycznie kasowana i programowana, znana jest pod skrótem

Wskaż złącze żeńskie o liczbie pinów 24 lub 29, które jest w stanie przesyłać skompresowany cyfrowy sygnał do monitora?

Wskaż ilustrację obrazującą typowy materiał eksploatacyjny używany w drukarkach żelowych?

W systemie Windows użycie prezentowanego polecenia spowoduje tymczasową zmianę koloru

Podczas uruchamiania (krótko po zakończeniu testu POST) komputer się zawiesza. Jakie mogą być możliwe przyczyny tej awarii?

Jakie polecenie w systemie Windows służy do monitorowania bieżących połączeń sieciowych?

W systemie Linux polecenie touch ma na celu

Jak w systemie Windows zmienić port drukarki, która została zainstalowana?

Na komputerze z zainstalowanymi systemami operacyjnymi Windows i Linux, po przeprowadzeniu reinstalacji systemu Windows, drugi system przestaje się uruchamiać. Aby przywrócić możliwość uruchamiania systemu Linux oraz zachować dane i ustawienia w nim zgromadzone, co należy zrobić?

Tryb pracy portu równoległego, bazujący na magistrali ISA, umożliwiający transfer danych do 2,4 MB/s, dedykowany dla skanerów i urządzeń wielofunkcyjnych, to

Jakie znaczenie ma skrót MBR w kontekście technologii komputerowej?

Jaki standard szyfrowania powinien być wybrany przy konfiguracji karty sieciowej, aby zabezpieczyć transmisję w sieci bezprzewodowej?

Rodzaj systemu plików, który w systemie Windows pozwala na kompresję danych oraz przydzielanie uprawnień do plików i folderów, to

Kable światłowodowe nie są powszechnie używane w lokalnych sieciach komputerowych z powodu

Jakie jest maksymalne dozwolone promień gięcia przy układaniu kabla U/UTP kat.5E?

W sytuacji, gdy nie ma możliwości uruchomienia programu BIOS Setup, jak przywrócić domyślne ustawienia płyty głównej?

Który standard w sieciach LAN określa dostęp do medium poprzez wykorzystanie tokenu?

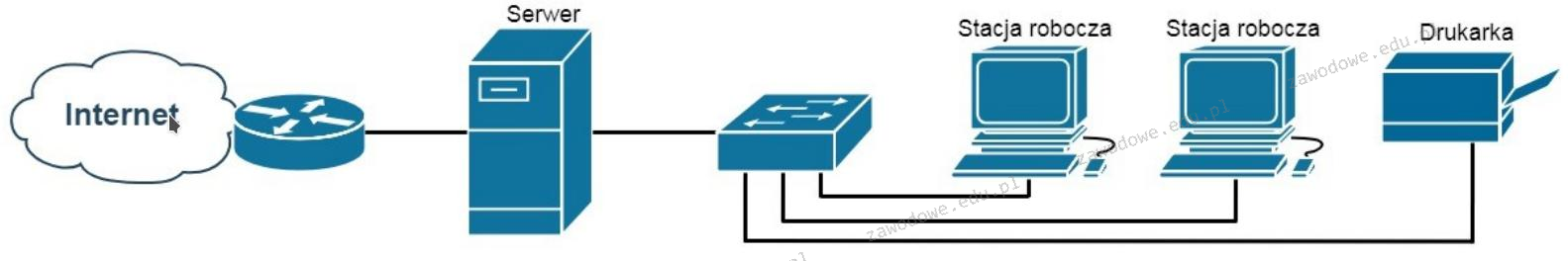

Która z usług na serwerze Windows umożliwi użytkownikom końcowym sieci zaprezentowanej na ilustracji dostęp do Internetu?

Jakie procesory można wykorzystać w zestawie komputerowym z płytą główną wyposażoną w gniazdo procesora typu Socket AM3?

Menedżer urządzeń w systemie Windows pozwala na wykrycie

W systemie Windows powiązanie rozszerzeń plików z odpowiednimi programami realizuje się za pomocą polecenia

Co oznacza standard ACPI w BIOSie komputera?

Według normy JEDEC, standardowe napięcie zasilające dla modułów pamięci RAM DDR3L o niskim napięciu wynosi

W pierwszym oktecie adresów IPv4 klasy B znajdują się liczby mieszczące się w przedziale

Dezaktywacja automatycznych aktualizacji systemu Windows skutkuje

Który z poniższych systemów operacyjnych jest systemem typu open-source?

Wartość liczby 1100112 zapisanej w systemie dziesiętnym wynosi

Rodzajem złośliwego oprogramowania będącego programem rezydentnym, który działa, wykonując konkretną operację, nie powiela się przez sieć, a jedną z jego metod jest samoreplikacja aż do wyczerpania pamięci komputera, jest

Zjawisko przekazywania tokena (ang. token) występuje w sieci o fizycznej strukturze

Interfejs UDMA to interfejs

W przypadku awarii którego urządzenia w sieci lokalnej, cała sieć przestaje działać w topologii magistrali?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jakie urządzenie sieciowe funkcjonuje w warstwie fizycznej modelu ISO/OSI, transmitując sygnał z jednego portu do wszystkich pozostałych portów?

Z jakim protokołem związane są terminy "Sequence number" oraz "Acknowledgment number"?

Pomiar strukturalnego okablowania metodą Permanent Link polega na

Które dwa urządzenia sieciowe CISCO wyposażone w moduły z portami smart serial można połączyć przy użyciu kabla szeregowego?

Narzędzie systemu Windows wykorzystywane do interpretacji poleceń, stosujące logikę obiektową oraz cmdlety, to