Pytanie 1

Jakie urządzenie powinno być użyte, aby poprawić zasięg sieci bezprzewodowej w obiekcie?

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Jakie urządzenie powinno być użyte, aby poprawić zasięg sieci bezprzewodowej w obiekcie?

Który z komponentów komputera można wymienić bez konieczności wyłączania zasilania?

Jak nazywa się topologia fizyczna sieci, która wykorzystuje fale radiowe jako medium transmisyjne?

Adresy IPv6 są reprezentowane jako liczby

Jakim protokołem jest protokół dostępu do sieci pakietowej o maksymalnej prędkości 2 Mbit/s?

Protokół pakietów użytkownika, który zapewnia dostarczanie datagramów w trybie bezpołączeniowym, to

Jakie polecenie w systemie Windows powinno być użyte do obserwacji listy bieżących połączeń karty sieciowej w komputerze?

Poprawność działania lokalnej sieci komputerowej po modernizacji powinna być potwierdzona

Urządzenie sieciowe działające w trzeciej warstwie modelu ISO/OSI, obsługujące adresy IP, to

Symbol umieszczony na obudowie komputera stacjonarnego informuje o zagrożeniu przed

Zanim przystąpimy do prac serwisowych dotyczących modyfikacji rejestru systemu Windows, konieczne jest wykonanie

Poprawę jakości skanowania można osiągnąć poprzez zmianę

Jakie informacje można uzyskać na temat konstrukcji skrętki S/FTP?

Jaki protokół jest stosowany przez WWW?

Aby powiększyć lub zmniejszyć rozmiar ikony na pulpicie, trzeba obracać rolką myszki, trzymając jednocześnie klawisz

Obecnie pamięci podręczne drugiego poziomu procesora (ang. "L-2 cache") są zbudowane z układów pamięci

Aby poprawić niezawodność i efektywność przesyłu danych na serwerze, należy

Jakiego typu kopię zapasową należy wykonać, aby zarchiwizować wszystkie informacje, niezależnie od daty ich ostatniej archiwizacji?

Jak będzie wyglądać liczba 29A16 w systemie binarnym?

Jaką wartość ma transfer danych napędu DVD przy prędkości przesyłu x48?

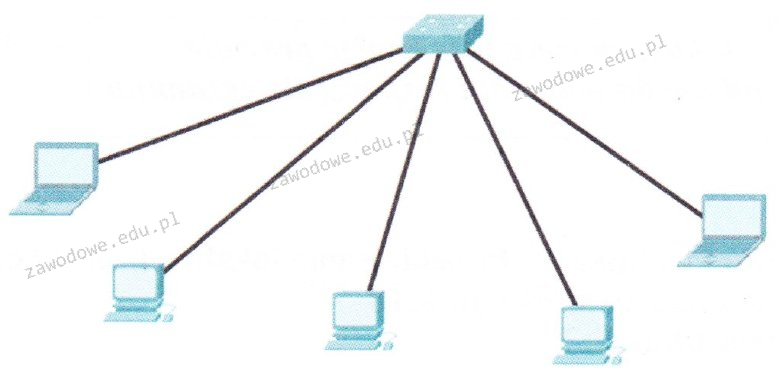

Jaką topologię fizyczną sieci ilustruje zamieszczony rysunek?

Na wydrukach uzyskanych z drukarki laserowej można zauważyć pasma wzdłużne oraz powtarzające się defekty. Jedną z możliwych przyczyn niskiej jakości druku jest wada

Elementem eksploatacyjnym drukarki laserowej jest wszystko oprócz

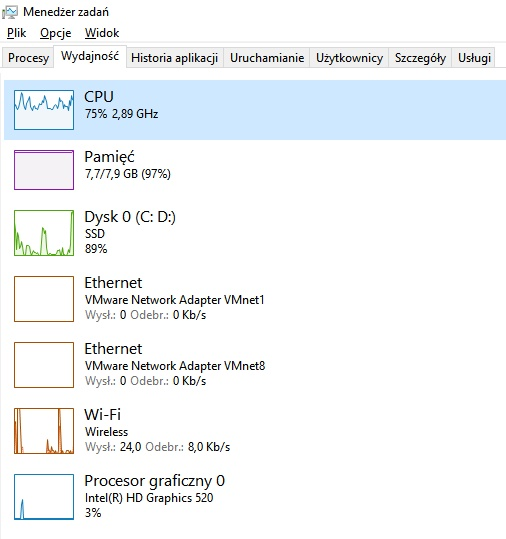

Grafik komputerowy sygnalizuje bardzo wolną pracę komputera. Z ilustracji przedstawiającej okno wydajności komputera wynika, że przyczyną tego może być

Na ilustracji widoczny jest symbol graficzny

Jakie jest tworzywo eksploatacyjne w drukarce laserowej?

Symbol zaprezentowany powyżej, używany w dokumentacji technicznej, wskazuje na

Jaki jest główny cel stosowania maski podsieci?

Który z standardów implementacji sieci Ethernet określa sieć opartą na kablu koncentrycznym, gdzie długość segmentu nie może przekraczać 185 m?

Aby określić długość prefiksu w adresie IPv4, należy ustalić

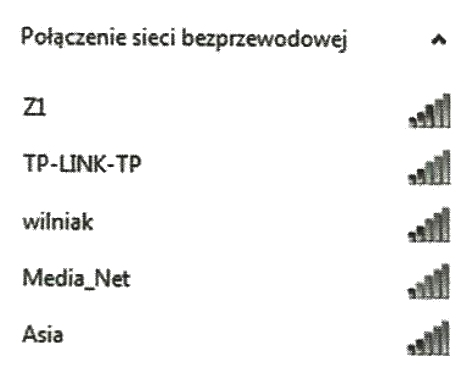

Użytkownik laptopa z systemem Windows 7 widzi dostępne sieci Wi-Fi, jak przedstawiono na ilustracji. Przy konfiguracji połączenia z siecią Z1 musi wprowadzić

Jaki adres IPv4 wykorzystuje się do testowania protokołów TCP/IP na jednym hoście?

Na rysunku można zobaczyć schemat topologii fizycznej, która jest kombinacją topologii

Czym jest mapowanie dysków?

Jakie polecenie w systemie Linux pozwala na zarządzanie uprawnieniami do plików oraz katalogów?

Liczby 1001 i 100 w wierszu pliku /etc/passwd reprezentują

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie zastosowanie ma polecenie md w systemie Windows?

System S.M.A.R.T. służy do śledzenia funkcjonowania oraz identyfikacji usterek

Jakie medium transmisyjne w sieciach LAN zaleca się do użycia w budynkach zabytkowych?