Pytanie 1

Główny protokół stosowany do ustalania ścieżki i przesyłania nią pakietów danych w sieci komputerowej to

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Główny protokół stosowany do ustalania ścieżki i przesyłania nią pakietów danych w sieci komputerowej to

Liczba FAFC w systemie heksadecymalnym odpowiada wartości liczbowej

Jakim protokołem połączeniowym w warstwie transportowej, który zapewnia niezawodność dostarczania pakietów, jest protokół

Jaka jest maksymalna liczba komputerów, które mogą być zaadresowane w podsieci z adresem 192.168.1.0/25?

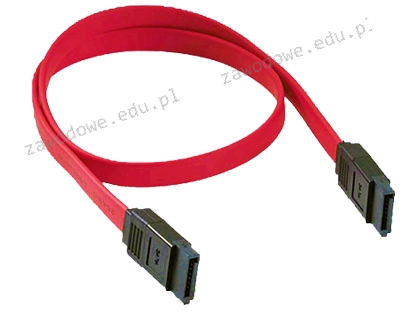

Na ilustracji przedstawiono przewód z wtykami

Jakie urządzenie służy do pomiaru wartości mocy zużywanej przez komputerowy zestaw?

Zgodnie z normą PN-EN 50174, poziome okablowanie w systemie strukturalnym to segment okablowania pomiędzy

Po wykonaniu eksportu klucza HKCU zostanie zapisana kopia rejestru zawierająca informacje, dotyczące konfiguracji

Minimalna ilość pamięci RAM wymagana dla systemu operacyjnego Windows Server 2008 wynosi przynajmniej

System S.M.A.R.T. służy do śledzenia funkcjonowania oraz identyfikacji usterek

Który standard w połączeniu z odpowiednią kategorią kabla skrętki jest skonfigurowany w taki sposób, aby umożliwiać maksymalny transfer danych?

Który protokół zamienia adresy IP na adresy MAC, używane w sieciach Ethernet?

W systemie Linux narzędzie do śledzenia zużycia CPU, pamięci, procesów oraz obciążenia systemu z poziomu terminala to

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Zgodnie z aktualnymi przepisami BHP, odległość oczu od ekranu monitora powinna wynosić

Jakie polecenie w systemie Linux pokazuje czas działania systemu oraz jego średnie obciążenie?

Aktywacja opcji Udostępnienie połączenia internetowego w systemie Windows powoduje automatyczne przydzielanie adresów IP dla komputerów (hostów) z niej korzystających. W tym celu używana jest usługa

ping 192.168.11.3 Jaką komendę należy wpisać w miejsce kropek, aby w systemie Linux wydłużyć domyślny odstęp czasowy między pakietami podczas używania polecenia ping?

Po przeprowadzeniu diagnostyki komputerowej ustalono, że temperatura pracy karty graficznej z wyjściami HDMI oraz D-SUB, zainstalowanej w gnieździe PCI Express komputera stacjonarnego, wynosi 87°C. W związku z tym, serwisant powinien

W systemie Linux uprawnienia pliku wynoszą 541. Właściciel ma możliwość:

Program typu recovery, w warunkach domowych, pozwala na odzyskanie danych z dysku twardego w przypadku

W systemie Windows 7 konfigurację interfejsu sieciowego można przeprowadzić, używając rozwinięcia polecenia

Wskaż podzespół niekompatybilny z płytą główną o przedstawionych w tabeli parametrach.

| Podzespół | Parametry |

|---|---|

| Płyta główna GIGABYTE | 4x DDR4, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8x USB 2.0, S-AM3+ |

W przypadku wpisania adresu HTTP w przeglądarkę internetową pojawia się błąd "403 Forbidden", co oznacza, że

Urządzenie komputerowe, które powinno być koniecznie podłączone do zasilania za pomocą UPS, to

Na ilustracji ukazano port w komputerze, który służy do podłączenia

W komunikacie błędu systemowego informacja prezentowana w formacie szesnastkowym oznacza

Jakim skrótem określane są czynności samokontroli komputera po uruchomieniu zasilania?

W systemie Ubuntu, które polecenie umożliwia bieżące monitorowanie działających procesów i aplikacji?

Jaki protokół stosują komputery, aby informować router o zamiarze dołączenia do lub opuszczenia konkretnej grupy multicastowej?

Przy zmianach w rejestrze Windows w celu zapewnienia bezpieczeństwa należy najpierw

Unity Tweak Tool oraz narzędzia dostrajania to elementy systemu Linux, które mają na celu

Systemy operacyjne należące do rodziny Linux są dystrybuowane na mocy licencji

Który z wymienionych adresów stanowi adres hosta w obrębie sieci 10.128.0.0/10?

Na ilustracji pokazano część efektu działania programu przeznaczonego do testowania sieci. Sugeruje to użycie polecenia diagnostycznego w sieci

TCP 192.168.0.13:51614 bud02s23-in-f8:https ESTABLISHED TCP 192.168.0.13:51615 edge-star-mini-shv-01-ams3:https ESTABLISHED TCP 192.168.0.13:51617 93.184.220.29:http ESTABLISHED TCP 192.168.0.13:51619 93.184.220.29:http ESTABLISHED TCP 192.168.0.13:51620 93.184.220.29:http TIME_WAIT TCP 192.168.0.13:51621 bud02s23-in-f206:https TIME_WAIT TCP 192.168.0.13:51622 xx-fbcdn-shv-01-ams3:https ESTABLISHED TCP 192.168.0.13:51623 108.161.188.192:https ESTABLISHED TCP 192.168.0.13:51626 23.111.9.32:https TIME_WAIT TCP 192.168.0.13:51628 lg-in-f155:https ESTABLISHED TCP 192.168.0.13:51629 waw02s06-in-f68:https ESTABLISHED

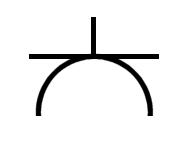

Na rysunkach technicznych dotyczących instalacji sieci komputerowej, wraz z jej dedykowanym systemem elektrycznym, gniazdo oznaczone symbolem przedstawionym na rysunku to

Wydruk z drukarki igłowej realizowany jest z zastosowaniem zestawu stalowych igieł w liczbie

Która z warstw modelu ISO/OSI ma związek z protokołem IP?

Na których urządzeniach do przechowywania danych uszkodzenia mechaniczne są najczęściej spotykane?

Podane dane katalogowe odnoszą się do routera z wbudowaną pamięcią masową

| CPU | AtherosAR7161 680MHz |

| Memory | 32MB DDR SDRAM onboard memory |

| Boot loader | RouterBOOT |

| Data storage | 64MB onboard NAND memory chip |

| Ethernet | One 10/100 Mbit/s Fast Ethernet port with Auto-MDI/X |

| miniPCI | One MiniPCI Type IIIA/IIIB slot One MiniPCIe slot for 3G modem only (onboard SIM connector) |

| Wireless | Built in AR2417 802. 11 b/g wireless, 1x MMCX connector |

| Expansion | One USB 2.0 ports (without powering, needs power adapter, available separately) |

| Serial port | One DB9 RS232C asynchronous serial port |

| LEDs | Power, NAND activity, 5 user LEDs |

| Power options | Power over Ethernet: 10..28V DC (except power over datalines). Power jack: 10..28V DC. Includes voltage monitor |

| Dimensions | 105 mm x 105 mm, Weight: 82 g |

| Power consumption | Up to 5W with wireless at full activity |

| Operating System | MikroTik RouterOS v3, Level4 license |