Pytanie 1

Jakie oznaczenie powinien mieć komputer, aby mógł zostać sprzedany na terenie Polski, zgodnie z Dyrektywami Rady Europy?

Wynik: 16/40 punktów (40,0%)

Wymagane minimum: 20 punktów (50%)

Jakie oznaczenie powinien mieć komputer, aby mógł zostać sprzedany na terenie Polski, zgodnie z Dyrektywami Rady Europy?

W celu ochrony lokalnej sieci komputerowej przed atakami typu Smurf pochodzącymi z Internetu, należy zainstalować oraz właściwie skonfigurować

W systemie Windows 7 program Cipher.exe w trybie poleceń jest używany do

Który z podanych adresów IPv4 należy do kategorii B?

Jakie znaczenie ma parametr NVP (Nominal Velocity of Propagation) podczas pomiarów okablowania strukturalnego?

Kiedy adres IP komputera ma formę 176.16.50.10/26, to jakie będą adres rozgłoszeniowy oraz maksymalna liczba hostów w danej sieci?

Urządzenie, które łączy różne segmenty sieci i przekazuje ramki pomiędzy nimi, wybierając odpowiedni port docelowy dla przesyłanych ramek, to

Analiza tłumienia w kablowym systemie przesyłowym umożliwia ustalenie

Jakiej kategorii skrętka pozwala na przesył danych w zakresie częstotliwości nieprzekraczającym 100 MHz przy szybkości do 1 Gb/s?

Funkcja System Image Recovery dostępna w zaawansowanych opcjach uruchamiania systemu Windows 7 pozwala na

Jakiego typu rozbudowa serwera wymaga zainstalowania dodatkowych sterowników?

Umowa, na podstawie której użytkownik ma między innymi dostęp do kodu źródłowego oprogramowania w celu jego analizy i ulepszania, to licencja

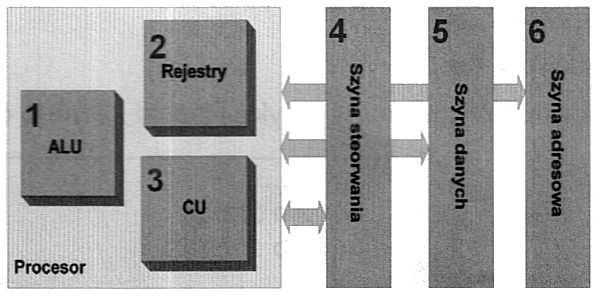

Na diagramie element odpowiedzialny za dekodowanie poleceń jest oznaczony liczbą

Zgodnie z normą 802.3u technologia sieci FastEthernet 100Base-FX stosuje

W ramach zalecanych działań konserwacyjnych użytkownicy dysków SSD powinni unikać wykonywania

Urządzenie typu Plug and Play, które jest ponownie podłączane do komputera, jest identyfikowane na podstawie

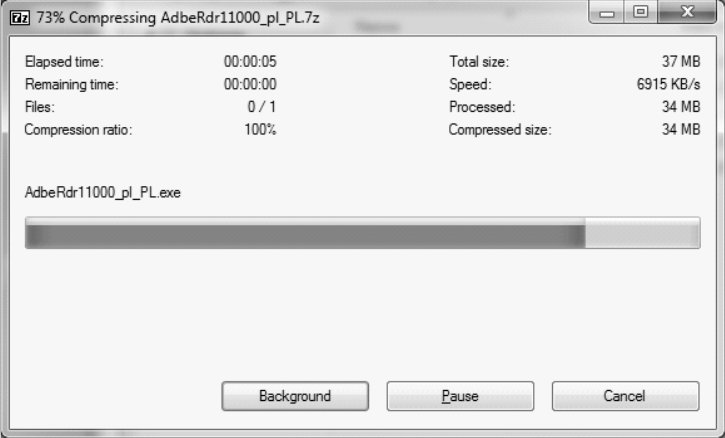

Na dołączonym obrazku ukazano proces

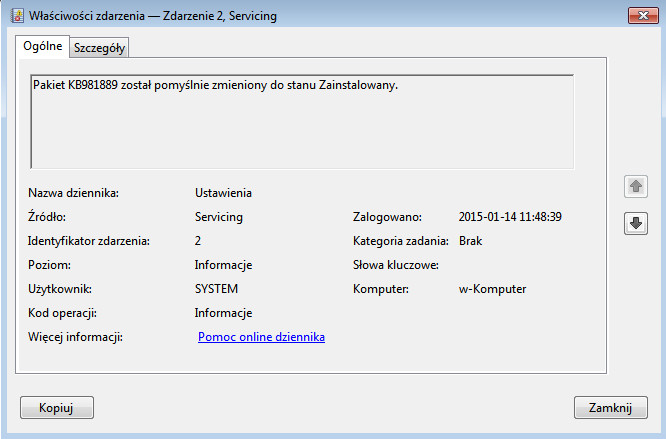

Wpis w dzienniku zdarzeń przedstawiony na ilustracji należy zakwalifikować do zdarzeń typu

Aby aktywować lub dezaktywować usługi w zainstalowanej wersji systemu operacyjnego Windows, należy wykorzystać narzędzie

Które z urządzeń może powodować wzrost liczby kolizji pakietów w sieci?

Aby umożliwić wymianę informacji pomiędzy sieciami VLAN, wykorzystuje się

Jaki będzie najniższy koszt zakupu kabla UTP, potrzebnego do okablowania kategorii 5e, aby połączyć panel krosowniczy z dwoma podwójnymi gniazdami natynkowymi 2 x RJ45, które są oddalone odpowiednio o 10 m i 20 m od panelu, jeśli cena 1 m kabla wynosi 1,20 zł?

Po zainstalowaniu systemu Windows 7 zmieniono konfigurację dysku SATA w BIOS-ie komputera z AHCI na IDE. Przy ponownym uruchomieniu komputera system będzie

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jaki typ matrycy powinien być zastosowany w monitorze modernizowanego komputera, aby zapewnić wysoką jakość obrazu oraz szerokie kąty widzenia zarówno w poziomie, jak i w pionie?

Wartość koloru RGB(255, 170, 129) odpowiada zapisie

W systemie oktalnym liczba heksadecymalna 1E2F16 ma zapis w postaci

Funkcja systemu operacyjnego, która umożliwia jednoczesne uruchamianie wielu aplikacji w trybie podziału czasu, z tym że realizacja tego podziału odbywa się przez same aplikacje, nosi nazwę

W systemie Linux, gdzie przechowywane są hasła użytkowników?

Komputer z BIOS-em firmy Award wyświetlił komunikat o treści Primary/Secondary master/slave hard disk fail. Co taki komunikat może sugerować w kontekście konieczności wymiany?

Kto jest odpowiedzialny za alokację czasu procesora dla konkretnych zadań?

Jakim modułem pamięci RAM, który jest zgodny z płytą główną GIGABYTE GA-X99-ULTRA GAMING/ X99/8xDDR4 2133, ECC, maksymalnie 128GB/ 4x PCI-E 16x/ RAID/ USB 3.1/ S-2011-V3/ATX, jest pamięć?

Do pielęgnacji elementów łożyskowych oraz ślizgowych w urządzeniach peryferyjnych wykorzystuje się

W systemie DNS, aby powiązać nazwę hosta z adresem IPv4, konieczne jest stworzenie rekordu

Jakie złącze, które pozwala na podłączenie monitora, znajduje się na karcie graficznej pokazanej na ilustracji?

W przypadku sieci strukturalnej rekomendowane jest zainstalowanie jednego punktu abonenckiego na obszarze wynoszącym

Jaka usługa musi być aktywna na serwerze, aby stacja robocza mogła automatycznie otrzymywać adres IP?

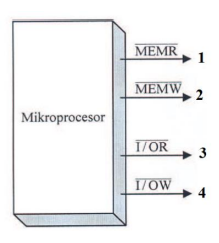

Sygnał kontrolny generowany przez procesor, umożliwiający zapis do urządzeń wejściowych i wyjściowych, został na diagramie oznaczony numerem

Co umożliwia zachowanie równomiernego rozkładu ciepła pomiędzy procesorem a radiatorem?

Jakiego rodzaju złącze powinna mieć płyta główna, aby użytkownik był w stanie zainstalować kartę graficzną przedstawioną na rysunku?