Pytanie 1

Jakie porty powinny być odblokowane w firewallu komputera, aby uzyskać dostęp do zainstalowanej usługi FTP?

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Jakie porty powinny być odblokowane w firewallu komputera, aby uzyskać dostęp do zainstalowanej usługi FTP?

Jaki rodzaj portu może być wykorzystany do podłączenia zewnętrznego dysku do laptopa?

Gdy komputer się uruchamia, na ekranie wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

Użytkownik dysponuje komputerem o podanej konfiguracji i systemie Windows 7 Professional 32bit. Która z opcji modernizacji komputera NIE przyczyni się do zwiększenia wydajności?

| Płyta główna | ASRock Z97 Anniversary Z97 DualDDR3-1600 SATA3 RAID HDMI ATX z czterema slotami DDR3 i obsługą RAID poziomu 0,1 |

| Procesor | i3 |

| Pamięć | 1 x 4 GB DDR3 |

| HDD | 2 x 1 TB |

Jakiego protokołu używa polecenie ping?

Który rodzaj kopii zapasowej należy wybrać, aby wykonać przyrostową kopię danych?

Jakie urządzenie wskazujące działa na podstawie zmian pojemności elektrycznej?

Wskaż sygnał, który wskazuje na uszkodzenie karty graficznej w komputerze z BIOS POST od firmy AWARD?

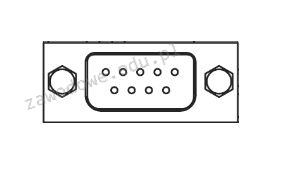

Obrazek ilustruje rodzaj złącza

Wykonane polecenia, uruchomione w interfejsie CLI rutera marki CISCO, spowodują ```Router#configure terminal Router(config)#interface FastEthernet 0/0 Router(config-if)#ip address 10.0.0.1 255.255.255.0 Router(config-if)#ip nat inside```

Jaką maksymalną prędkość przesyłania danych osiągają urządzenia zgodne ze standardem 802.11g?

Jak nazywa się translacja adresów źródłowych w systemie NAT routera, która zapewnia komputerom w sieci lokalnej dostęp do internetu?

Termin "10 W" w dokumentacji technicznej dotyczącej głośnika komputerowego wskazuje na jego

Ile maksymalnie dysków twardych można bezpośrednio podłączyć do płyty głównej, której fragment specyfikacji jest przedstawiony w ramce?

|

W systemie Linux narzędzie do śledzenia zużycia CPU, pamięci, procesów oraz obciążenia systemu z poziomu terminala to

Jakie narzędzie jest używane do zakończenia skrętki wtykiem 8P8C?

Aby zabezpieczyć system przed atakami z sieci nazywanymi phishingiem, nie powinno się

Użytkownik systemu Windows może korzystając z programu Cipher

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

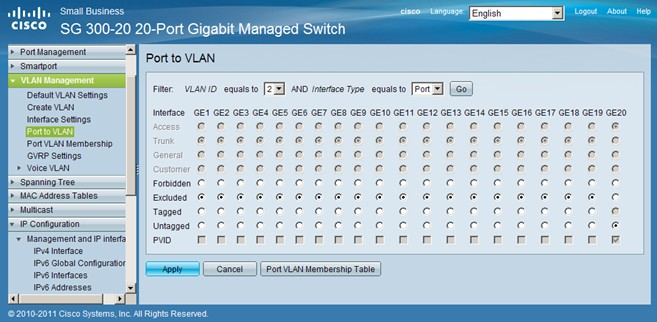

Jakie urządzenie powinno zostać wykorzystane do podłączenia komputerów, aby mogły funkcjonować w odrębnych domenach rozgłoszeniowych?

Kto jest odpowiedzialny za alokację czasu procesora dla konkretnych zadań?

Jaki standard szyfrowania powinien być wybrany przy konfiguracji karty sieciowej, aby zabezpieczyć transmisję w sieci bezprzewodowej?

Jakie urządzenie należy wykorzystać do zestawienia komputerów w sieci przewodowej o strukturze gwiazdy?

W procedurze Power-On Self-Test w pierwszej kolejności wykonywane jest sprawdzanie

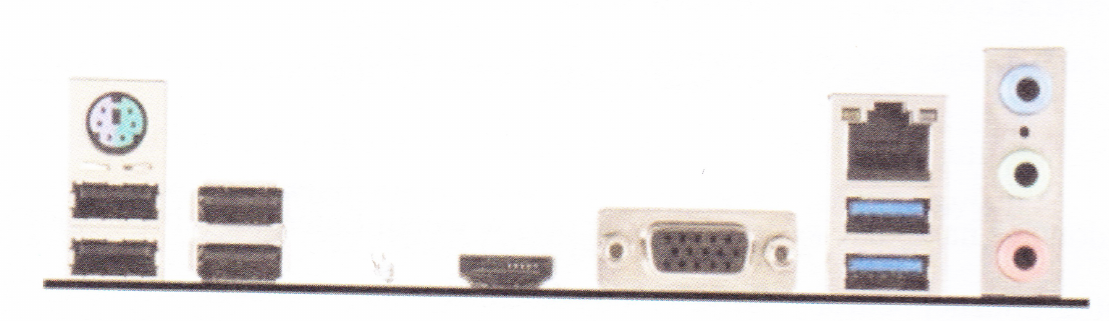

Zidentyfikuj interfejsy znajdujące się na panelu tylnym płyty głównej:

Na ilustracji zaprezentowano układ

Który z poniższych programów nie jest wykorzystywany do zdalnego administrowania komputerami w sieci?

Jaką kwotę łącznie pochłonie robocizna związana z montażem 20 modułów RJ45 z krawędziowym złączem narzędziowym na przewodach 4-parowych, jeśli stawka godzinowa montera wynosi 15 zł/h, a według tabeli KNR czas montażu pojedynczego modułu to 0,10 r-g?

W drukarce laserowej do utrwalania obrazu na papierze stosuje się

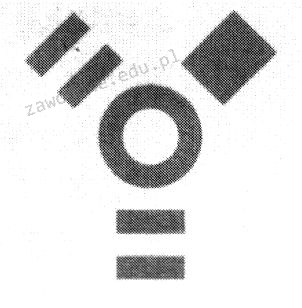

Graficzny symbol odnosi się do standardów sprzętowych

Przedstawiony moduł pamięci należy zamontować na płycie głównej w gnieździe

Jakim parametrem definiuje się stopień zmniejszenia mocy sygnału w danej parze przewodów po przejściu przez cały tor kablowy?

Materiałem eksploatacyjnym, stosowanym w rzutniku multimedialnym, jest

Zgodnie z przedstawionymi zaleceniami dla drukarki atramentowej, kolorowe dokumenty powinny być drukowane przynajmniej

„Czyszczenie głowicy drukarki …. ….. W tym przypadku najskuteczniejszym rozwiązaniem jest wyczyszczenie głowicy drukarki z zaschniętego tuszu. Z reguły wystarcza przetarcie głównego źródła problemu wilgotnym ręcznikiem. Jeżeli to nie pomoże należy zassać tusz do dysz, co pozwoli usunąć z nich powietrze. ….. Kiedy również i to nie pomoże należy przejść do ręcznego czyszczenia głowicy. Drukarka….. powinna być wyłączana na noc, ponieważ po każdym włączeniu przeprowadzane są mini cykle czyszczenia. Warto również pamiętać o wydrukowaniu przynajmniej raz w tygodniu kolorowego dokumentu, dzięki czemu zminimalizujemy prawdopodobieństwo zaschnięcia tuszu." Fragment instrukcji czyszczenia drukarki |

Symbol przedstawiony na ilustracji oznacza produkt

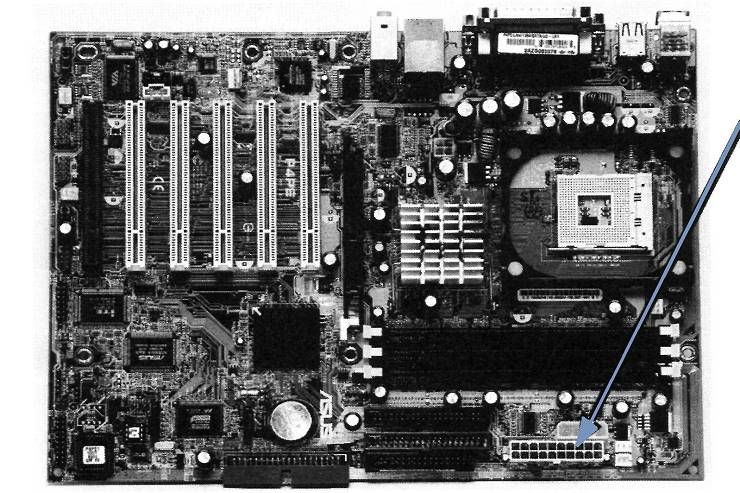

Na zdjęciu widać płytę główną komputera. Strzałka wskazuje na

Które z tych określeń nie odpowiada charakterystyce kabla światłowodowego?

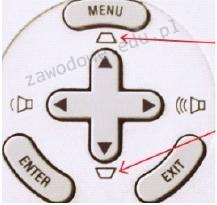

Na przedstawionym obrazku zaznaczone są strzałkami funkcje przycisków umieszczonych na obudowie projektora multimedialnego. Dzięki tym przyciskom można

Podstawowy protokół stosowany do ustalania ścieżki oraz przesyłania pakietów danych w sieci komputerowej to

Która część stanowi treść dokumentacji powykonawczej?