Pytanie 1

W systemie Linux Ubuntu Server, aby przeprowadzić instalację serwera DHCP, należy wykorzystać polecenie

Wynik: 15/40 punktów (37,5%)

Wymagane minimum: 20 punktów (50%)

W systemie Linux Ubuntu Server, aby przeprowadzić instalację serwera DHCP, należy wykorzystać polecenie

Jaki protokół służy komputerom do informowania rutera o przynależności do konkretnej grupy multicastowej?

Wtyk przedstawiony na ilustracji powinien być użyty do zakończenia kabli kategorii

Który z parametrów okablowania strukturalnego definiuje stosunek mocy sygnału tekstowego w jednej parze do mocy sygnału wyindukowanego w sąsiedniej parze na tym samym końcu kabla?

Jaki będzie wynik operacji odejmowania dwóch liczb szesnastkowych: 60Aₕ – 3BFₕ?

Ile maksymalnie hostów można przydzielić w sieci o masce 255.255.255.192?

Jakie urządzenie ilustruje ten rysunek?

Umożliwienie stacjom roboczym Windows, OS X oraz Linux korzystania z usług drukowania Linuxa i serwera plików zapewnia serwer

Jakie rozwiązanie należy wdrożyć i prawidłowo ustawić, aby chronić lokalną sieć komputerową przed atakami typu Smurf pochodzącymi z Internetu?

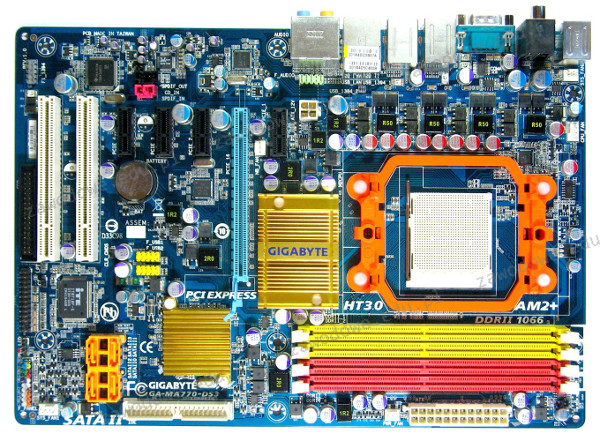

Na załączonym zdjęciu znajduje się

Który z poniższych adresów IP należy do grupy C?

Narzędzie chroniące przed nieautoryzowanym dostępem do lokalnej sieci, to

Protokół transportowy bez połączenia w modelu ISO/OSI to

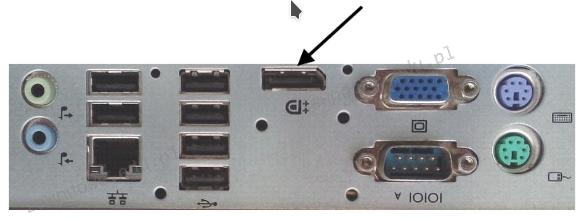

Na ilustracji ukazany jest tylny panel stacji roboczej. Strzałką wskazano port

Na których urządzeniach do przechowywania danych uszkodzenia mechaniczne są najczęściej spotykane?

Ile pinów znajduje się w wtyczce SATA?

Jakie narzędzie w systemie Windows Server umożliwia zarządzanie zasadami grupy?

Jakie aktywne urządzenie pozwoli na nawiązanie połączenia z lokalną siecią dla 15 komputerów, drukarki sieciowej oraz rutera, wykorzystując kabel UTP?

Na jakich nośnikach pamięci masowej jednym z najczęstszych powodów uszkodzeń jest zniszczenie powierzchni?

Informacje ogólne na temat zdarzeń systemowych w systemie Linux są zapisywane w

Który z protokołów jest używany podczas rozpoczynania sesji VoIP?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Który z protokołów przesyła datagramy użytkownika BEZ GWARANCJI ich dostarczenia?

Która para: protokół – warstwa, w której funkcjonuje protokół, jest prawidłowo zestawiona według modelu TCP/IP?

Zarządzaniem czasem procesora dla różnych zadań zajmuje się

Wskaż standard interfejsu stosowanego do przewodowego połączenia dwóch urządzeń.

Jakie jest odpowiednik maski 255.255.252.0 w postaci prefiksu?

Komputer stracił łączność z siecią. Jakie działanie powinno być podjęte w pierwszej kolejności, aby naprawić problem?

Obudowa oraz wyświetlacz drukarki fotograficznej są bardzo brudne. Jakie środki należy zastosować, aby je wyczyścić?

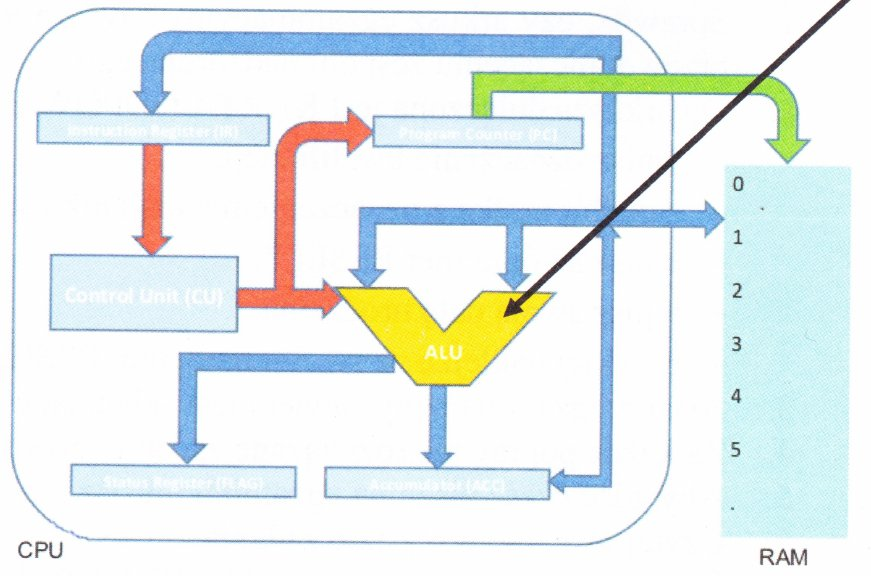

Na diagramie mikroprocesora zidentyfikowany strzałką blok odpowiada za

Jakie złącze umożliwia przesył danych między przedstawioną na ilustracji płytą główną a urządzeniem zewnętrznym, nie dostarczając jednocześnie zasilania do tego urządzenia przez interfejs?

Który z standardów implementacji sieci Ethernet określa sieć opartą na kablu koncentrycznym, gdzie długość segmentu nie może przekraczać 185 m?

Który symbol przedstawia przełącznik?

Jaką funkcję należy wybrać, aby utworzyć kopię zapasową rejestru systemowego w edytorze regedit?

Wskaż nazwę modelu przechowywania i przetwarzania danych opartego na użytkowaniu zasobów dyskowych, obliczeniowych i programowych, udostępnionych przez usługodawcę za pomocą sieci komputerowej.

W celu zapewnienia jakości usługi QoS, w przełącznikach warstwy dostępu stosuje się mechanizm

Przy pomocy testów statycznych okablowania można zidentyfikować

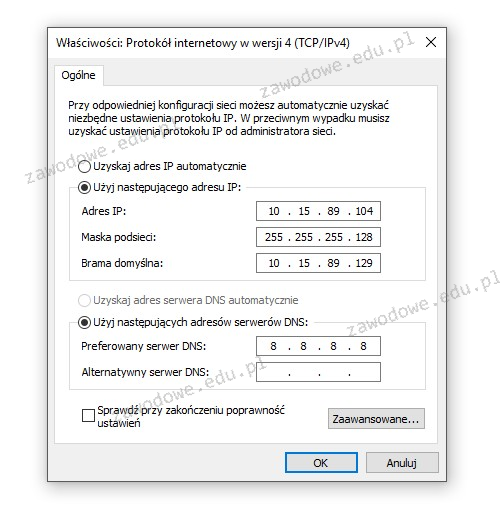

Na rysunku przedstawiono ustawienia karty sieciowej urządzenia z adresem IP 10.15.89.104/25. Co z tego wynika?

Podaj polecenie w systemie Linux, które umożliwia wyświetlenie identyfikatora użytkownika.

Który z podanych adresów IPv4 stanowi adres publiczny?