Pytanie 1

Wykonanie polecenia net use Z:192.168.20.2data /delete spowoduje?

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Wykonanie polecenia net use Z:192.168.20.2data /delete spowoduje?

Aby zidentyfikować, który program najbardziej obciąża CPU w systemie Windows, należy otworzyć program

Aby telefon VoIP działał poprawnie, należy skonfigurować adres

Który z poniższych interfejsów komputerowych stosuje transmisję równoległą do przesyłania danych?

W dokumentacji jednego z komponentów komputera zawarto informację, że urządzenie obsługuje OpenGL. Jakiego elementu dotyczy ta dokumentacja?

Podstawowym zadaniem mechanizmu Plug and Play jest

Główny sposób zabezpieczania danych w sieciach komputerowych przed dostępem nieautoryzowanym to

W komputerze o parametrach przedstawionych w tabeli konieczna jest wymiana karty graficznej na kartę GeForce GTX 1070 Ti Titanium 8G DDR5, PCI EX-x16 3.0, 256b, 1683 MHz/1607 MHz, Power consumption 180W, 3x DP, 2x HDMI, recommended power supply 500W, DirectX 12, OpenGL 4.5. W związku z tym należy również zaktualizować

| Podzespół | Parametry | Pobór mocy [W] |

|---|---|---|

| Procesor Intel i5 | Cores: 6, Threads: 6, 2.8 GHz, Tryb Turbo: 4.0 GHz, s-1151 | 30 |

| Moduł pamięci DDR3 | Taktowanie: 1600 MHz, 8 GB (1x8 GB), CL 9 | 6 |

| Monitor LCD | Powłoka: matowa, LED, VGA x1, HDMI x1, DP x1 | 40 |

| Mysz i klawiatura | przewodowa, interfejs: USB | 2 |

| Płyta główna | 2x PCI Ex-x16 3.0, D-Sub x1, USB 2.0 x2, RJ-45 x1, USB 3.1 gen 1 x4, DP x1, PS/2 x1, DDR3, s-1151, 4xDDR4 (Max: 64 GB) | 35 |

| Karta graficzna | 3x DP, 1x DVI-D, 1x HDMI, 2 GB GDDR3 | 150 |

| Dysk twardy 7200 obr/min | 1 TB, SATA III (6 Gb/s), 64 MB | 16 |

| Zasilacz | Moc: 300W | --- |

Jak nazywa się protokół warstwy transportowej modelu TCP/IP, który nie gwarantuje dostarczenia danych?

W kontekście adresacji IPv6, użycie podwójnego dwukropka służy do

Na ilustracji ukazano złącze zasilające

Aplikacją systemu Windows, która umożliwia analizę wpływu różnych procesów i usług na wydajność CPU oraz oceny stopnia obciążenia pamięci i dysku, jest

Jakie napięcie jest dostarczane przez płytę główną do pamięci typu SDRAM DDR3?

Co się stanie, jeśli w systemie operacyjnym komputera zainstalowany zostanie program określany jako Trojan?

Narzędziem systemu Windows, służącym do sprawdzenia wpływu poszczególnych procesów i usług na wydajność procesora oraz tego, w jakim stopniu generują one obciążenie pamięci czy dysku, jest

Diody LED RGB funkcjonują jako źródło światła w różnych modelach skanerów

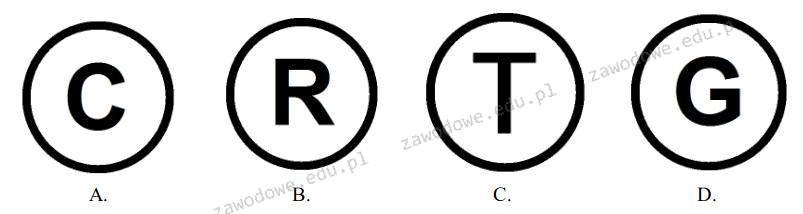

Który symbol wskazuje na zastrzeżenie praw autorskich?

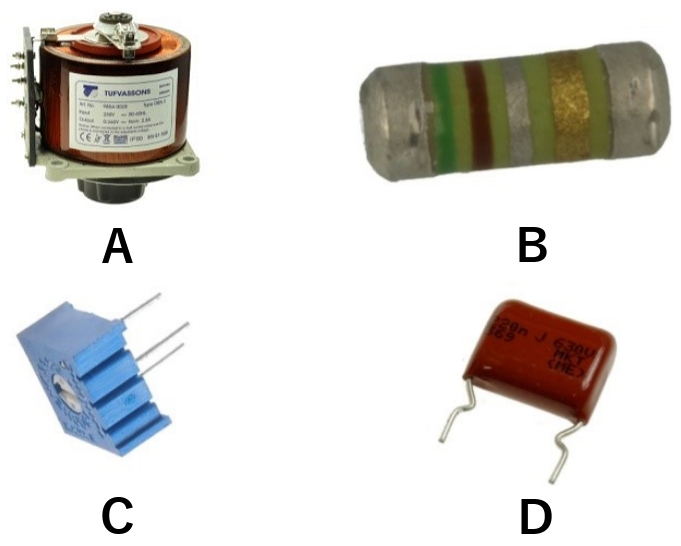

Wskaż ilustrację przedstawiającą kondensator stały?

Jak wygląda liczba 257 w systemie dziesiętnym?

Jakie narzędzie pozwala na zarządzanie menedżerem rozruchu w systemach Windows od wersji Vista?

Które z poniższych poleceń służy do naprawienia głównego rekordu rozruchowego dysku twardego w systemie Windows?

W nowoczesnych panelach dotykowych prawidłowe działanie wyświetlacza zapewnia mechanizm rozpoznający zmianę

Co umożliwia zachowanie jednolitego rozkładu temperatury pomiędzy procesorem a radiatorem?

Jakie narzędzie w systemie Linux pozwala na wyświetlenie danych o sprzęcie zapisanych w BIOS?

Osoba planuje unowocześnić swój komputer poprzez zwiększenie pamięci RAM. Zainstalowana płyta główna ma specyfikacje przedstawione w tabeli. Wybierając dodatkowe moduły pamięci, powinien pamiętać, aby

| Parametry płyty głównej | |

|---|---|

| Model | H97 Pro4 |

| Typ gniazda procesora | Socket LGA 1150 |

| Obsługiwane procesory | Intel Core i7, Intel Core i5, Intel Core i3, Intel Pentium, Intel Celeron |

| Chipset | Intel H97 |

| Pamięć | 4 x DDR3- 1600 / 1333/ 1066 MHz, max 32 GB, ECC, niebuforowana |

| Porty kart rozszerzeń | 1 x PCI Express 3.0 x16, 3 x PCI Express x1, 2 x PCI |

Programy CommView oraz WireShark są wykorzystywane do

Aby w systemie Windows ustawić właściwości wszystkich zainstalowanych urządzeń lub wyświetlić ich listę, należy użyć narzędzia

Uruchomienie systemu Windows jest niemożliwe z powodu awarii oprogramowania. W celu przeprowadzenia jak najmniej inwazyjnej diagnostyki i usunięcia tej usterki, zaleca się

W jakim systemie operacyjnym występuje mikrojądro?

Jaki będzie najniższy koszt zakupu kabla UTP, potrzebnego do okablowania kategorii 5e, aby połączyć panel krosowniczy z dwoma podwójnymi gniazdami natynkowymi 2 x RJ45, które są oddalone odpowiednio o 10 m i 20 m od panelu, jeśli cena 1 m kabla wynosi 1,20 zł?

Do podłączenia projektora multimedialnego do komputera, nie można użyć złącza

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Wartość liczby dziesiętnej 128(d) w systemie heksadecymalnym wyniesie

Jakie polecenie powinien wydać root w systemie Ubuntu Linux, aby zaktualizować wszystkie pakiety (cały system) do najnowszej wersji, łącznie z nowym jądrem?

Jak nazywa się topologia fizyczna, w której wszystkie urządzenia końcowe są bezpośrednio połączone z jednym punktem centralnym, takim jak koncentrator lub przełącznik?

Aby podłączyć kabel w module Keystone, jakie narzędzie należy zastosować?

Dokument mający na celu przedstawienie oferty cenowej dla inwestora dotyczącej przeprowadzenia robót instalacyjnych w sieci komputerowej, to

Katalog Nakładów Rzeczowych w projektowaniu sieci służy do

Użytkownik pragnie ochronić dane na karcie pamięci przed przypadkowym usunięciem. Taką zabezpieczającą cechę oferuje karta

Które stwierdzenie opisuje profil tymczasowy użytkownika?