Pytanie 1

Jaką minimalną ilość pamięci RAM musi mieć komputer, aby móc uruchomić 64-bitowy system operacyjny Windows 7 w trybie graficznym?

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

Jaką minimalną ilość pamięci RAM musi mieć komputer, aby móc uruchomić 64-bitowy system operacyjny Windows 7 w trybie graficznym?

Interfejs HDMI w komputerze umożliwia transfer sygnału

Jakie narzędzie w systemie Windows służy do wykonania poleceń, wykorzystując logikę obiektową oraz cmdlety?

System S.M.A.R.T. jest wykorzystywany do nadzorowania działania oraz identyfikacji usterek

W systemie Ubuntu, które polecenie umożliwia bieżące monitorowanie działających procesów i aplikacji?

Podczas wyłączania systemu operacyjnego na monitorze pojawił się błąd, znany jako bluescreen 0x000000F3 Bug Check 0xF3 DISORDERLY_SHUTDOWN - nieudane zamykanie systemu, spowodowane niewystarczającą ilością pamięci. Co ten błąd może oznaczać?

W nowoczesnych ekranach dotykowych działanie ekranu jest zapewniane przez mechanizm, który wykrywa zmianę

Jednym z programów ochronnych, które zabezpieczają system przed oprogramowaniem, które bez zgody użytkownika zbiera i przesyła jego dane osobowe, numery kart kredytowych, informacje o odwiedzanych stronach WWW, hasła oraz używane adresy e-mail, jest aplikacja

W komputerze zainstalowano nowy dysk twardy o pojemności 8 TB i podzielono go na dwie partycje, z których każda ma 4 TB. Jaki typ tablicy partycji powinien być zastosowany, aby umożliwić takie partycjonowanie?

W środowisku Linux uruchomiono skrypt przy użyciu dwóch argumentów. Uzyskanie dostępu do wartości drugiego argumentu z wnętrza skryptu możliwe jest przez

Podczas realizacji projektu sieci LAN zastosowano medium transmisyjne zgodne ze standardem Ethernet 1000Base-T. Które z poniższych stwierdzeń jest prawdziwe?

W celu ochrony lokalnej sieci komputerowej przed atakami typu Smurf pochodzącymi z Internetu, należy zainstalować oraz właściwie skonfigurować

Jaką cechę posiada przełącznik w sieci?

Urządzenie sieciowe nazywane mostem (ang. bridge) to:

Jaka jest maska podsieci dla adresu IP 217.152.128.100/25?

Przedstawiony listing zawiera polecenia umożliwiające:

Switch>enable Switch#configure terminal Switch(config)#interface range fastEthernet 0/1-10 Switch(config-if-range)#switchport access vlan 10 Switch(config-if-range)#exit

Jakie polecenie wykorzystano do analizy zaprezentowanej konfiguracji interfejsów sieciowych w systemie Linux?

enp0s25 Link encap:Ethernet HWaddr a0:b3:cc:28:8f:37 UP BROADCAST MULTICAST MTU:1500 Metric:1 RX packets:0 errors:0 dropped:0 overruns:0 frame:0 TX packets:0 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:1000 RX bytes:0 (0.0 B) TX bytes:0 (0.0 B) Interrupt:20 Memory:d4700000-d4720000 lo Link encap:Local Loopback inet addr:127.0.0.1 Mask:255.0.0.0 inet6 addr: ::1/128 Scope:Host UP LOOPBACK RUNNING MTU:65536 Metric:1 RX packets:172 errors:0 dropped:0 overruns:0 frame:0 TX packets:172 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:1000 RX bytes:13728 (13.7 KB) TX bytes:13728 (13.7 KB) wlo1 Link encap:Ethernet HWaddr 60:67:20:3f:91:22 inet addr:192.168.1.11 Bcast:192.168.1.255 Mask:255.255.255.0 inet6 addr: fe80::dcf3:c20b:57f7:21b4/64 Scope:Link UP BROADCAST RUNNING MULTICAST MTU:1500 Metric:1 RX packets:7953 errors:0 dropped:0 overruns:0 frame:0 TX packets:4908 errors:0 dropped:0 overruns:0 carrier:0 collisions:0 txqueuelen:1000 RX bytes:9012314 (9.0 MB) TX bytes:501345 (501.3 KB)

Aby określić rozmiar wolnej oraz zajętej pamięci RAM w systemie Linux, można skorzystać z polecenia

W systemach operacyjnych z rodziny Windows, funkcja EFS umożliwia ochronę danych poprzez ich

Brak danych dotyczących parzystości liczby lub znaku rezultatu operacji w ALU może sugerować usterki w funkcjonowaniu

Gdy użytkownik zauważy, że ważne pliki zniknęły z dysku twardego, powinien

Jakie oprogramowanie można wykorzystać do wykrywania problemów w pamięciach RAM?

Wskaż najkorzystniejszą trasę sumaryczną dla podsieci IPv4?

| 10.10.168.0/23 |

| 10.10.170.0/23 |

| 10.10.172.0/23 |

| 10.10.174.0/24 |

Jak nazywa się metoda dostępu do medium transmisyjnego z detekcją kolizji w sieciach LAN?

Aby wykonać ręczne ustawienie interfejsu sieciowego w systemie LINUX, należy użyć polecenia

Aby przetestować funkcjonowanie serwera DNS w systemach Windows Server, można skorzystać z narzędzia nslookup. Jeśli w poleceniu podamy nazwę komputera, np. nslookup host.domena.com, to dojdzie do weryfikacji

Która z liczb w systemie dziesiętnym jest poprawną reprezentacją liczby 10111111 (2)?

Jeżeli rozmiar jednostki alokacji wynosi 1024 bajty, to ile klastrów zajmą pliki umieszczone w tabeli na dysku?

| Nazwa | Wielkość |

|---|---|

| Ala.exe | 50 B |

| Dom.bat | 1024 B |

| Wirus.exe | 2 kB |

| Domes.exr | 350 B |

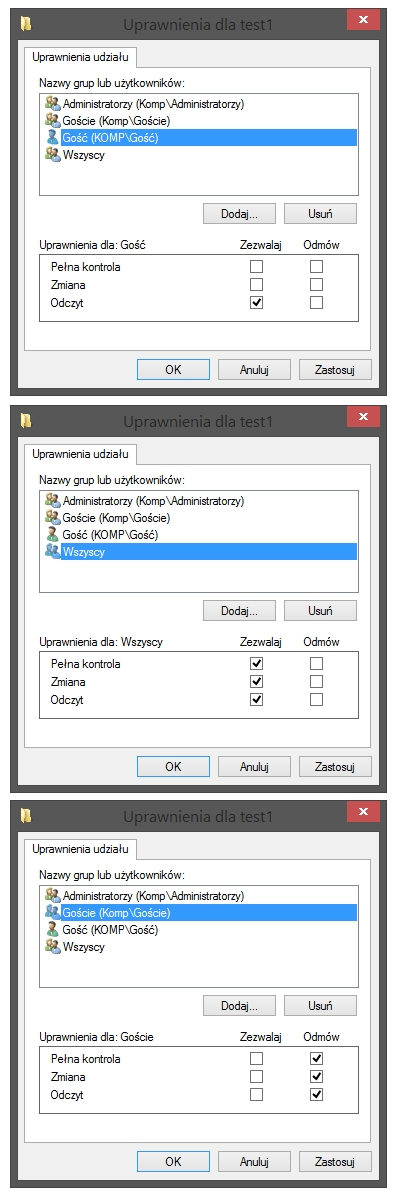

Użytkownik o nazwie Gość jest częścią grupy Goście, która z kolei należy do grupy Wszyscy. Jakie uprawnienia do folderu test1 ma użytkownik Gość?

Jaką nazwę powinien mieć identyfikator, aby urządzenia w sieci mogły działać w danej sieci bezprzewodowej?

Jakie urządzenie pracuje w warstwie łącza danych i umożliwia integrację segmentów sieci o różnych architekturach?

W dwóch sąsiadujących pomieszczeniach w pewnej firmie występują bardzo silne zakłócenia elektromagnetyczne. Aby osiągnąć jak największą przepustowość podczas działania istniejącej sieci LAN, jakie medium transmisyjne powinno zostać użyte?

Urządzenie komputerowe, które powinno być koniecznie podłączone do zasilania za pomocą UPS, to

Jakie narzędzie służy do połączenia pigtaila z włóknami światłowodowymi?

W systemie Windows, po wydaniu komendy systeminfo, nie da się uzyskać danych o

W systemie Linux, jakie polecenie służy do zmiany hasła użytkownika?

Jakiego narzędzia wraz z parametrami, należy użyć w systemie Windows, aby wyświetlić przedstawione informacje o dysku twardym?

| ST950420AS | |||||||||||||||||||||||||||||||||||||||||||||||

| Identyfikator dysku | : A67B7C06 | ||||||||||||||||||||||||||||||||||||||||||||||

| Typ | : ATA | ||||||||||||||||||||||||||||||||||||||||||||||

| Stan | : Online | ||||||||||||||||||||||||||||||||||||||||||||||

| Ścieżka | : 0 | ||||||||||||||||||||||||||||||||||||||||||||||

| Element docelowy | : 0 | ||||||||||||||||||||||||||||||||||||||||||||||

| Identyfikator jednostki LUN | : 0 | ||||||||||||||||||||||||||||||||||||||||||||||

| Ścieżka lokalizacji | : PCIROOT(0)#ATA(C00T00L00) | ||||||||||||||||||||||||||||||||||||||||||||||

| Bieżący stan tylko do odczytu | : Nie | ||||||||||||||||||||||||||||||||||||||||||||||

| Tylko do odczytu | : Nie | ||||||||||||||||||||||||||||||||||||||||||||||

| Rozruchowy | : Tak | ||||||||||||||||||||||||||||||||||||||||||||||

| Dysk plików stronicowania | : Tak | ||||||||||||||||||||||||||||||||||||||||||||||

| Dysk plików hibernacji | : Nie | ||||||||||||||||||||||||||||||||||||||||||||||

| Dysk zrzutów awaryjnych | : Tak | ||||||||||||||||||||||||||||||||||||||||||||||

| Dysk klastrowany | : Nie | ||||||||||||||||||||||||||||||||||||||||||||||

| |||||||||||||||||||||||||||||||||||||||||||||||

Który program pozwoli na zarządzanie zasobami i czasem oraz stworzenie harmonogramu prac montażowych zgodnie z projektem sieci lokalnej w budynku?

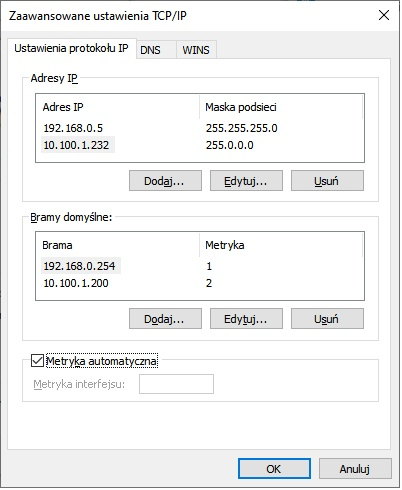

Na podstawie przedstawionej na ilustracji konfiguracji, w przypadku, gdy komputer żąda połączenia z inną siecią, w pierwszej kolejności dane zostaną wysłane do urządzenia o adresie

Wskaż zewnętrzny protokół rutingu?