Pytanie 1

W systemie Linux uruchomiono skrypt z czterema argumentami. Jak można uzyskać dostęp do listy wszystkich wartości w skrypcie?

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

W systemie Linux uruchomiono skrypt z czterema argumentami. Jak można uzyskać dostęp do listy wszystkich wartości w skrypcie?

Jak zapisuje się liczbę siedem w systemie ósemkowym?

Aby zidentyfikować, który program najbardziej obciąża CPU w systemie Windows, należy otworzyć program

Do zarządzania przydziałami przestrzeni dyskowej w systemach Windows 7 oraz Windows 8 wykorzystywane jest narzędzie

W systemie Windows XP, aby zmienić typ systemu plików z FAT32 na NTFS, należy użyć programu

Jaką zmianę sygnału realizuje konwerter RAMDAC?

Partycja w systemie Linux, która tymczasowo przechowuje dane w przypadku niedoboru pamięci RAM, to

Jaka jest maksymalna ilość pamięci RAM w GB, do której może uzyskać dostęp 32-bitowa wersja systemu Windows?

Symbol przedstawiony na ilustracji wskazuje na produkt

W systemie Windows 7 program Cipher.exe w trybie poleceń jest używany do

Użytkownik uszkodził płytę główną z gniazdem procesora AM2. Uszkodzoną płytę można wymienić na model z gniazdem, nie zmieniając procesora i pamięci

Jaką najwyższą liczbę urządzeń można przypisać w sieci z adresacją IPv4 klasy C?

Aby zrealizować transfer danych pomiędzy siecią w pracowni a siecią ogólnoszkolną, która ma inną adresację IP, należy zastosować

Wykonanie na komputerze z systemem Windows poleceń ipconfig /release oraz ipconfig /renew umożliwia weryfikację, czy usługa w sieci działa poprawnie

Kable światłowodowe nie są szeroko używane w lokalnych sieciach komputerowych z powodu

Co symbolizuje graficzny znak przedstawiony na ilustracji?

Który adres IP reprezentuje hosta działającego w sieci o adresie 192.168.160.224/28?

Jakie funkcje pełni protokół ARP (Address Resolution Protocol)?

Sieć komputerowa, która obejmuje wyłącznie urządzenia jednej organizacji, w której dostępne są usługi realizowane przez serwery w sieci LAN, takie jak strony WWW czy poczta elektroniczna to

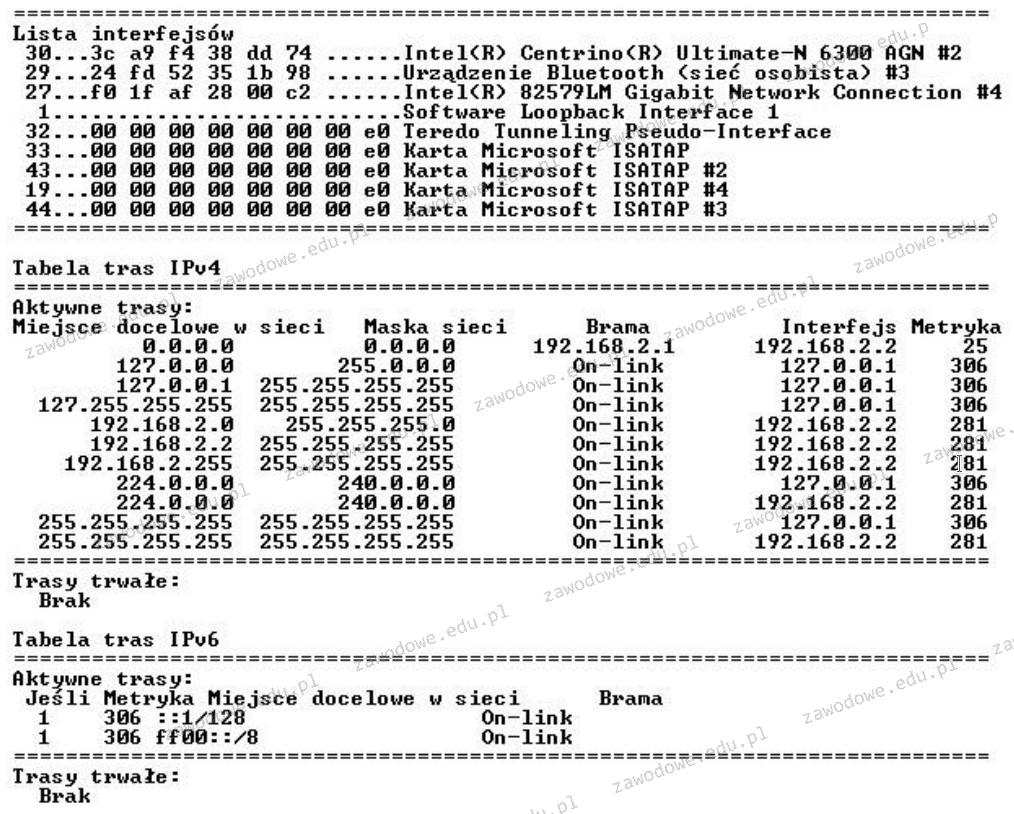

Jaki jest rezultat realizacji którego polecenia w systemie operacyjnym z rodziny Windows, przedstawiony na poniższym rysunku?

Które z poniższych stwierdzeń odnosi się do sieci P2P – peer to peer?

Który z poniższych programów nie służy do diagnozowania sieci komputerowej w celu wykrywania problemów?

Jak nazywa się urządzenie wskazujące, które współpracuje z monitorami CRT i ma końcówkę z elementem światłoczułym, a jego dotknięcie ekranu monitora skutkuje przesłaniem sygnału do komputera, co umożliwia lokalizację kursora?

Który z protokołów umożliwia szyfrowane połączenia?

Urządzenie pokazane na ilustracji służy do zgrzewania wtyków

Zrzut ekranu przedstawiony powyżej, który pochodzi z systemu Windows, stanowi efekt działania komendy

Aktywne połączenia Protokół Adres lokalny Obcy adres Stan TCP 127.0.0.1:12295 Admin-Komputer:54013 CZAS_OCZEKIWANIA TCP 127.0.0.1:53778 Admin-Komputer:54015 CZAS_OCZEKIWANIA TCP 127.0.0.1:53778 Admin-Komputer:53779 USTANOWIONO TCP 127.0.0.1:53779 Admin-Komputer:53778 USTANOWIONO TCP 127.0.0.1:53780 Admin-Komputer:53781 USTANOWIONO TCP 127.0.0.1:53781 Admin-Komputer:53780 USTANOWIONO TCP 127.0.0.1:53786 Admin-Komputer:53787 USTANOWIONO TCP 127.0.0.1:53787 Admin-Komputer:53786 USTANOWIONO TCP 127.0.0.1:53796 Admin-Komputer:53797 USTANOWIONO TCP 127.0.0.1:53797 Admin-Komputer:53796 USTANOWIONO TCP 127.0.0.1:53974 Admin-Komputer:53975 USTANOWIONO TCP 127.0.0.1:53976 Admin-Komputer:53975 USTANOWIONO

Administrator sieci lokalnej zauważył, że urządzenie typu UPS przełączyło się w tryb awaryjny. Oznacza to awarię systemu

Aby zminimalizować główne zagrożenia dotyczące bezpieczeństwa podczas pracy na komputerze podłączonym do sieci Internet, najpierw należy

Urządzenie peryferyjne pokazane na ilustracji to skaner biometryczny, który do autoryzacji wykorzystuje

Na ilustracji pokazano tylną część panelu

Pamięć RAM ukazana na grafice jest instalowana w płycie głównej z gniazdem

W celu zapewnienia jakości usługi QoS, w przełącznikach warstwy dostępu stosuje się mechanizm

Jakie narzędzie jest używane w systemie Windows do przywracania właściwych wersji plików systemowych?

Interfejs UDMA to typ interfejsu

Który protokół odpowiada za bezpieczne przesyłanie danych w sieciach komputerowych?

Do dynamicznej obsługi sprzętu w Linuxie jest stosowany system

Głowica drukująca, składająca się z wielu dysz zintegrowanych z mechanizmem drukarki, wykorzystywana jest w drukarce

Montaż przedstawionej karty graficznej będzie możliwy na płycie głównej wyposażonej w złącze

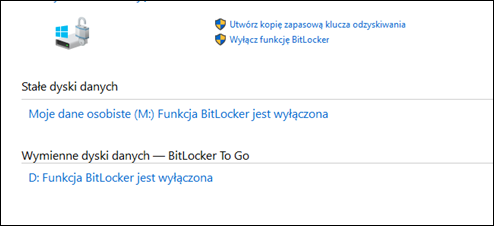

Przedstawione wbudowane narzędzie systemów Windows w wersji Enterprise lub Ultimate służy do

Użytkownik zamierza zmodernizować swój komputer zwiększając ilość pamięci RAM. Zainstalowana płyta główna ma parametry przedstawione w tabeli. Wybierając dodatkowe moduły pamięci, powinien pamiętać, aby

| Parametry płyty głównej | |

|---|---|

| Model | H97 Pro4 |

| Typ gniazda procesora | Socket LGA 1150 |

| Obsługiwane procesory | Intel Core i7, Intel Core i5, Intel Core i3, Intel Pentium, Intel Celeron |

| Chipset | Intel H97 |

| Pamięć | 4 x DDR3- 1600 / 1333/ 1066 MHz, max 32 GB, ECC, niebuforowana |

| Porty kart rozszerzeń | 1 x PCI Express 3.0 x16, 3 x PCI Express x1, 2 x PCI |