Pytanie 1

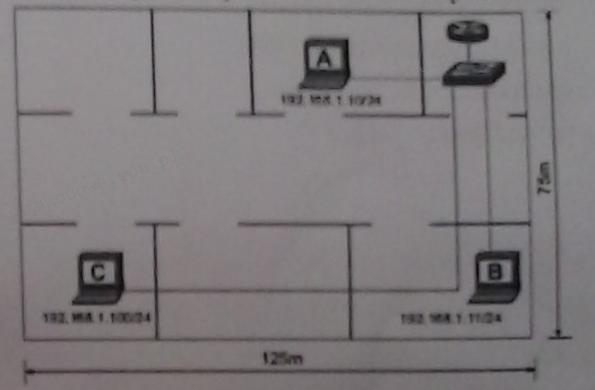

Na ilustracji przedstawiono sieć lokalną zbudowaną na kablach kat. 6. Stacja robocza "C" nie ma możliwości komunikacji z siecią. Jaki problem w warstwie fizycznej może powodować brak połączenia?

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Na ilustracji przedstawiono sieć lokalną zbudowaną na kablach kat. 6. Stacja robocza "C" nie ma możliwości komunikacji z siecią. Jaki problem w warstwie fizycznej może powodować brak połączenia?

Podczas realizacji projektu sieci komputerowej, pierwszym krokiem powinno być

Pamięć RAM ukazana na grafice jest instalowana w płycie głównej z gniazdem

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Na ilustracji zaprezentowano strukturę topologiczną

Która część stanowi treść dokumentacji powykonawczej?

Czym są programy GRUB, LILO, NTLDR?

Protokół Transport Layer Security (TLS) jest rozszerzeniem którego z poniższych protokołów?

Demon serwera Samba pozwala na udostępnianie plików oraz drukarek w sieci

Do monitorowania aktywnych połączeń sieciowych w systemie Windows służy polecenie

Jaką pojemność ma dwuwarstwowa płyta Blu-ray?

Które stwierdzenie opisuje profil tymczasowy użytkownika?

Komputer z adresem IP 192.168.5.165 oraz maską podsieci 255.255.255.192 funkcjonuje w sieci o adresie

Schemat ilustruje fizyczną strukturę

W systemie oktalnym liczba heksadecymalna 1E2F16 ma zapis w postaci

Jakiego typu wkrętak należy użyć do wypięcia dysku twardego mocowanego w laptopie za pomocą podanych śrub?

Co umożliwia połączenie trunk dwóch przełączników?

Jak nazywa się program, który pozwala na interakcję pomiędzy kartą sieciową a systemem operacyjnym?

Które urządzenie należy zainstalować, w celu zwiększenia obszaru zasięgu sieci bezprzewodowej?

Notacja #102816 oznacza zapis w systemie liczbowym

Czym jest NAS?

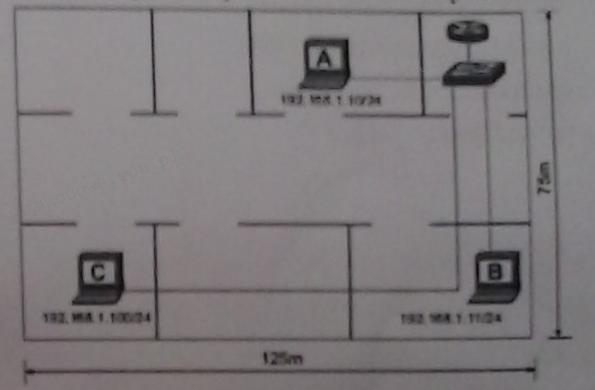

Na rysunku widać ustawienia protokołu TCP/IP serwera oraz komputera roboczego. Na serwerze działa rola serwera DNS. Wykonanie polecenia ping www.cke.edu.pl na serwerze zwraca wynik pozytywny, natomiast na stacji roboczej wynik jest negatywny. Co należy zmienić, aby usługa DNS na stacji pracowała poprawnie?

Co się stanie, jeśli w systemie operacyjnym komputera zainstalowany zostanie program określany jako Trojan?

Programem wykorzystywanym w systemie Linux do odtwarzania muzyki jest

Która usługa opracowana przez Microsoft, pozwala na konwersję nazw komputerów na adresy URL?

Jaki będzie najniższy koszt zakupu kabla UTP, potrzebnego do okablowania kategorii 5e, aby połączyć panel krosowniczy z dwoma podwójnymi gniazdami natynkowymi 2 x RJ45, które są oddalone odpowiednio o 10 m i 20 m od panelu, jeśli cena 1 m kabla wynosi 1,20 zł?

Aby uzyskać więcej wolnego miejsca na dysku bez tracenia danych, co należy zrobić?

Natychmiast po dostrzeżeniu utraty istotnych plików na dysku twardym, użytkownik powinien

W systemie Blu-ray nośnik przeznaczony do jednokrotnego zapisu jest oznaczany jako

Wskaź na błędny układ dysku z użyciem tablicy partycji MBR?

Jakie urządzenie zapewnia zabezpieczenie przed różnorodnymi atakami z sieci i może również realizować dodatkowe funkcje, takie jak szyfrowanie danych przesyłanych lub automatyczne informowanie administratora o włamaniu?

W systemie Windows do przeprowadzania aktualizacji oraz przywracania sterowników sprzętowych należy wykorzystać narzędzie

Emisja dźwięków: jednego długiego oraz dwóch krótkich przez BIOS firmy AMI wskazuje na

Aby możliwe było przekierowanie drukowanego dokumentu na dysk twardy, należy w opcjach konfiguracyjnych drukarki wybrać drukowanie do portu

Czym jest odwrotność bezstratnego algorytmu kompresji danych?

Jaką rolę odgrywa ISA Server w systemie operacyjnym Windows?

Protokół TCP (Transmission Control Protocol) funkcjonuje w trybie

Graficzny symbol ukazany na ilustracji oznacza

Atak DDoS (ang. Disributed Denial of Service) na serwer doprowadzi do

Który rodzaj kopii zapasowej należy wybrać, aby wykonać przyrostową kopię danych?