Pytanie 1

W jakiej warstwie modelu ISO/OSI wykorzystywane są adresy logiczne?

Wynik: 10/40 punktów (25,0%)

Wymagane minimum: 20 punktów (50%)

W jakiej warstwie modelu ISO/OSI wykorzystywane są adresy logiczne?

Jaką wartość ma moc wyjściowa (ciągła) zasilacza według parametrów przedstawionych w tabeli?

| Napięcie wyjściowe | +5 V | +3.3 V | +12 V1 | +12 V2 | -12 V | +5 VSB |

| Prąd wyjściowy | 18,0 A | 22,0 A | 18,0 A | 17,0 A | 0,3 A | 2,5 A |

| Moc wyjściowa | 120 W | 336W | 3,6 W | 12,5 W |

Przydzielaniem adresów IP w sieci zajmuje się serwer

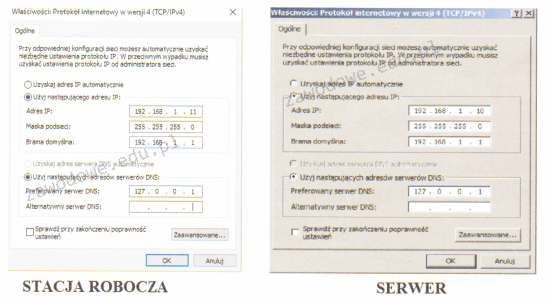

Na rysunku widać ustawienia protokołu TCP/IP serwera oraz komputera roboczego. Na serwerze działa rola serwera DNS. Wykonanie polecenia ping www.cke.edu.pl na serwerze zwraca wynik pozytywny, natomiast na stacji roboczej wynik jest negatywny. Co należy zmienić, aby usługa DNS na stacji pracowała poprawnie?

Jak określamy atak na sieć komputerową, który polega na łapaniu pakietów przesyłanych w sieci?

Transmisja danych typu półduplex to transmisja

Typ systemu plików, który nie obsługuje tworzenia wewnętrznego rejestru zmian, zwanego księgowaniem, to

Która z poniższych informacji odnosi się do profilu tymczasowego użytkownika?

Której komendy wiersza poleceń z opcji zaawansowanych naprawy systemu Windows należy użyć, aby naprawić uszkodzony MBR dysku?

Jakie urządzenie należy wykorzystać w sieci Ethernet, aby zredukować liczbę kolizji pakietów?

Który z standardów korzysta z częstotliwości 5 GHz?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Grupa protokołów, która charakteryzuje się wspólną metodą szyfrowania, to

Nazwa protokołu, który pozwala na konwersję 32-bitowych adresów IP na 48-bitowe fizyczne adresy MAC w sieciach Ethernet, to:

Klient dostarczył niesprawny sprzęt komputerowy do serwisu. Serwisant w trakcie procedury przyjęcia sprzętu, lecz przed przystąpieniem do jego naprawy, powinien

Jakie cechy posiadają procesory CISC?

Cienki klient (thin client) korzysta z protokołu

Jakiego rekordu DNS należy użyć w strefie wyszukiwania do przodu, aby powiązać nazwę domeny DNS z adresem IP?

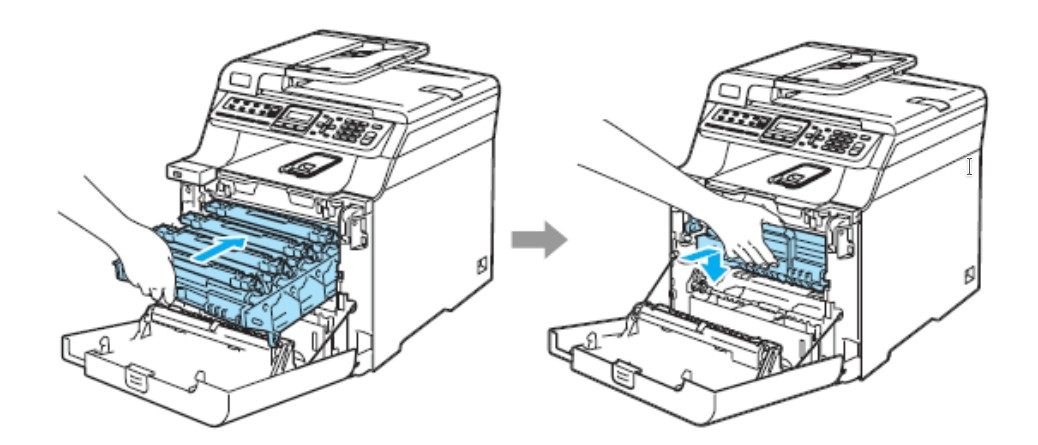

Czynność przedstawiona na ilustracjach dotyczy mocowania

Jakim skrótem określa się połączenia typu punkt-punkt w ramach publicznej infrastruktury telekomunikacyjnej?

Magistrala komunikacyjna PCI ver. 2.2 (Peripheral Component Interconnect) jest standardem magistrali, zgodnie z którym szyna danych ma maksymalną szerokość

Które urządzenie należy wykorzystać do podłączenia urządzenia peryferyjnego, wyposażonego w bezprzewodowy interfejs wykorzystujący do komunikacji fale świetlne w zakresie podczerwieni, z laptopem, który nie ma takiego interfejsu, a ma natomiast interfejs USB?

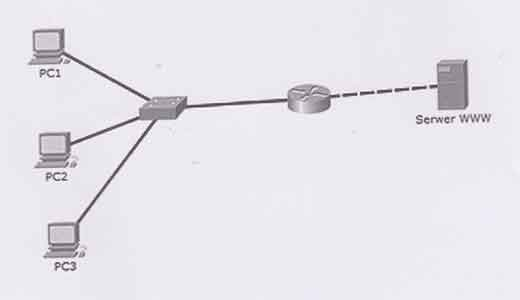

Rysunek ilustruje rezultaty sprawdzania działania sieci komputerowej przy użyciu polecenia

Badanie wp.pl [212.77.100.101] z użyciem 32 bajtów danych: Odpowiedź z 212.77.100.101: bajtów=32 czas=25ms TTL=249 Odpowiedź z 212.77.100.101: bajtów=32 czas=25ms TTL=249 Odpowiedź z 212.77.100.101: bajtów=32 czas=25ms TTL=249 Odpowiedź z 212.77.100.101: bajtów=32 czas=27ms TTL=249

Wskaż błędny sposób podziału dysku MBR na partycje

Jakie urządzenie powinno być użyte do połączenia sprzętu peryferyjnego, które posiada bezprzewodowy interfejs komunikujący się za pomocą fal świetlnych w podczerwieni, z laptopem, który nie dysponuje takim interfejsem, lecz ma port USB?

Jakie procesory można wykorzystać w zestawie komputerowym z płytą główną wyposażoną w gniazdo procesora typu Socket AM3?

Narzędzie służące do przechwytywania oraz ewentualnej analizy ruchu w sieci to

Jak nazywa się urządzenie wskazujące, które współpracuje z monitorami CRT i ma końcówkę z elementem światłoczułym, a jego dotknięcie ekranu monitora skutkuje przesłaniem sygnału do komputera, co umożliwia lokalizację kursora?

Aby sprawdzić statystyki użycia pamięci wirtualnej w systemie Linux, należy sprawdzić zawartość pliku

Jakie narzędzie w systemie Linux pozwala na wyświetlenie danych o sprzęcie zapisanych w BIOS?

Które z poniższych kont nie jest wbudowane w system Windows XP?

Jakie informacje można uzyskać za pomocą programu Wireshark?

Jakim złączem zasilany jest wewnętrzny dysk twardy typu IDE?

Który z elementów szafy krosowniczej został pokazany na ilustracji?

Jakie narzędzie jest używane do zakończenia skrętki przy pomocy wtyku 8P8C?

Jakie medium transmisyjne w sieciach LAN rekomenduje się do użycia w historycznych obiektach?

Po podłączeniu działającej klawiatury do jednego z portów USB nie ma możliwości wyboru awaryjnego trybu uruchamiania systemu Windows. Mimo to po uruchomieniu systemu w standardowym trybie klawiatura funkcjonuje prawidłowo. Co to oznacza?

Użytkownicy w sieci lokalnej mogą się komunikować między sobą, lecz nie mają możliwości połączenia z serwerem WWW. Wynik polecenia ping z komputerów do bramy jest pozytywny. Który element sieci nie może być źródłem problemu?

Aby podłączyć dysk z interfejsem SAS, należy użyć kabla przedstawionego na diagramie

Jaki jest powód sytuacji widocznej na przedstawionym zrzucie ekranu, mając na uwadze adres IP serwera, na którym umieszczona jest domena www.wp.pl, wynoszący 212.77.98.9?

C:\>ping 212.77.98.9

Pinging 212.77.98.9 with 32 bytes of data:

Reply from 212.77.98.9: bytes=32 time=29ms TTL=60

Reply from 212.77.98.9: bytes=32 time=29ms TTL=60

Reply from 212.77.98.9: bytes=32 time=30ms TTL=60

Reply from 212.77.98.9: bytes=32 time=29ms TTL=60

Ping statistics for 212.77.98.9:

Packets: Sent = 4, Received = 4, Lost = 0 (0% loss),

Approximate round trip times in milli-seconds:

Minimum = 29ms, Maximum = 30ms, Average = 29ms

C:\>ping www.wp.pl

Ping request could not find host www.wp.pl. Please check the name and try again.