Pytanie 1

Do interfejsów pracujących równolegle należy interfejs

Wynik: 29/40 punktów (72,5%)

Wymagane minimum: 20 punktów (50%)

Do interfejsów pracujących równolegle należy interfejs

Osoba korzystająca z komputera publikuje w sieci Internet pliki, które posiada. Prawa autorskie zostaną złamane, gdy udostępni

Programem wiersza poleceń w systemie Windows, który umożliwia kompresję oraz dekompresję plików i folderów, jest aplikacja

Jakiego materiału używa się w drukarkach tekstylnych?

Użytkownik systemu Windows może skorzystać z polecenia taskmgr, aby

Czy bęben światłoczuły znajduje zastosowanie w drukarkach?

Za przypisanie czasu procesora do wyznaczonych zadań odpowiada

Jakie polecenie w systemie Linux pokazuje czas działania systemu oraz jego średnie obciążenie?

W komputerach obsługujących wysokowydajne zadania serwerowe, konieczne jest użycie dysku z interfejsem

Jaką partycją w systemie Linux jest magazyn tymczasowych danych, gdy pamięć RAM jest niedostępna?

Która z wymienionych technologii pamięci RAM wykorzystuje oba zbocza sygnału zegarowego do przesyłania danych?

Adres IP (ang. Internet Protocol Address) to

Jakie są poszczególne elementy adresu globalnego IPv6 typu unicast pokazane na ilustracji?

| IPv6 | ||

|---|---|---|

| 1 | 2 | 3 |

| 48 bitów | 16 bitów | 64 bity |

Który z poniższych mechanizmów zapewni najwyższy stopień ochrony sieci bezprzewodowych w standardzie 802.11n?

Jaką standardową wartość maksymalnej odległości można zastosować pomiędzy urządzeniami sieciowymi, które są ze sobą połączone przewodem UTP kat.5e?

W architekturze sieci lokalnych opartej na modelu klient - serwer

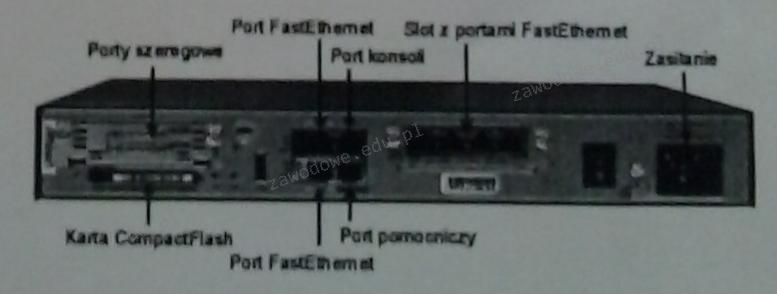

Na ilustracji przedstawiono urządzenie sieciowe, którym jest

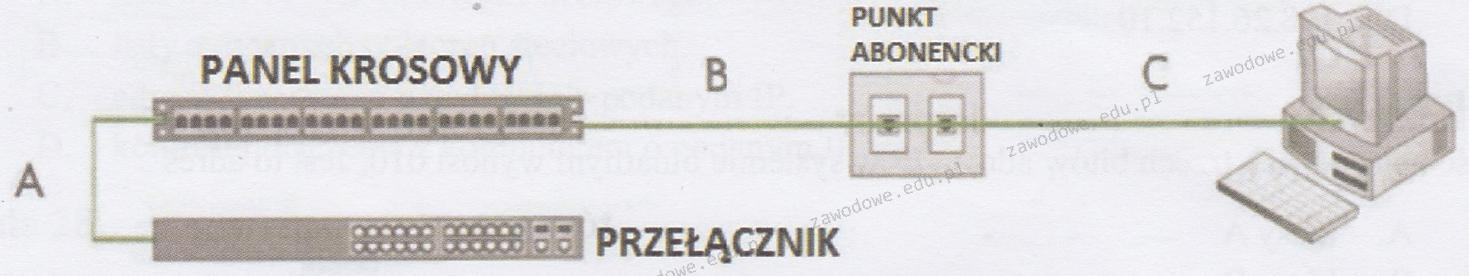

Według normy PN-EN 50174 maksymalna całkowita długość kabla połączeniowego między punktem abonenckim a komputerem oraz kabla krosowniczego A+C) wynosi

Który rodzaj złącza nie występuje w instalacjach światłowodowych?

W sieci z maską 255.255.255.128 można przypisać adresy dla

Przedstawione narzędzie jest przeznaczone do

Jaki adres IP należy do grupy A?

Aby zmienić ustawienia konfiguracyjne Menu Start oraz paska zadań w systemie Windows, która przystawka powinna być wykorzystana?

Kto jest odpowiedzialny za alokację czasu procesora dla konkretnych zadań?

Podczas realizacji projektu sieci komputerowej, pierwszym krokiem powinno być

Jaką maksymalną liczbę kanałów z dostępnego pasma kanałów standardu 802.11b można stosować w Polsce?

Miarą wyrażaną w decybelach, która określa różnicę pomiędzy mocą sygnału wysyłanego w parze zakłócającej a mocą sygnału generowanego w parze zakłócanej, jest

Tusz żelowy wykorzystywany jest w drukarkach

Aby zminimalizować ryzyko wyładowań elektrostatycznych podczas wymiany komponentów komputerowych, technik powinien wykorzystać

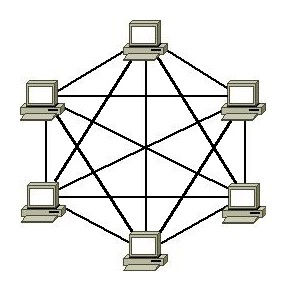

Jakiego rodzaju fizyczna topologia sieci komputerowej jest zobrazowana na rysunku?

Komputer uzyskuje dostęp do Internetu za pośrednictwem sieci lokalnej. Gdy użytkownik wpisuje w przeglądarkę internetową adres www.wp.pl, nie może otworzyć strony WWW, natomiast podanie adresu IP, przykładowo 212.77.100.101, umożliwia otwarcie tej strony. Jakie mogą być tego powody?

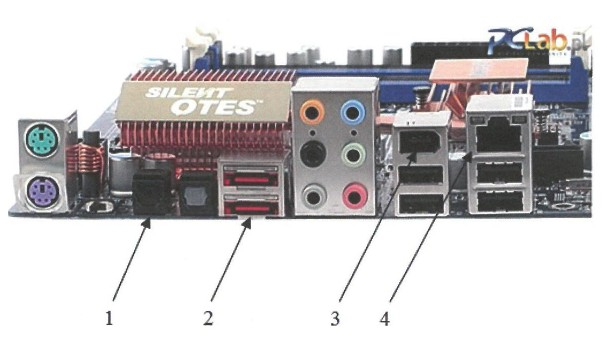

Który z portów na zaprezentowanej płycie głównej umożliwia podłączenie zewnętrznego dysku przez interfejs e-SATA?

Redukcja liczby jedynek w masce pozwoli na zaadresowanie

Pliki specjalne urządzeń, tworzone podczas instalacji sterowników w systemie Linux, są zapisywane w katalogu

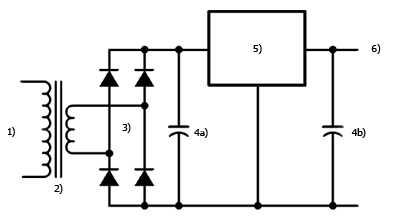

Na schemacie blokowym przedstawiającym zasadę działania zasilacza liniowego numerem 5) oznaczono

Wskaż procesor współpracujący z przedstawioną płytą główną.

Aby przetestować w systemie Windows poprawność działania nowo zainstalowanej drukarki, należy

Jaki będzie wynik operacji odejmowania dwóch liczb szesnastkowych: 60Aₕ – 3BFₕ?

Który program pozwoli na zarządzanie zasobami i czasem oraz stworzenie harmonogramu prac montażowych zgodnie z projektem sieci lokalnej w budynku?

W której warstwie modelu odniesienia ISO/OSI działają protokoły IP oraz ICMP?