Pytanie 1

Na przedstawionym obrazku zaznaczone są strzałkami funkcje przycisków umieszczonych na obudowie projektora multimedialnego. Dzięki tym przyciskom można

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Na przedstawionym obrazku zaznaczone są strzałkami funkcje przycisków umieszczonych na obudowie projektora multimedialnego. Dzięki tym przyciskom można

Który poziom macierzy RAID zapisuje dane jednocześnie na wielu dyskach jako jedno urządzenie?

Zachowanie kopii często odwiedzanych witryn oraz zwiększenie ochrony przez filtrowanie pewnych treści witryn internetowych można osiągnąć dzięki

Podłączona mysz bezprzewodowa sprawia, że kursor na ekranie nie porusza się płynnie i „skacze”. Co może być przyczyną tego problemu?

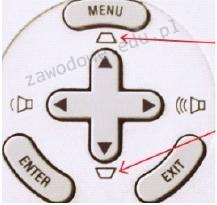

By uruchomić w systemie Windows oprogramowanie narzędziowe monitorujące wydajność komputera przedstawione na rysunku, należy uruchomić

W jaki sposób powinno się wpisać w formułę arkusza kalkulacyjnego odwołanie do komórki B3, aby przy przenoszeniu tej formuły w inne miejsce arkusza odwołanie do komórki B3 pozostało stałe?

Jakiego typu macierz RAID nie zapewnia odporności na awarie żadnego z dysków tworzących jej strukturę?

Przedstawiony skaner należy podłączyć do komputera przy użyciu złącza

Jakie urządzenie sieciowe widnieje na ilustracji?

Z jakim protokołem związane są terminy "Sequence number" oraz "Acknowledgment number"?

Jakie urządzenie powinno być użyte do podłączenia komputerów, aby mogły działać w różnych domenach rozgłoszeniowych?

Termin "PIO Mode" odnosi się do trybu operacyjnego

Który z poniższych programów NIE służy do testowania sieci komputerowej w celu wykrywania problemów?

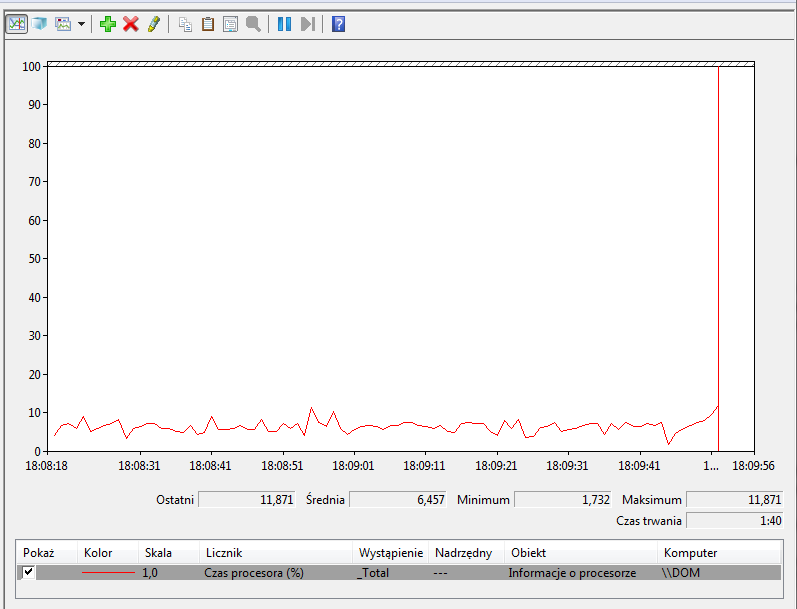

Usterka zaprezentowana na ilustracji, widoczna na monitorze, nie może być spowodowana przez

Na podstawie załączonego obrazu, który adres powinien zostać zmieniony w ustawieniach klienta lub serwera, aby umożliwić podłączenie komputera do domeny?

W nowoczesnych panelach dotykowych prawidłowe działanie wyświetlacza zapewnia mechanizm rozpoznający zmianę

Najefektywniejszym zabezpieczeniem danych firmy, której siedziby znajdują się w różnych, odległych od siebie lokalizacjach, jest zastosowanie

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Użytkownik drukarki samodzielnie i prawidłowo napełnił pojemnik z tonerem. Po jego zamontowaniu drukarka nie podejmuje próby drukowania. Przyczyną tej usterki może być

Który z wymienionych komponentów jest częścią mechanizmu drukarki igłowej?

W systemie Linux zarządzanie parametrami transmisji w sieciach bezprzewodowych jest możliwe dzięki

W systemie Windows mechanizm ostrzegający przed uruchamianiem nieznanych aplikacji oraz plików pobranych z Internetu funkcjonuje dzięki

Jakie protokoły są właściwe dla warstwy internetowej w modelu TCP/IP?

Aby naprawić uszkodzony sektor rozruchowy dysku w systemie Windows 7, należy użyć polecenia

Jaką przepustowość określa standard Ethernet IEEE 802.3z?

Tworzenie obrazu dysku ma na celu

W podejściu archiwizacji danych określanym jako Dziadek – Ojciec – Syn na poziomie Dziadek wykonuje się kopię danych na koniec

Który port stosowany jest przez protokół FTP (File Transfer Protocol) do przesyłania danych?

Rozmiar plamki na ekranie monitora LCD wynosi

Który adres IP reprezentuje hosta działającego w sieci o adresie 192.168.160.224/28?

Jakie narzędzie w systemie Windows Server umożliwia zarządzanie zasadami grupy?

ACPI jest skrótem oznaczającym

Jakie polecenie w systemie Windows powinno zostać użyte, aby uzyskać wynik zbliżony do tego na załączonym obrazku?

TCP 192.168.0.14:57989 185.118.124.154:http ESTABLISHED TCP 192.168.0.14:57997 fra15s17-in-f8:http ESTABLISHED TCP 192.168.0.14:58010 fra15s11-in-f14:https TIME_WAIT TCP 192.168.0.14:58014 wk-in-f156:https ESTABLISHED TCP 192.168.0.14:58015 wk-in-f156:https TIME_WAIT TCP 192.168.0.14:58016 104.20.87.108:https ESTABLISHED TCP 192.168.0.14:58022 ip-2:http TIME_WAIT

Jakie porty powinny być odblokowane w firewallu komputera, aby uzyskać dostęp do zainstalowanej usługi FTP?

Jakie polecenie powinien wydać root w systemie Ubuntu Linux, aby przeprowadzić aktualizację wszystkich pakietów (całego systemu) do najnowszej wersji z zainstalowaniem nowego jądra?

Jakie narzędzie jest używane do zarządzania alokacjami dyskowymi w systemach Windows 7 i Windows 8?

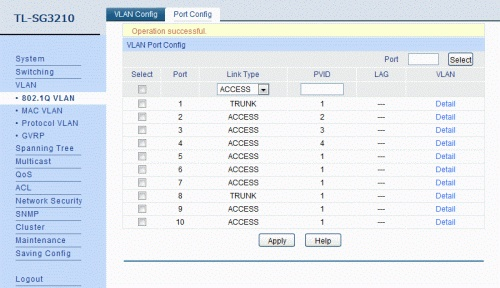

Na ilustracji przedstawiono konfigurację przełącznika z utworzonymi sieciami VLAN. Którymi portami można przesyłać oznaczone ramki z różnych sieci VLAN?

Po przeprowadzeniu diagnostyki komputera stwierdzono, że temperatura pracy karty graficznej z wyjściami HDMI oraz D-SUB, umieszczonej w gnieździe PCI Express stacjonarnego komputera, wynosi 87°C. W takiej sytuacji serwisant powinien

Urządzenie peryferyjne, które jest kontrolowane przez komputer i służy do pracy z dużymi, płaskimi powierzchniami, a do produkcji druku odpornego na warunki atmosferyczne wykorzystuje farby na bazie rozpuszczalników, nosi nazwę ploter

W tablecie graficznym bez wyświetlacza pióro nie ustala położenia kursora ekranowego, można jedynie korzystać z jego końcówki do przesuwania kursora ekranowego oraz klikania. Wskaż możliwą przyczynę nieprawidłowej pracy urządzenia.