Pytanie 1

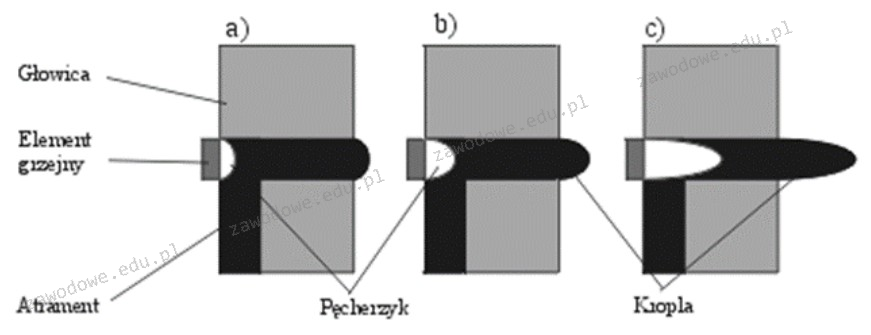

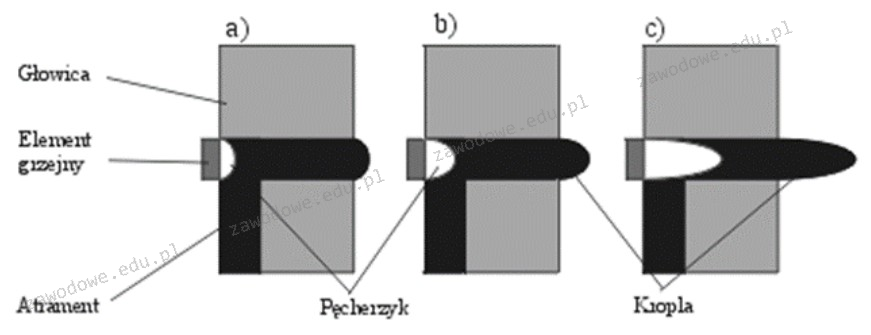

Rysunek ilustruje sposób działania drukarki

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Rysunek ilustruje sposób działania drukarki

W laserowej drukarce do utrwalania wydruku na papierze stosuje się

Jaką zmianę sygnału realizuje konwerter RAMDAC?

Która licencja pozwala na darmowe korzystanie z programu, pod warunkiem, że użytkownik dba o środowisko naturalne?

Najskuteczniejszym sposobem na codzienną archiwizację pojedynczego pliku o objętości 4,8 GB, na jednym komputerze bez dostępu do sieci, jest

Aby uniknąć utraty danych w systemie do ewidencji uczniów, po zakończeniu codziennej pracy należy wykonać

Internet Relay Chat (IRC) to protokół wykorzystywany do

Który z protokołów służy do weryfikacji poprawności połączenia między dwoma hostami?

Jakie polecenie w systemie Windows służy do analizowania ścieżki, jaką pokonują pakiety w sieci?

Aby komputery mogły udostępniać swoje zasoby w sieci, muszą mieć przypisane różne

W topologii gwiazdy każde urządzenie działające w sieci jest

Kondygnacyjny punkt dystrybucji jest połączony z

Jaką wartość przepustowości definiuje standard 1000Base-T?

NAT64 (Network Address Translation 64) to proces, który dokonuje mapowania adresów

Cienki klient (thin client) korzysta z protokołu

Jakim elementem sieci SIP jest telefon IP?

Oblicz koszt brutto materiałów niezbędnych do połączenia w sieć w topologii gwiazdy 3 komputerów wyposażonych w karty sieciowe, wykorzystując przewody o długości 2m. Ceny materiałów podano w tabeli.

| Nazwa elementu | Cena jednostkowa brutto |

|---|---|

| przełącznik | 80 zł |

| wtyk RJ-45 | 1 zł |

| przewód typu "skrętka" | 1 zł za 1 metr |

Jakiego protokołu używa polecenie ping?

Po wykonaniu podanego polecenia w systemie Windows: ```net accounts /MINPWLEN:11``` liczba 11 zostanie przydzielona dla

Poprzez użycie polecenia ipconfig /flushdns można przeprowadzić konserwację urządzenia sieciowego, która polega na

Użycie polecenia net accounts w Wierszu poleceń systemu Windows, które ustawia maksymalny czas ważności hasła, wymaga zastosowania opcji

Po przeprowadzeniu diagnostyki komputera stwierdzono, że temperatura pracy karty graficznej z wyjściami HDMI oraz D-SUB, umieszczonej w gnieździe PCI Express stacjonarnego komputera, wynosi 87°C. W takiej sytuacji serwisant powinien

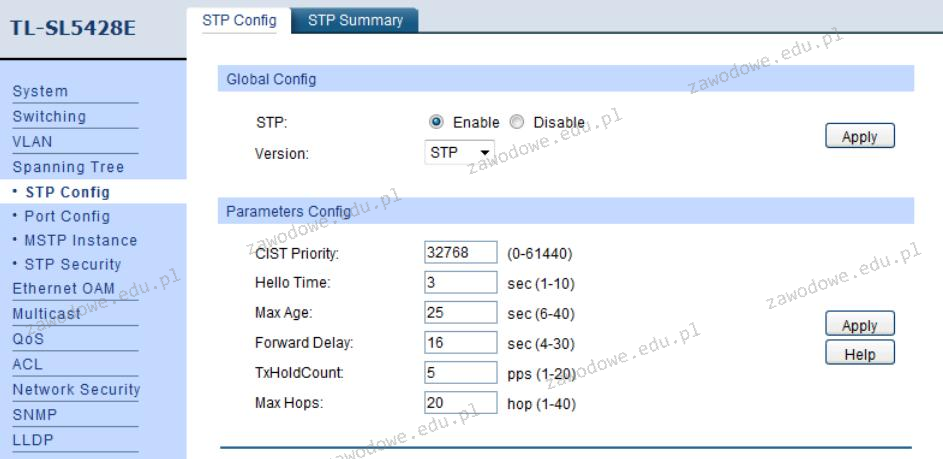

Na podstawie zrzutu ekranu ilustrującego ustawienia przełącznika można wnioskować, że

W systemie Linux do obsługi tablic partycji można zastosować komendę

Jakie typy połączeń z Internetem mogą być współdzielone w sieci lokalnej?

W jakim typie skanera stosuje się fotopowielacze?

Do serwisu komputerowego przyniesiono laptop z matrycą, która bardzo słabo wyświetla obraz. Dodatkowo obraz jest niezwykle ciemny i widoczny jedynie z bliska. Co może być przyczyną tej usterki?

Jan, użytkownik, nie ma możliwości zmiany właściciela drukarki w systemie Windows. Aby zyskał taką opcję, konieczne jest nadanie mu w ustawieniach zabezpieczeń prawa do

Który typ drukarki powinien być wykorzystany w dziale sprzedaży hurtowni materiałów budowlanych do tworzenia faktur na papierze samokopiującym, aby uzyskać kopie wydruku?

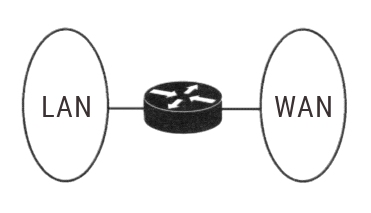

Jakie urządzenie sieciowe zostało pokazane na diagramie sieciowym?

Aby zapobiec uszkodzeniu układów scalonych, podczas konserwacji sprzętu komputerowego należy używać

Najwyższą prędkość transmisji danych w sieci bezprzewodowej zapewnia standard

Co oznacza kod BREAK odczytany przez układ elektroniczny klawiatury?

Aby załadować projekt wydruku bezpośrednio z komputera do drukarki 3D, której parametry przedstawiono w tabeli, można użyć złącza

| Technologia pracy | FDM (Fused Deposition Modeling) |

| Głowica drukująca | Podwójny ekstruder z unikalnym systemem unoszenia dyszy i wymiennymi modułami drukującymi (PrintCore) |

| Średnica filamentu | 2,85 mm |

| Platforma drukowania | Szklana, podgrzewana |

| Temperatura platformy | 20°C – 100°C |

| Temperatura dyszy | 180°C – 280°C |

| Łączność | WiFi, Ethernet, USB |

| Rozpoznawanie materiału | Skaner NFC |

W którym programie należy zmodyfikować ustawienia, aby użytkownik komputera mógł wybrać z menu i uruchomić jeden z kilku systemów operacyjnych zainstalowanych na jego komputerze?

W specyfikacji głośników komputerowych producent mógł podać informację, że maksymalne pasmo przenoszenia wynosi

Płyta główna wyposażona w gniazdo G2 będzie współpracowała z procesorem

Program typu recovery, w warunkach domowych, pozwala na odzyskanie danych z dysku twardego w przypadku

Przedstawiony na ilustracji symbol oznacza

Poprawność działania lokalnej sieci komputerowej po modernizacji powinna być potwierdzona