Pytanie 1

Ile urządzeń jest w stanie współpracować z portem IEEE1394?

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Ile urządzeń jest w stanie współpracować z portem IEEE1394?

Z jaką informacją wiąże się parametr TTL po wykonaniu polecenia ping?

Narzędzie pokazane na ilustracji jest używane do weryfikacji

Jaką maksymalną ilość GB pamięci RAM może obsłużyć 32-bitowa edycja systemu Windows?

Równoległy interfejs, w którym magistrala składa się z 8 linii danych, 4 linii sterujących oraz 5 linii statusowych, nie zawiera linii zasilających i umożliwia transmisję na odległość do 5 metrów, pod warunkiem, że przewody sygnałowe są skręcane z przewodami masy; w przeciwnym razie limit wynosi 2 metry, nazywa się

Jakie polecenie w systemach Windows należy użyć, aby ustawić statyczny adres IP w konsoli poleceń?

Do jakiego celu służy program fsck w systemie Linux?

Jaką kwotę będzie trzeba zapłacić za wymianę karty graficznej w komputerze, jeżeli jej koszt wynosi 250zł, czas wymiany to 80 minut, a każda rozpoczęta roboczogodzina to 50zł?

Rzeczywistą kalibrację sprzętową monitora można wykonać

Aby uniknąć uszkodzenia sprzętu podczas modernizacji komputera przenośnego polegającej na wymianie modułów pamięci RAM należy

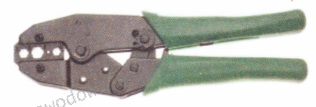

Urządzenie pokazane na ilustracji służy do zgrzewania wtyków

Układ na karcie graficznej, którego zadaniem jest zamiana cyfrowego sygnału generowanego poprzez kartę na sygnał analogowy, który może być wyświetlony poprzez monitor to

Jakie urządzenie pełni rolę wskaźnika?

W systemie Linux uprawnienia pliku wynoszą 541. Właściciel ma możliwość:

Jakiego protokołu używa polecenie ping?

Z informacji przedstawionych w tabeli wynika, że efektywna częstotliwość pamięci DDR SDRAM wynosi

| 184 styki |

| 64-bitowa szyna danych |

| Pojemność 1024 MB |

| Przepustowość 3200 MB/s |

Jakiego systemu plików powinno się użyć podczas instalacji dystrybucji Linux?

Tworzenie zaszyfrowanych połączeń pomiędzy hostami przez publiczną sieć Internet, wykorzystywane w rozwiązaniach VPN (Virtual Private Network), to

Co oznacza kod BREAK odczytany przez układ elektroniczny klawiatury?

Podanie nieprawidłowych napięć do płyty głównej może skutkować

Protokół pakietów użytkownika, który zapewnia dostarczanie datagramów w trybie bezpołączeniowym, to

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

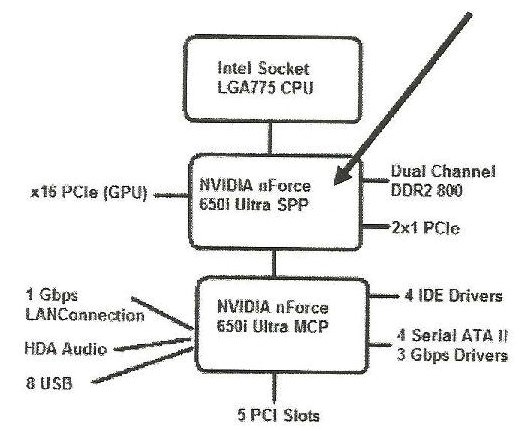

Jaką rolę pełni komponent wskazany strzałką na schemacie chipsetu płyty głównej?

Aby zainstalować openSUSE oraz dostosować jego ustawienia, można skorzystać z narzędzia

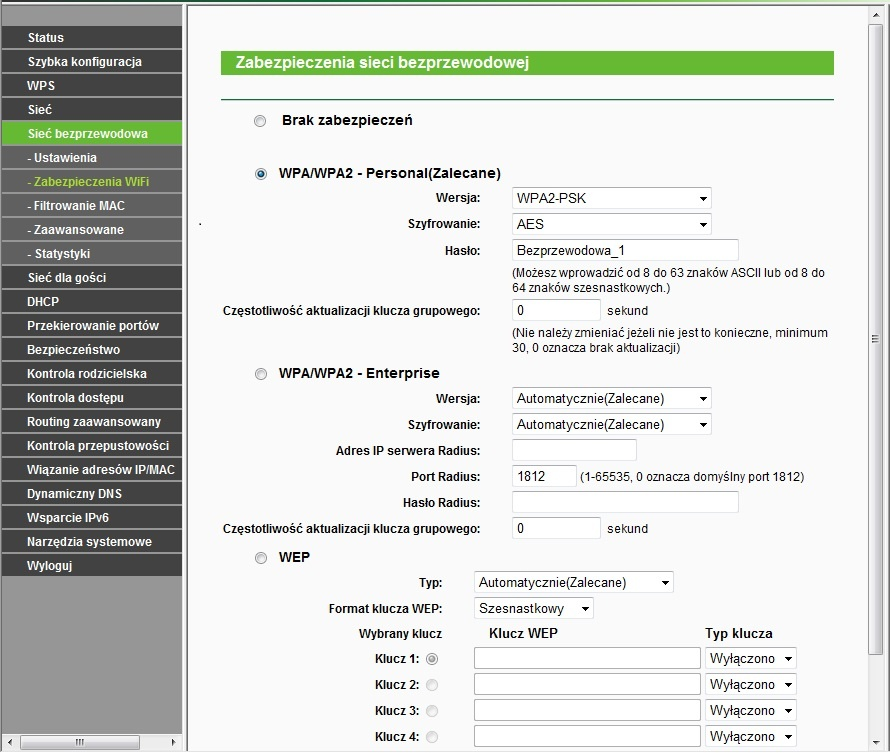

Na ilustracji przedstawiono konfigurację dostępu do sieci bezprzewodowej, która dotyczy

Dokument mający na celu przedstawienie oferty cenowej dla inwestora dotyczącej przeprowadzenia robót instalacyjnych w sieci komputerowej, to

Grupa protokołów, która charakteryzuje się wspólną metodą szyfrowania, to

Konwencja zapisu ścieżki do udziału sieciowego zgodna z UNC (Universal Naming Convention) ma postać

Co oznacza określenie średni czas dostępu w dyskach twardych?

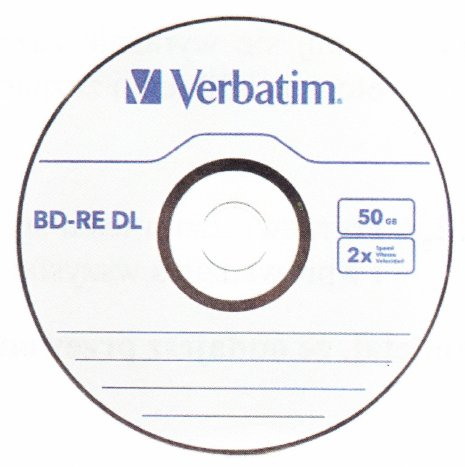

Aby nagrać dane na nośniku przedstawionym na ilustracji, konieczny jest odpowiedni napęd

Informacje ogólne na temat zdarzeń systemowych w systemie Linux są zapisywane w

Najszybszym sposobem na dodanie skrótu do konkretnego programu na pulpitach wszystkich użytkowników w domenie jest

Jakie złącze, które pozwala na podłączenie monitora, znajduje się na karcie graficznej pokazanej na ilustracji?

Farad to jednostka

Zastąpienie koncentratorów przełącznikami w sieci Ethernet doprowadzi do

Druk z drukarki igłowej realizowany jest z wykorzystaniem zestawu stalowych igieł w liczbie

Według normy JEDEC, standardowe napięcie zasilające dla modułów pamięci RAM DDR3L o niskim napięciu wynosi

W komputerze o parametrach przedstawionych w tabeli konieczna jest wymiana karty graficznej na kartę GeForce GTX 1070 Ti Titanium 8G DDR5, PCI EX-x16 3.0, 256b, 1683 MHz/1607 MHz, Power consumption 180W, 3x DP, 2x HDMI, recommended power supply 500W, DirectX 12, OpenGL 4.5. W związku z tym należy również zaktualizować

| Podzespół | Parametry | Pobór mocy [W] |

|---|---|---|

| Procesor Intel i5 | Cores: 6, Threads: 6, 2.8 GHz, Tryb Turbo: 4.0 GHz, s-1151 | 30 |

| Moduł pamięci DDR3 | Taktowanie: 1600 MHz, 8 GB (1x8 GB), CL 9 | 6 |

| Monitor LCD | Powłoka: matowa, LED, VGA x1, HDMI x1, DP x1 | 40 |

| Mysz i klawiatura | przewodowa, interfejs: USB | 2 |

| Płyta główna | 2x PCI Ex-x16 3.0, D-Sub x1, USB 2.0 x2, RJ-45 x1, USB 3.1 gen 1 x4, DP x1, PS/2 x1, DDR3, s-1151, 4xDDR4 (Max: 64 GB) | 35 |

| Karta graficzna | 3x DP, 1x DVI-D, 1x HDMI, 2 GB GDDR3 | 150 |

| Dysk twardy 7200 obr/min | 1 TB, SATA III (6 Gb/s), 64 MB | 16 |

| Zasilacz | Moc: 300W | --- |

Do jakiego typu wtyków przeznaczona jest zaciskarka pokazana na ilustracji?

Poprawność działania lokalnej sieci komputerowej po modernizacji powinna być potwierdzona